”预剪枝“ 的搜索结果

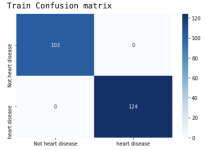

自己写的python决策树+随机森林,实现了预剪枝,后剪枝,并且包含了实验报告

这是本人机器学习决策树内容的第三篇博客沿用了之前相关的代码,包括信息增益计算函数、结点类、预测函数和分类精度计算函数。

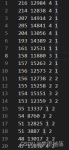

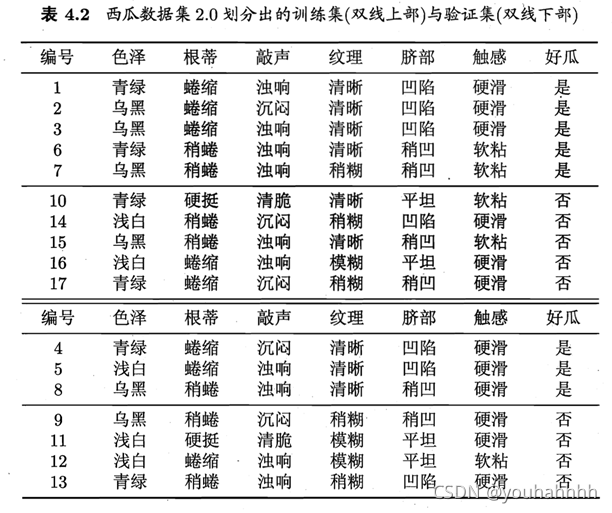

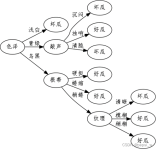

14, 15, 16, 17} 的样例组成训练集,编号为 {4, 5, 8, 9, 11, 12, 13} 的样例组成验证。此时,验证集中编号为 {4, 5, 8,11, 12} 的样例被分类正确,验证集精度为5 / 7 ∗ 100% =在⽤属性"脐部"划分之后...

为预防模型过拟合,我们可以采用预剪枝和后剪枝方法 1. 预剪枝:树构建过程,达到一定条件就停止生长 2. 后剪枝是等树完全构建后,再剪掉一些节点。 本文讲述预剪枝,后剪枝请参考《sklearn决策树后剪枝》 一.预剪枝...

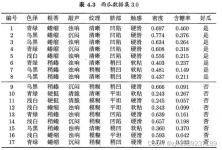

一、实验目的 学习如何用Python语言实现决策树的程序 二、实验原理 决策树(DecisionTree):一种树形结构,其中每个内部节点表示一个属性上的判断,每个叶节点代表最终的判断。 三、实验内容 机器学习实验教材...

前言: 本次讲解参考的仍是周志华的《机器学习》,采用的是书中的样例,按照我...预剪枝是要对划分前后泛化性能进行评估。对比决策树某节点生成前与生成后的泛化性能。 (1)在未划分前,根据训练集,类别标记为...

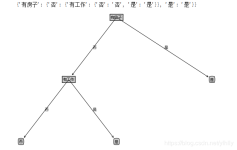

预剪枝 概念:决策树生成过程中对每个结点在划分前先进行估计,若当前结点的划分不能带来决策树泛化性能提升,则停止划分并将当前结点记为叶结点,其类别标记为训练样例数最多的类别。 我们直接看西瓜书上的例子,...

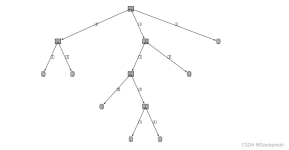

机器学习的决策树算法,为防止过拟合现象和过度开销,而采用剪枝的方法,主要有预剪枝和后剪枝两种常见方法。 预剪枝 自顶至下,从根节点开始,如果当前节点展开后的预测效果大于未展开的预测效果,则会展开,否则不...

前言: 本次讲解参考的仍是周志华的《机器学习》,采用的是书中的样例,按照我个人的理解对其进行了详细解释,希望大家能看得懂。 1、数据集 其中{1,2,3,6,7,10,14,15,16,17}...

预剪枝 PrePrune:预剪枝,及早的停止树增长。 通过提前停止树的构造进行剪枝. 最大深度:max depth 树的棵树、最小分裂的信息增益。 信息增益小于一定的阈值 后剪枝 后剪枝的剪枝过程是删除一些子树,然后用其叶子...

决策树的剪枝通常有两种方法,预剪枝( Pre-Pruning )和后剪枝( Post-Pruning )。 预剪枝( Pre-Pruning ) 预剪枝 , 即在生成决策树的过程中提前停止树的增长。核心思想是在树中结点进行扩展之前,先计算当前的...

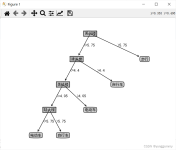

文章目录题目全部代码画图代码未减枝思想画图预剪枝思想画图后剪枝思想画图比较总结参考 题目 试编程实现基于基尼指数进行划分选择的决策树算法,为表4.2中数据生成预剪枝、后剪枝决策树,并与未剪枝决策树进行比较...

预剪枝(prepruning) 后剪枝(post-pruning) 7.1. 预剪枝(prepruning) 预剪枝是指在决策树生成过程中,对每个结点在划分前先进行估计,若当前结点的划分不能带来决策树泛化性能提升,则停止划分并将当前结点...

1、决策树是一类常见的机器学习方法,是基于树结构进行决策的。一般的,一棵决策树包含两类结点:内部节点和叶结点,其中内部节点表示表示一个特征或属性,叶结点表示__决策结果____。 2、在决策树学习中,一般...

将规则的“由短变长”的过程看成是树枝生长过程,那么,对树就有剪枝,包括预剪枝(阻止生长)和后剪枝(“由长变短”)。 剪枝过程涉及到规则的取舍,可以用统计显著性检验

推荐文章

- 记录CentOS7 Linux下安装MySQL8_适合正式环境_干货满满(超详细,默认开启了开机自启动,设置表名忽略大小写,提供详细配置,创建非root专属远程连接用户)_centos7安装mysql8-程序员宅基地

- python 读取grib \grib2-程序员宅基地

- Kimi Chat,不仅仅是聊天!深度剖析Kimi Chat 5大使用场景!-程序员宅基地

- Datawhale-集成学习-学习笔记Day4-Adaboost-程序员宅基地

- TexStudio配置以及解决无法Build&View_texstudio 无法启动 build & view:pdflatex:"d:/data/texl-程序员宅基地

- 用户空间访问I2C设备驱动-程序员宅基地

- 人脸识别算法初次了解-程序员宅基地

- maven的pom文件学习-程序员宅基地

- wamp mysql 没有启动,WAMP中mysql服务突然无法启动 解决方法-程序员宅基地

- 《树莓派Python编程入门与实战(第2版)》——3.7 创建Python脚本-程序员宅基地