岭回归是一种专用于共线性数据分析的有偏估计回归方法,实质上是一种改良的最小二乘估计法,通过放弃最小二乘法的无偏性,以损失部分信息、降低精度为代价获得回归系数更为符合实际、更可靠的回归方法,对病态数据的...

”线性回归,损失的定义,损失函数与优化方法,用统计学习方法来理解线性回归、损失函数和优化方法,Sklearn使用方法_ck784101777的博客-程序员宅基地“ 的搜索结果

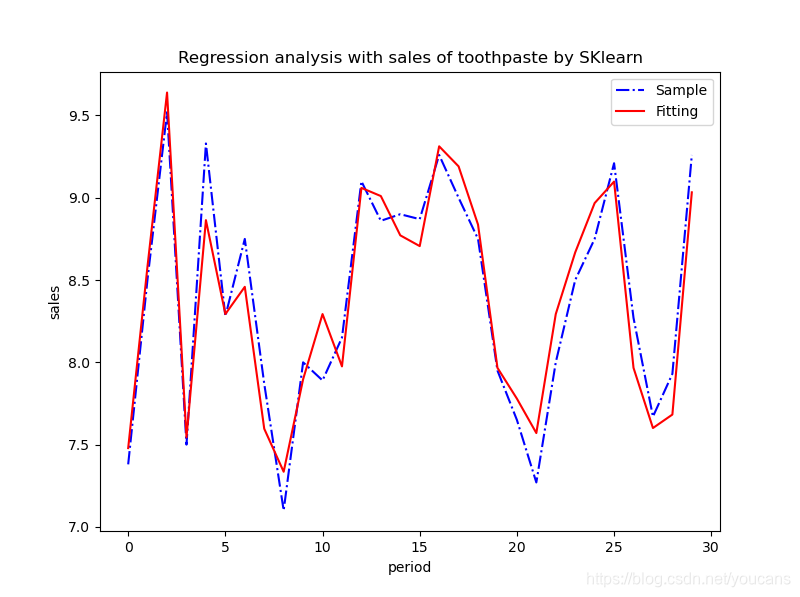

写在前面从一开始的课题需要重新整理XGBoost,到现在整理机器学习算法的知识将近一个礼拜了,希望自己能一直坚持下去~线性回归在机器学习算法中算是一个比较简单基础的算法。线性回归的目的是要得到输出向量Y和输入...

它提供了一种直观的方法来建立和分析变量之间的线性关系。在本文中,我们详细介绍了线性回归的原理,并使用Python和Scikit-learn库实现了一个简单的线性回归模型。希望本文能帮助你更好地理解线性回归,并能够在实际...

不同的线性回归模型的参数设置、模型方法和调参策略并不一样,本文并不具体介绍每个模型的具体接口和使用事项,仅简单梳理下sklearn中的部分线性回归模型。 线性回归模型按照正则化策略:可分为普通回归问题(无正则...

线性回归是一种经典的机器学习算法,用于建立一个线性关系模型,以预测一个连续型变量的值。它的基本假设是,目标变量和特征变量之间存在线性关系,即目标变量可以通过特征变量的线性组合来进行预测。

损失函数的一般表示为L(y,f(x)),用以衡量真实值 y和预测值 f(x)之间不一致的程度,一般越小越好。为了便于不同损失函数的比较,常将其表示为单变量的函数,在回归问题中这个变量为[y-f(x)] :残差表...

梯度下降法是一种常见的优化方法,常用于求解损失函数最小化的问题。在线性回归模型中,我们可以使用梯度下降法来求解使得模型损失函数最小的模型参数。

线性回归的定义是:目标值预期是输入变量的线性组合。线性回归通过一个或多个自变量与因变量之间进行建模的回归分析。 一元线性回归:涉及到的变量只有一个 多元线性回归:涉及到的变量两个或两个以上 ...

1、线性回归评价指标 #MSE均方误差 from sklearn.metrics import mean_squared_error #MAEX from sklearn.metrics import mean_absolute_error #R^2决定系数 from sklearn.metrics import r2_score 2、分类指标: ...

线性回归的模型及假设: ,随机误差服从正态分布(高斯分布) are distributed IID,随机误差是独立同分布的 于是目标变量的条件概率分布: 注意: 整个训练集的似然函数为: 对数似然函数为: ...

推荐文章

- EVO-CNN-LSTM-multihead-Attention能量谷算法优化模型结合多头注意力机制多维时序预测-程序员宅基地

- Objective-C 中的id到底是什么-程序员宅基地

- 好记性不如烂笔头---Archlinux优化简介-程序员宅基地

- 3DREM16P-7X/250YG24-8K4V比例减压阀放大器-程序员宅基地

- python文件操作(open()、write()、writelines()、read()、readline()、readlines()、seek()、os)_python open writeline-程序员宅基地

- 分布式限流实战--redis实现令牌桶限流_分布式令牌限流-程序员宅基地

- 【Linux】文件系统-程序员宅基地

- python实现ks算法_python, 在信用评级中,计算KS statistic值-程序员宅基地

- 类加载过程 与 代码的执行顺序_类加载后代码的执行顺序-程序员宅基地

- Oracle LiveLabs实验:Introduction to Oracle Spatial Studio_oracle_spatial 可视化-程序员宅基地