”模型部署“ 的搜索结果

深度学习模型部署浅析

标签: 模型部署

关于模型部署可能有很多种概念或者解释。 根据看的一些文献和接触的一些开源工具,进行梳理。 模型部署说到底,就是通信传输,以及平台存储打通,以及任务的定时工作(定时工作可能偏向于调度了)。 1. 模型部署...

结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。 ChatGLM-6B 使用了和 ChatGPT 相似的技术,针对中文问答和对话进行了优化。经过约 1T 标识符的中英双语训练,辅以...

LiteSeg语义分割的模型和源码,使用OpenCV 的Dnn进行推理

基于Jupyter Notebook的AI模型上线与模型部署

大模型部署_在ChatGPT中集成Midjourney_支持文本生成+图片生成的能力_优质大模型部署项目实战

收集如何使用nginx,hadoop,kafka,flask,gunicorn,socketio,docker swarm,luigi spotify等部署tensorflow模型

此篇教程为科大讯飞的星火大模型部署教程,部署完成后即可与智能助手进行聊天。这里是关于部署到服务器端,如果有其他需求可以查看官方文档。

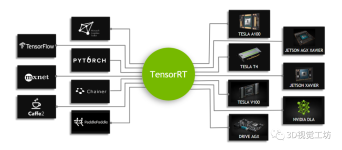

TensorRT_使用TensorRT部署ChatGLM2-6B大模型_优质大模型部署项目实战

[模型部署]:TVM模型部署实战

三方模型是基于开源项目OpenFaas,为数据科学家构建的一套模型的在线开发、统一管理、部署和运维的管理平台,可以让AI模型的工程化部署应用更加简单、便捷和高效。平台采用Serverless的服务模式构建,具备高扩展、高...

算法部署_使用TensorRT部署GPT-J-6B大模型_支持int8推理_优质大模型部署项目实战

多个项目部署到一个服务器上的部署方式:使用Docker将项目封装在独立的容器中。

大模型部署_使用OpenVINO+C++部署StableDiffusionv1.5图片生成扩散模型_附详细流程教程+项目源码_优质项目实战

大模型部署_使用NCNN+Cpp部署Stable-Diffusion模型_支持文生图+图生图_优质算法部署项目实战

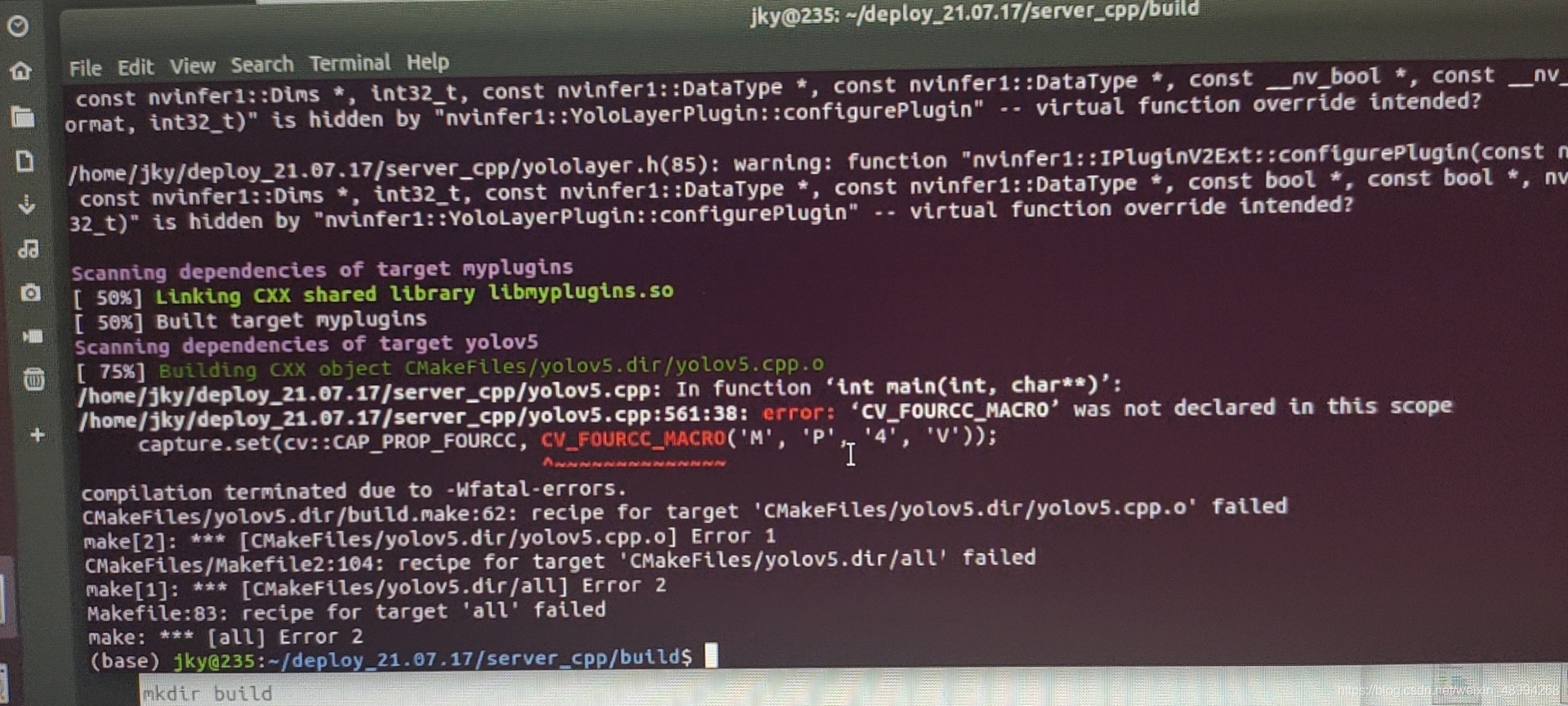

由于C++语言的运行优势,多数算法模型在实际应用时需要部署到C++环境下运行,以提高算法速度和稳定性 主要讲述WIn10下在VS工程中通过Opencv部署yolov5模型,步骤包括: 1.python环境下通过export.py导出.onnx模型 ...

大模型部署_使用OpenINO-C++-API部署生成式大模型_支持LLaMA2+StableDiffusion等_项目源码_优质项目实战

大模型部署_在本地计算机上推理LLaMA大语言模型_支持Windows+Linux+Mac_优质项目实战

算法部署_使用TensorRT-LLM部署llama大模型_毕业设计_附详细性能优化+分析+实现流程教程_优质大模型部署项目实战

将pytorch模型在主机跑通,通过Flask提供后端服务,与小程序前端通过局域网通信,初步搞了一个小程序,并不能真正投入使用

算法部署_使用TensorRT-LLM部署通义千问Qwen-7B大模型_附详细优化+分析流程教程_优质大模型部署项目实战

推荐文章

- confluence搭建部署_ata confluence-程序员宅基地

- SpringCloud与SpringBoot版本对应关系_springboot 2.1.1 对于的cloud-程序员宅基地

- 如何恢复硬盘数据?简单解决问题_磁盘恢复 csdn-程序员宅基地

- 苹果手机测试网络速度的软件,App Store 上的“网速测试大师-测网速首选”-程序员宅基地

- 教了一年少儿编程,说说感想和体验-程序员宅基地

- 22东华大学计算机专硕854考研上岸实录-程序员宅基地

- 如何用《玉树芝兰》入门数据科学?-程序员宅基地

- macOS使用brew包管理器_brew清理缓存-程序员宅基地

- 【echarts没有刷新】用按钮切换echarts图表的时候,该消失的图表还在,加个key属性就解决了_echarts 怎么加key值-程序员宅基地

- 常用机器学习的模型和算法_常见机器学习模型算法整理和对应超参数表格整理-程序员宅基地