使用Nginx+uwsgi+Flask+TensorFlow Serving实现深度学习模型部署。 环境 Ubuntu16.04 python3.x tensorflow1.14 Nginx+uwsgi+Flask 安装 pip install uwsgi pip install flask apt-get install ...

”模型部署“ 的搜索结果

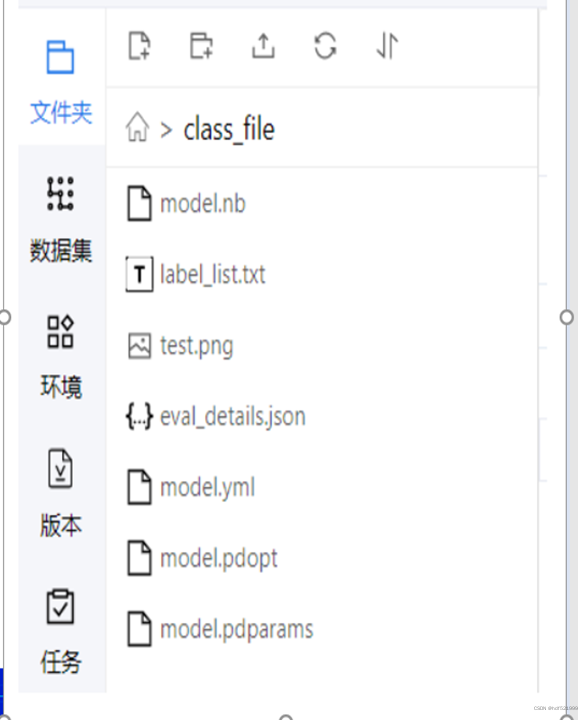

最近在做毕业设计,需要用到阿里云PAI上训练好的...首先将跑通的模型在线部署:部署成功后,会在左侧“模型-已部署的在线模型”中找到对应的模型:(注意:在线的模型调用测试 可以查看官方文档,已经写的非常详细了 ...

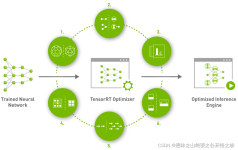

机器学习-深度学习跨语言的部署是通过将主要由python实现的机器学习和深度度学习模型应用于实际的环境中,具体为部署在,手机,网页,PC等各类设备上。主要通过将模型保存成一种格式的文件,然后通过推理引擎进行...

OpenCV DNN模块——从TensorFlow模型导出到OpenCV部署详解 OpenCV DNN模块——从TensorFlow模型导出到OpenCV部署详解_南七小僧的学海无涯-程序员宅基地 OpenCV图像处理-调用Tensoflow和YOLO OpenCV图像处理-调用...

通义千问-7B(Qwen-7B)是阿里云研发的通义千问大模型系列的70亿参数规模的模型。Qwen-7B是基于Transformer的大语言模型, 在超大规模的预训练数据上进行训练得到。预训练数据类型多样,覆盖广泛,包括大量网络文本、...

YOLOv8的3个检测头一共有80x80+40x40+20x20=8400个输出单元格,每个单元格包含x,y,w,h这4项再加80个类别的置信度总共84项内容,所以通过上面命令导出的onnx模型的输出维度为1x84x8400。这样的通道排列顺序有个问题,...

【模型部署】风控模型部署相关知识

标签: 风控

部署所知

Flask 和 Google App Engine 部署模型服务使用方法 将机器学习模型部署为REST API(github)

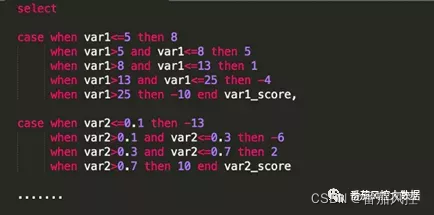

a)模型本身提供的部署方式 b)第三方方式:PMML方式,将模型输出为 PMML格式,由第三方加载PMML模型提供输出,其中java的库很成熟,但PMML在深度学习方面上支持不足 2、深度模型 a)深度的模型,当前流行的为...

首先模型训练,不多说,网上有很多资源,但是tf官网保存的模型时ckpt,要完成移动端部署,需要将ckpt转换成freeze pb,再将pb转换成tflite。 1.ckpt转换成pb /research/deeplab目录下有一个export_model.py文件,这...

DS/ML:数据科学技术之机器学习领域六大阶段最强学习路线(初步探索性数据分析EDA→数据预处理/广义的特征工程→模型训练/评估/推理→模型分析/反思/再优化→模型部署与监控→模型全流程优化)详解 导读:数据科学...

前段时间做的xgboost要部署成service,中途碰到不少坑,首先你部署的机器必须先装gcc环境,而且要6.0x版本 以上,4.x的版本的并不适应,看下代码service项目吧 首先是接口: package ...

模型部署的第一步就是要有模型,所以我首先把模型导出方法做一下梳理,部署主要有两种:单机版和服务器版。单机版可以在单机上进行模型推理,主要应用在离线的智能终端、边缘计算产品上;单机版我先从最简单的p...

通过使用ONNX,用户可以将训练好的模型部署到生产环境中,并实时进行预测和分析。如果没有指定某个输入张量的值,则将使用默认值。通过提供通用的模型表示方式,ONNX提高了模型的互操作性,使得深度学习社区更容易...

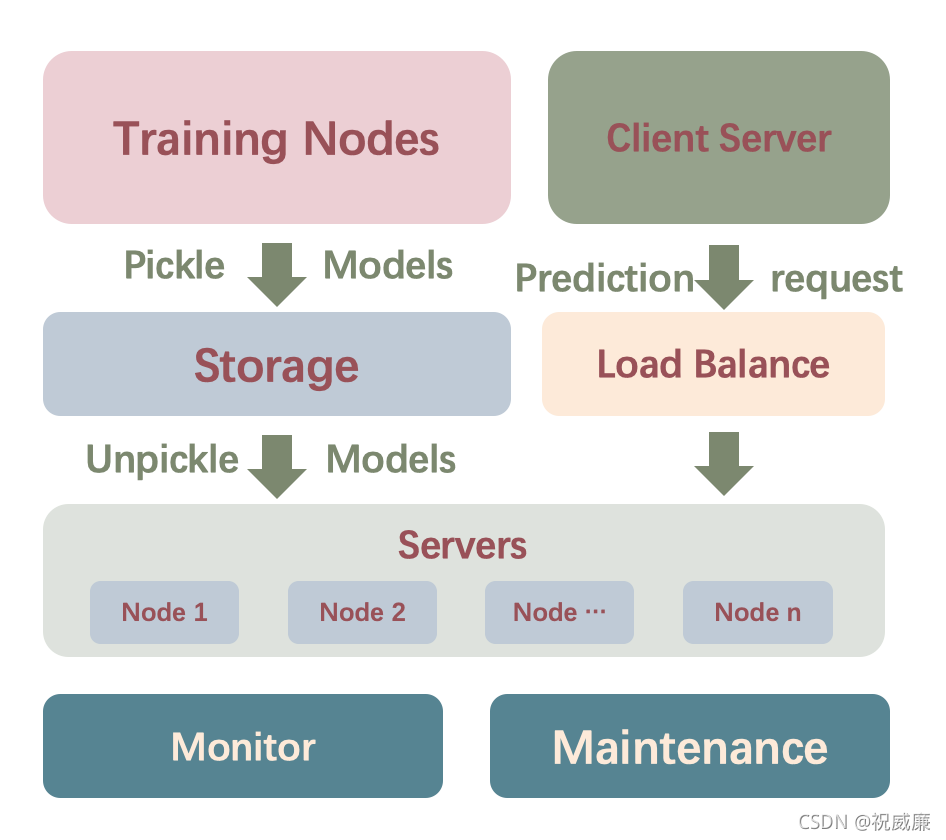

模型部署后,我们需要对模型的性能进行评价,以确保模型能够在生产环境中高效地运行。模型部署是机器学习应用中重要的一环,它可以帮助企业快速将机器学习应用落地,并带来实际的商业价值。总之,Python中有很多方法...

meta 推出的可以比肩chatGPT-3.5的 LLaMA 大语言模型的下载和部署流程

1)使用tensorflow2加载预训练bert模型,进行训练,然后将模型部署载tfseving中。 2)使用flask部署模型推理,模型推理时会requrest请求 1) 中tfserving部署的模型 3) 将2)的flask构建成一个docker镜像,运行镜像...

将模型转为onnx 选用pytorch框架,训练resnet18二分类,将二分类模型转为onnx模型 from typing_extensions import dataclass_transform import torch import torch.nn as nn from torchvision import models, ...

Mistral AI 是一家总部位于法国的 AI 公司,其使命是将公开可用的模型提升至最先进的性能水平。他们专注于构建快速而安全的大型语言模型(LLM),此类模型可用于从聊天机器人到代码生成等各种任务。不久前其发布了一...

泰坦尼克号使用部署在Flask前端的EC2上部署的逻辑回归进行泰坦尼克数据集模型预测EC2实例的链接: : :

Pytorch模型部署 - Libtorch 简介 libtorch是facebook提供的一套C++推理接口库,便于工业级别部署和性能优化。 安装: libtoch+opencv联合编译,这里采用libtorch-1.4(cpu)+opencv4.1. 可能出现的问题 ibtoch,...

最近清华大学开源的ChatGLM-6B语言模型在国际上大出风头,仅仅62亿参数的小模型,能力却很强。#运行ChatGLM6B 的web版聊天程序,即可访问http://主机IP:8080进行聊天。本文来自知识星球:ConnectGPT ,一个致力于...

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地