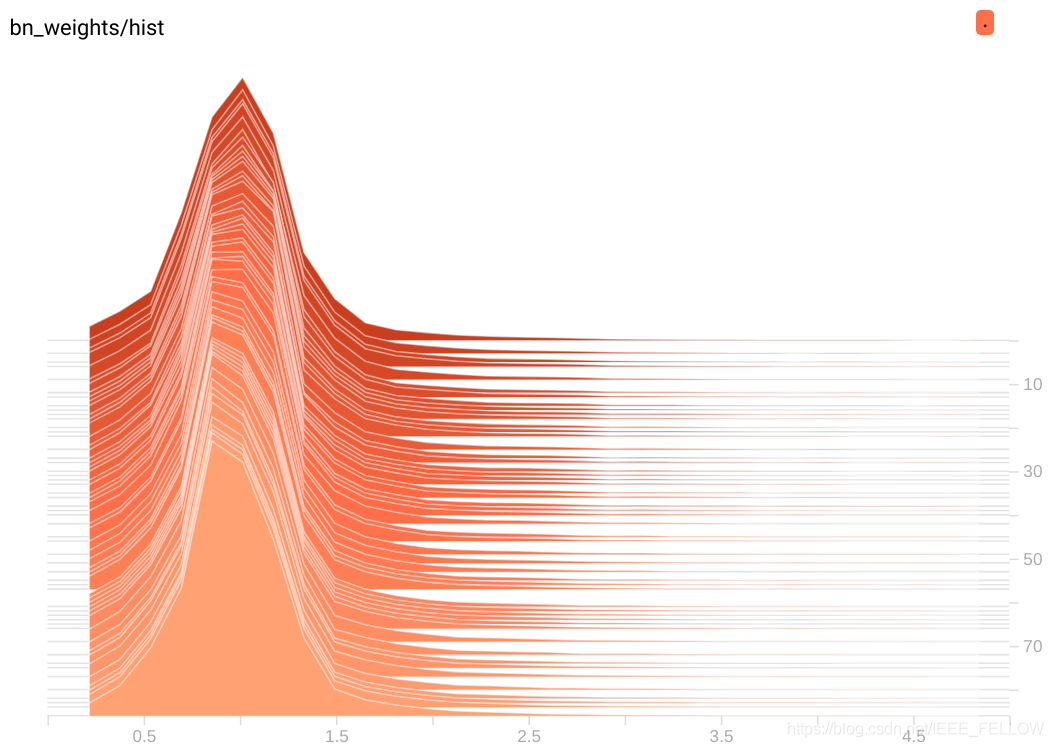

模型压缩总结 1. 核参数稀疏 在损失函数中添加使得参数趋向于稀疏的项, 使得模型在训练过程中,其参数权重趋向于稀疏。 2. 权重矩阵低秩分解 核心思想就是把较大的卷积核分解为两个级联的行卷积核和列卷积核, 例如...

”模型压缩“ 的搜索结果

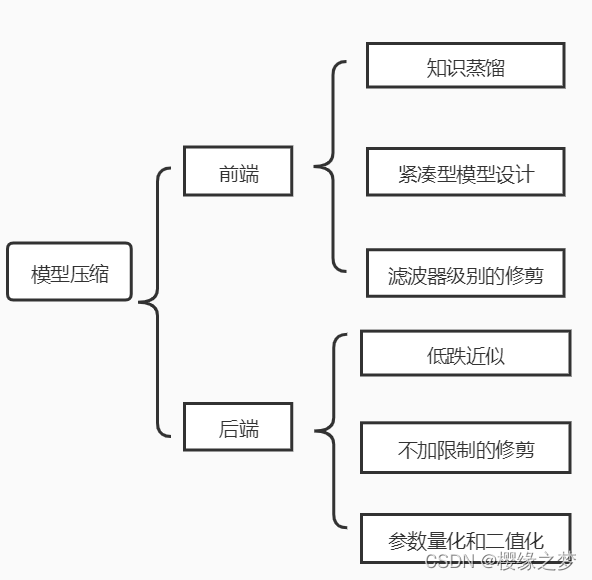

之前陆陆续续看了许多模型压缩相关的文章,自己业务中也接触过一些相关的客户,今天周末没事做,把模型压缩相关的内容整理一下做个分享。可能更多地从科普的角度去介绍,因为我也不是专业做这方面技术的研究。 首先...

作者:禅与计算机程序设计艺术 近年来,随着计算机算力的提升、...但是,由于模型训练需要大量数据,因此模型大小会成为一个重要的瓶颈。另一方面,迁移学习的普及也使得少量数据的样本也可以对预训练模型进行微调,其

CNN模型压缩总结 总结综述 参考:https://blog.csdn.net/shentanyue/article/details/83508497 模型裁剪/剪枝(Pruning) 单个权重(Weight)剪枝——非结构化 定义:任意权重被看作是单个参数并进行随机非结构...

作者:禅与计算机程序设计艺术 "模型压缩与可解释性:如何在保护模型隐私的同时提高模型的可解释性" 引言 1.1. 背景介绍

为了解决这些问题,压缩模型以最大限度地减小模型对于计算空间和时间的消耗。 2.理论基础 必要性:目前主流的网络,如VGG16,参数量1亿3千多万,占用500多MB空间,需要进行300多亿次浮点运算才能完成一次图像...

大家好,我是小P,今天给大家带来深度模型压缩经典文献MobileNets的解读,关于轻量化模型的介绍,资料齐全。 此外,对“目标检测/模型压缩/语义分割”感兴趣的小伙伴,欢迎加入QQ群 813221712 讨论交流,进群请看群...

分块压缩感知,算法是基于OMP算法,变换是DCT变化,且根据纹理自适应选择 分块压缩感知,算法是基于OMP算法,变换是DCT变化,且根据纹理自适应选择

YOLOv5模型压缩方法:综述

标签: YOLO

在过去的几年里,广泛的研究致力于增强YOLO目标检测器。...利用模型压缩方法的丰硕成果,如降低内存使用和推理时间,使其有利于在硬件受限的边缘设备上部署大型神经网络。本文的重点是修剪和量化,因为它们比较模块化。

最近因为项目的需要,我们需要将tensorflow模型部署到手机端,所以必不可少的就是模型的优化加速和模型压缩,我这个文章主要是为了记录一下使用到的方法。...

本文主要总结近年来CNN的模型压缩方案 在2016年SqueezeNet这篇文章中,作者总结模型设计三个原则 –(1)使用1*1网络代替3*3网络 •替换3x3的卷积kernel为1x1的卷积kernel可以让参数缩小9X为了不影响识别精度,并不...

CNN 模型压缩与加速算法 转载地址:https://blog.csdn.net/QcloudCommunity/article/details/77719498 导语:卷积神经网络日益增长的深度和尺寸为深度学习在移动端的部署带来了巨大的挑战,CNN模型压缩与加速成为...

tensorflow的模型在移动端运行时往往需要进行模型压缩。这主要有于两方面的原因:1.模型过大不易加载和下载,运行时内存占用率太高。2. tensorflow的模型在训练的过程中可能为了训练会添加一些操作和节点,而...

作者:禅与计算机程序设计艺术 1.简介 随着人工智能领域的火热,深度学习在图像识别、文本...因此,如何高效地压缩深度学习模型,降低内存消耗和模型推理时间成为一个重要课题。为了解决这一问题,近年来一些研究机

深度学习模型的压缩和加速是指利用神经网络参数的冗余性和网络结构的冗余性精简模型,在不影响任务完成度的情况下,得到参数量更少、结构更精简的模型。被压缩后的模型计算资源需求和内存需求更小,相比原始模型能够...

AI领域最有趣的老师李宏毅:模型压缩系列讲解 模型压缩 1、剪枝的理由 不用小的network直接训练是因为小网络难以训练,泛化性不好,提取特征不好,容易卡在局部特征,有论文表明只要模型够大,就能提取全局有效的...

推荐文章

- 专访天谋科技谭新宇:我与 IoTDB 的这些年-程序员宅基地

- MATLAB知识点:条件判断switch-case-otherwise-end语句_matlab中判断条件切换-程序员宅基地

- mysql隐式转换导致的索引失效分析_数据库隐式转换 索引失效-程序员宅基地

- R︱并行计算以及提高运算效率的方式(parallel包、clusterExport函数、SupR包简介)-程序员宅基地

- exe文件:electron设置窗口默认最大化(默认全屏)_electron窗口最大化-程序员宅基地

- 使用C++语言实现哈希表查找_c++判断哈希表中是否存在-程序员宅基地

- 操作系统及软件常用的日语单词-程序员宅基地

- 探索Transformer-MM-Explainability:深度学习可解释性新纪元-程序员宅基地

- idea 热更新 JRebel 插件激活使用_idea 热更新插件jrebel-程序员宅基地

- 计算机网络【第一章】-程序员宅基地