深度学习模型运行需要大量的计算、内存和功耗,为了解决模型模型运行的瓶颈,研究者提出了一系列模型压缩方法,其中包括模型剪枝,能够有效地减小内存、功耗,提高计算效率。 然而,「每一枚硬币都有正反两面」,...

”模型剪枝,“剪”掉了什么?“ 的搜索结果

基于多种模型剪枝方法(L1-norm、Slimming、AutoSlim)的模型轻量化和模型压缩实现

基于pytorch的模型稀疏训练与模型剪枝示例

自定义剪枝可以自定义一个子类,用来实现具体的剪枝逻辑,比如对权重矩阵进行间隔性的剪枝在剪枝前查看网络结构采用自定义剪枝的方式对局部模块fc3进行剪枝输出结果最后的剪枝效果与实现的逻辑一致。

稀疏剪枝

剪枝:https://zhuanlan.zhihu.com/p/408899259。总结:分类模型蒸馏效果 好,检测模型蒸馏效果一般,后处理越多的蒸馏效果不好。一、yolov5模型剪枝工程。三、yolov5模型蒸馏工程。二、分类模型剪枝工程。

剪枝是压缩神经网络模型的常用技术。剪枝方法探索模型权重(参数)中的冗余,并尝试删除/修剪冗余和非关键权重。冗余元素从模型中修剪,其值归零,我们确保它们不参与反向传播过程。修剪深度学习模型有三种常见做法...

NNI:Neural Network Intelligence,是一个轻量但强大的自动机器学习工具包,能帮助用户自动进行特征工程、神经网络架构搜索、超参调优以及模型压缩。在运行相同的迭代次数情况下,nni的准确率没有slimming高。

prune.l1_unstructured(module, name="weight", amount=nWeightAmcount) #L1范数剪枝,既绝对值最小的权重移除prune.ln_structured(module, name="weight", amount=nFeatureAmcount, n=2, dim=0) #结构化剪枝,移除...

对于深度学习来说,比较复杂的模型往往有着不错的识别效果,但是复杂的模型往往对算力要求也比较高,...剪枝也就是将这个参数置为0,消除这些节点与后面的联系,从而降低运算量,本文主要基于对于模型剪枝的实战展开。

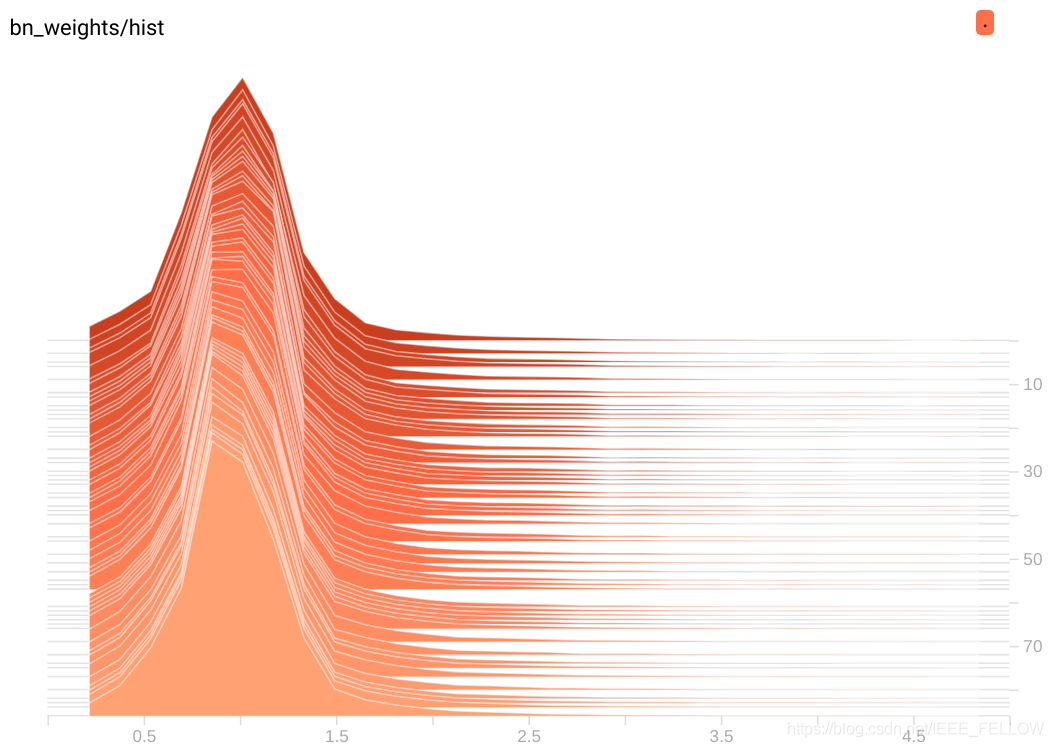

文章的核心在于,将BN层中的可学习参数gamma,作为稀疏化参数,对CNN卷积之后提取保留更有用的特征图的方法进行模型剪枝大瘦身。

有框架完成的对网络所有结构都自适应剪枝是最佳的,但这里没有详细记录torch-pruning的yolov8的剪枝,是因为存在不解 对其yolov8具体的剪枝代码中操作:“比较疑惑 replace_c2f_with_c2f_v2(model.model)的梯度置为...

随着深度学习技术的不断发展,深度学习模型在计算能力和性能方面取得了显著的进展。然而,这些模型的复杂性也带来了更高的...训练时压缩通常包括剪枝、剪梳等方法。在本文中,我们将重点关注知识蒸馏和剪枝两种方法。

模型剪枝是一种常用的深度学习模型优化技巧,其目的是通过去除模型中一些不必要的参数或节点,从而提高模型的运行效率和准确性。同样的,模型中的参数如果过多,会降低模型的训练速度和推理速度,同时也可能会过拟合...

TextPruner是一个为预训练语言模型设计的模型裁剪工具包,通过轻量、快速的裁剪方法对模型进行结构化剪枝,从而实现压缩模型体积、提升模型速度。

模型剪枝(Model Pruning)是一种通过减少神经网络模型中的冗余参数和连接来优化模型的方法。它旨在减小模型的大小、内存占用和计算复杂度,同时尽可能地保持模型的性能。模型剪枝的基本思想是通过识别和删除对模型...

模型剪枝,高效压缩模型的简单实现

推荐文章

- 大数据和云计算哪个更简单,易学,前景比较好?_大数据和云计算哪个好-程序员宅基地

- python操作剪贴板错误提示:pywintypes.error: (1418, 'GetClipboardData',线程没有打开的剪贴板)...-程序员宅基地

- IOS知识点大集合_ios /xmlib.framework/headers/xmmanager.h:66:32: ex-程序员宅基地

- Android Studio —— 界面切换_android studio 左右滑动切换页面-程序员宅基地

- 数据结构(3):java使用数组模拟堆栈-程序员宅基地

- Understand_6.5.1175::New Project Wizard_understand 6.5.1176-程序员宅基地

- 从零开始带你成为MySQL实战优化高手学习笔记(二) Innodb中Buffer Pool的相关知识_mysql_global_status_innodb_buffer_pool_reads-程序员宅基地

- 美化上传文件框(上传图片框)_文件上传框很丑-程序员宅基地

- js简单表格操作_"var str = '<table border=\"5px\"><tr><td>序号</td><-程序员宅基地

- Power BI销售数据分析_powerbi汇总销售人员业绩包括无销售记录的人-程序员宅基地