转自:https://blog.csdn.net/yangwohenmai1/article/details/96955667 导读: softmax的前世今生系列是作者在学习NLP神经网络时...

”权重更新“ 的搜索结果

提出一种选择性样本权重更新算法 ,把 FNR和 FPR引入样本权重更新过程 ,将分类效果反馈给分类器,实现对分类器结构的有效控制 ,在样本权重更新时合理选择更新方法 ,使得分类器的 FNR或 FPR达到理想状态。实验表明 ,该...

lstm网络数据处理,网络训练以及权重自动训练更新。

提出一种选择性样本权重更新算法,把FNR 和FPR 引入样本权重更新过程,将分类效果反馈给分类器,实现对分类器结构的有效控制,在样本权重更新时合理选择更新方法,使得分类器的FNR 或FPR 达到理想状态。实验表明,该...

这是课程的小作业,是一个三层神经网络,对给定的样本进行学习,输入层到隐含层采用双曲正切函数激励,隐含层到输出层采用sigmoid函数

本文重在阐述神经网络里的前向传播和反向传播。 上一篇文章构建了一个简单的网络,可以看出来它对于手写数字的识别率还是可以高达91%。但我们尚未对神经网络处理的过程做出太多解释。 数据在网络中的传播有两种...

所需滤波器系数的权重更新

获取vgg16网络模型参数出错时的解决办法

提出了正负相关图像所占比例与特征值的标准方差相结合来调整对应权值的方法。为了避免相关反馈的权值调整陷入局部最优状态,引入一个干扰因子,使权值跳出局部最优区域。结果表明了该方法的优越性。

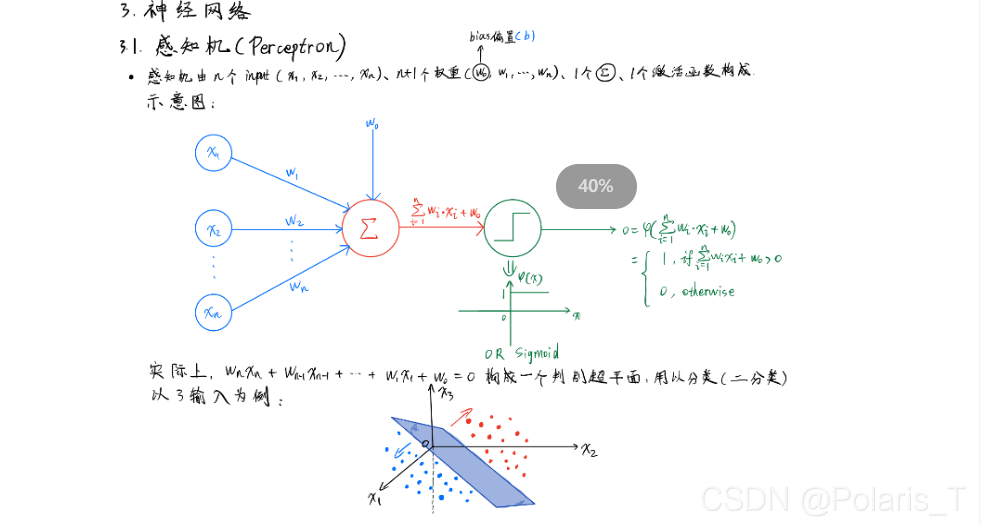

1.下面小关来介绍一下人工智能之实现简单神经网络之权重更新算法 2.来吧展示jupter noterbook #调库 import numpy as np #定义感受器 class Perceptron(object): #eta:学习率 #n_iter:权重向量的训练次数 #w_:...

针对此问题,提出了一种基于动态权重的LDA算法,该算法的基本思想是每个单词在建模中具有不同的重要性,在迭代过程中根据单词的主题分布动态生成相应的权重并反作用于主题建模,降低了高频词对建模的影响,提高了关键词的...

一、BP神经网络的概念 BP神经网络是一种多层的前馈神经网络,其主要的特点是:信号是前向传播的,而误差是...第二阶段是误差的反向传播,从输出层到隐含层,最后到输入层,依次调节隐含层到输出层的权重和偏置,输

你要的答案或许都在这里:小鹏的博客目录 ...学习dl不去深层的扒扒,没有理论的支撑是不行的,今天分享一篇笔记,另加读者的心得,很棒。...1:定义业务问题,很多人认为机器学习越高大上的算法越厉害,其实不是...

我们知道,在深度学习中权重更新是为了使得 Loss Fuction 变小,权重微量的增加或者减小都会对 Loss Fuction 造成一定的影响。为了使得 Loss Fuction 变小,那么就需要改变权重的值使得 Loss Fuction 朝着减小的方向...

参考: http://ir.hit.edu.cn/~jguo/docs/notes/bptt.pdf http://www.cnblogs.com/wacc/p/5341670.html https://zybuluo.com/hanbingtao/note/541458 http://www.wildml.com/2015/10/recurrent-neural-networ

RVFL是一种简单的神经网络,初始参数随机确定,仅需训练隐层至输出的权重。

据此,我简单的了解了下pytorch的权重梯度的更新策略,看看能否一窥究竟。 对代码说明 共三个实验,分布写在代码中的(一)(二)(三)三个地方。运行实验时注释掉其他两个 实验及其结果 实验(三): 不使用zero_...

上一篇中讲述了里程计在amcl中的作用,算法根据里程计反馈对每个粒子的位姿进行更新。在粒子更新后,则需要根据激光的观测数据对粒子的权重进行更新,这里主要看一下激光电云在amcl中的作用:

更新权重这一步里面就没什么东西了,直接根据学习率来更新权重:至此,一次正向+反向传播过程就到此为止,接下来只需要进行迭代,不断调整边的权重,修正网络的输出和实际结果之间的偏差(也就是training整个网络)...

此时如何学习到权重参数,这就涉及到权重更新算法。这里给出一般性权重更新算法 最新权重 W(j)′W' _{(j)}W(j)′ = W(j)W_{(j)}W(j) + ∇W(j)\nabla W_{(j...

当w为负时,更新后的w变大——因此它的效果就是让w往0靠,使网络中的权重尽可能为0,也就相当于减小了网络复杂度,防止过拟合。 另外,上面没有提到一个问题,当w为0时怎么办?当w等于0时,|W|是不可导的,

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地