”scrapy框架“ 的搜索结果

今天小编就为大家分享一篇关于Scrapy框架使用的基本知识,小编觉得内容挺不错的,现在分享给大家,具有很好的参考价值,需要的朋友一起跟随小编来看看吧

主要介绍了scrapy框架携带cookie访问淘宝购物车,本文通过实例代码图文详解给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下

python利用Scrapy爬取同花顺个股行情并发送邮件通知,结合现实场景利用scrapy给我们带来便利。 有炒股或者其它理财产品的朋友经常会关心每日的个股走势,如果结合爬虫进行实时通知自己,并根据自己预想的行情进行...

爬虫之Scrapy框架的下载

标签: 爬虫

文章目录前言一、安装Scrapy1.更新pip安装器2.安装wheel依赖包3.安装lxml4.下载pyOpenSSL并安装5.下载Twisted6.下载安装Pywin327.安装Scrapy8.检查总结 前言 写一个爬虫,需要做很多的事情。比如:发送网络请求、...

下面是一个简单的Python爬虫Scrapy框架代码示例,该代码可以抓取百度搜索结果页面中指定关键字的链接和标题等信息:

爬虫学习代码,包含beatifulSoup,scrapy框架....

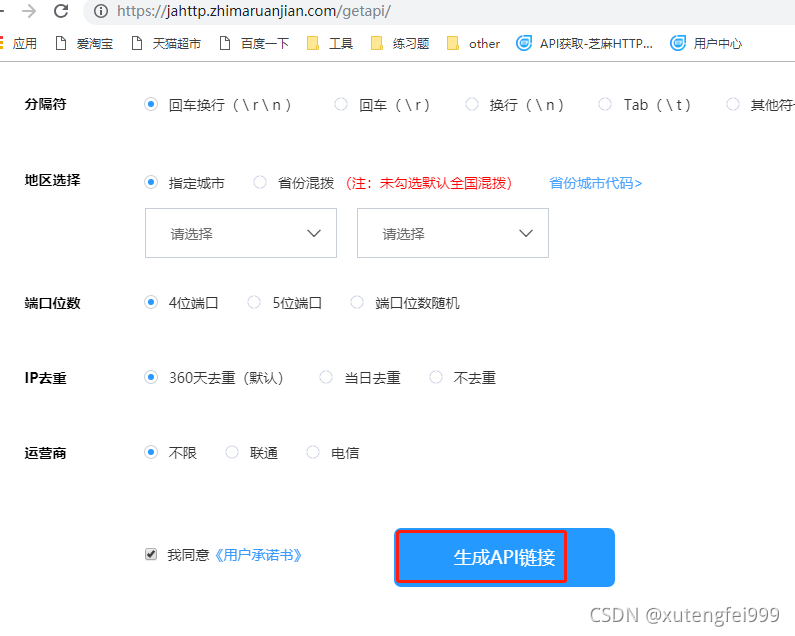

采用scrapy-redis分布式爬虫框架 采用代理池避免IP被封禁而导致爬取失败的问题 代理池实现采用「」配置修改方式请自行参考 环境要求 Python 3.6+ Redis Mongodb pymongo Scrapy scrapy_redis requests environs ...

虽然我们利用一些库开发一个爬虫程序,但是使用框架可以大大提高效率,缩短开发时间。Scrapy是一个使用Python编写的,轻量级的,简单轻巧,并且使用起来非常的方便。使用Scrapy可以很方便的完成网上数据的采集工作,...

微博爬虫,一个基于Scrapy框架的轻量微博爬虫,Sina Weibo Spider.zip

经过了很长时间的学习和总结,我对scrapy框架已经有了熟练的应用和心得,现在就分享给大家,我会将我学习scrapy框架的所遇到的一些问题进行总结,并且将框架的使用和基本知识就行梳理。 1.为什么要学习使用框架? ...

1在scrapy框架中编写api接口:在与setting.py同级处新建api.py,在该api.py中编写一下代码 from flask import Flask import os app = Flask(__name__) @app.route('/asin')#浏览器接口路径 def index(): ...

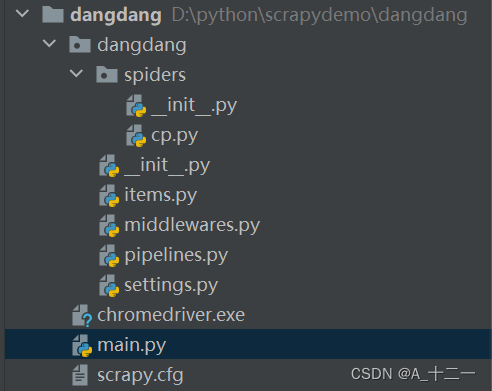

在scrapy创建成功后,在自动生成的目录中会有items.py文件和pipelines.py文件,这两个都是可以用来保存文件的。下面就来写一下这两个文件的保存文件的方式。

框架包括了selenium结合到scrapy中,下拉动态获取的网站,然后再scrapy的spider中解析数据,进一步的获取再用python的request请求,请求后再用scrapy的selector解析数据,保存到txt文件中。

Scrapy框架是Python中的高层网络抓取工具,包含引擎、调度器、爬虫等七个部分,实现快速、结构化数据提取。安装Scrapy可使用Anaconda管理Python环境,通过pip安装Scrapy。Scrapy框架适用于提高搜索引擎抓取效率,...

tkinter版猜数游戏 使用scrapy框架爬取河南各城市天气预报

Scrapy是Python开发的一个快速、高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。

从招聘网站上看到python爬虫的工作都需要掌握Scrapy框架以及Selenium技术才恍然大悟,一个成型的框架首先搭建好了一个完整的爬虫逻辑,各个功能也相对封装的很棒,对于大规模数据爬取,只要将对主要爬虫细节进行设计...

Scrapy中使用ImagePipeline 保存图片

文章目录1、scrapy命令2、项目调试2.1、shell控制台调试2.2、parse命令2.3、日志 在编写项目的时候,需要不断的调试代码。同时频繁大量的请求目标网站,可能触发一些安全策略,比如屏蔽IP等等。这时,需要掌握一些...

爬虫技术

scrapy_redis是scrapy框架的基于redis的分布式组件 (3)scrapy_redis的作用 Scrapy_redis在scrapy的基础上实现了更多更强大的功能,具体体现在: 通过持久化请求队列和请求的指纹集合来实现: 断点续爬 ...

推荐文章

- 还在用PPT做组织架构图?公司都在用的架构图软件是什么?_书本里印刷的结构图是用什么软件做的-程序员宅基地

- ESP32-C3 BLE5.0 扩展蓝牙名称长度的流程_蓝牙广播名称过长-程序员宅基地

- centos8安装NVIDIA显卡驱动,docker模式运行机器学习_centos8安装显卡驱动-程序员宅基地

- 利用优先级拥抱需求变更_需求优先级反复变化-程序员宅基地

- 素数筛法_筛法求素数-程序员宅基地

- 【深度长文】细思极恐的YouTube可跳过广告-程序员宅基地

- http作业

- KVstore :键值映射存储服务器

- java-php-python-ssm社区志愿者服务管理系统计算机毕业设计_社区 志愿服务系统源码 php-程序员宅基地

- java/php/node.js/python病人跟踪治疗信息管理系统【2024年毕设】-程序员宅基地