AUC、KS是评价模型对好坏样本区分能力的重要指标,本文将整理它们的指标计算逻辑以及可视化展示的代码模块。

”python程序题求roc-auc是一种常用的模型评价指标“ 的搜索结果

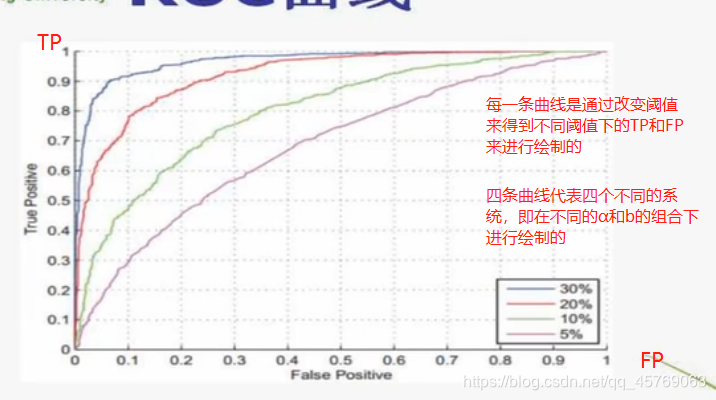

ROC曲线(Receiver Operating Characteristic Curve)以假正率(FPR)为X轴、真正率(TPR)为y轴。曲线越靠左上方说明模型性能越好,反之越差。ROC曲线下方的面积叫做AUC...两种曲线都是分类模型常用的可视化评估工具。

F1评估指标的内容

一、准确率(Precision)和召回率(Recall)(令R(u)是根据用户在训练集上的行为给用户作出的推荐列表,而T(u)是用户在测试集上的行为列表。)对用户u推荐N个物品(记为R(u)),令用户u在测试集上喜欢的物品集合为T(u),然后...

介绍了模型评价的基本概念,以及回归,分类,聚类和降维模型的评价方法和指标等

基本概念precision:预测为对的当中,原本为对的比例(越大越好,1为理想状态)recall:原本为对的当中,预测为对的比例(越大越好,1为理想状态)F-measure:F度量是对准确率和召回率做一个权衡(越大越好,1为理想状态...

上篇讲解了 P-R、ROC、DET 三种曲线,本篇来讲解 AP、AUC 两种指标。指标的作用,就是用一个数字衡量二分类器的好坏,便于对不同的二分类器进行比较。本篇会讲解 AP、AUC 两种指标的定义,它们与各种曲线的关系,...

模型评价是指对于已经建立的一个或多个模型,根据其模型的类别,使用不同的指标评价其性能优劣的过程。常用的聚类模型评价指标有ARI评价法(兰德系数)、AMI评价法(互信息)、V-measure评分、FMI评价法和轮廓系数等。...

笔者在工作中计算单变量的ks值时,发现几个分布不同的变量好y计算的ks值相同,凭借统计直觉,发现一定存在问题,笔者从数据和计算ks代码两个方向进行排除。...那时评价模型的好坏就用传统的机器...

公众号后台回复“图书“,了解更多号主新书内容作者:xiaoyi来源:小一的学习笔记今天继续聊聊模型评估的事儿前面一节提到了模型评估指标中 ROC 的详细概念和四个常见的问题,以后在遇到 R...

评价指标是针对同样的数据,输入不同的算法,或者输入相同的算法但参数不同而给出这个算法或者参数好坏的定量指标。以下为了方便讲解,都以二分类问题为前提进行介绍,其实多分类问题下这些概念都可以得到推广。准确...

ROC曲线是以不同的分类阈值为基础,绘制出真阳性率(True Positive Rate,TPR)和假阳性率(False Positive Rate,FPR)之间的关系曲线。例如,在上面的混淆矩阵中,第一行...在机器学习中,分类模型是常见的一种模型。

在多分类问题中,AUC(Area Under the ROC Curve)可以被视为对模型性能的度量。在Python中计算多分类AUC可以使用多个方法。...同时,由于AUC是一种二分类度量指标,因此需要对多个类别进行平均,通常使用macro平均。

**转载自 https://blog...

最近在打天池的比赛,里面需要用AUC来评测模型的性能,所以这里介绍一下AUC的相关概念,并介绍TensorFlow含有的函数来计算AUC。先介绍一些前置的概念。在一个二分类问题中,如果本身是正例(positive),预测正确也...

P-R曲线 ROC曲线与AUC 代价(CC)曲线

在机器学习的分类任务中,我们常用许多的指标,诸如召回率(Recall)、准确率(Precision)、F1值、AUC等。 那么,如果手动计算AUC应该要怎么计算呢?相信大家很多时候都是用写好的库直接计算,可能对AUC计算不太...

ROC为受试者工作特征曲线,是一种度量二分类性能的指标。 TPR(真正率) ☞所有正例中,分类正确的比例 FPR(假正率) ☞所有负例中,分类错误的比例 ROC曲线即为以FPR为横轴,TPR为纵轴绘制的曲线。 AUC(Area Under...

还有一种较常规的做法是采用广义线性回归中的logistic回归或probit回归。广义线性回归是探索“响应变量的期望”与“自变量”的关系,以实现对非线性关系的某种拟合。这里面涉及到一个“连接函数”和一个“误差函数”...

介绍ROC曲线、AUC的概念、意义以及计算方法

16年,机器学习、深度学习爆炸式增长,无论是作为一种新兴技术还是技术的普及,数据科学的重要性都在逐渐上升。2019 年,中国大学生机器学习大赛评测协会(ACM)发布了“2019 大数据与人工智能专业人才创新训练计划...

推荐文章

- Unity3D 导入资源_unity怎么导入压缩包-程序员宅基地

- jqgrid 服务器端验证,javascript – jqgrid服务器端错误消息/验证处理-程序员宅基地

- 白山头讲PV: 用calibre进行layout之间的比对-程序员宅基地

- java exit方法_Java:如何测试调用System.exit()的方法?-程序员宅基地

- 如何在金山云上部署高可用Oracle数据库服务_rman target sys/holyp#ssw0rd2024@gdcamspri auxilia-程序员宅基地

- Spring整合Activemq-程序员宅基地

- 语义分割入门的总结-程序员宅基地

- SpringBoot实践(三十五):JVM信息分析_怎样查看springboot项目的jvm状态-程序员宅基地

- 基于springboot+vue的戒毒所人员管理系统 毕业设计-附源码251514_戒毒所管理系统-程序员宅基地

- 【LeetCode】面试题57 - II. 和为s的连续正数序列_leet code 和为s的正数序列 java-程序员宅基地