一、前期工作... 3 1.1 爬取目标... 3 1.2 准备工作...... 1.3 爬取思路......1.4 爬取分析......2.3 提取数据... 8 2.4 数据清洗... 12 2.5数据存储... 13 2.6 Cookies池对接... 15 2.7代理池对接... 15 ...

”python—scrapy框架爬虫—链家二手房数据_m0_50360098的博客-程序员宅基地“ 的搜索结果

Scrapy是一个Python编写的开源网络爬虫框架。它是一个被设计用于爬取网络数据、提取结构性数据的框架。 Scrapy 使用了Twisted['twɪstɪd]异步网络框架,可以加快我们的下载速度。 Scrapy文档地址:...

Scrapy 爬虫框架爬取网页数据

说起写爬虫,大多数第一时间想到的就是python了。python语法简洁明了,加上及其丰富好用的库,用它来写爬虫有天然的优势。 之前学python的时候也用requests+lxml写过几个爬虫玩,但是都就爬取一些内容就没继续...

一般教程中教大在命令行运行爬虫: # 方式一 $ scrapy crawl spider_name 这样,每次都要切换到命令行,虽然可以按向上键得到上次运行的指令,不过至少还要敲一次运行命令 还有一种方式是单独配置一个文件,...

Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页内容以及各种图片,非常之方便。 尽管Scrapy原本...

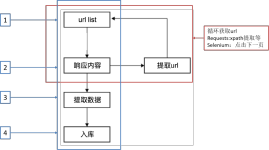

Request对象在爬虫程序中生成并传递到系统,直到它们到达下载程序,后者执行请求并返回一个Response对象,该对象返回到发出请求的爬虫程序。 二、Request对象 一个Request对象表示一个HTTP请求,它通常是在...

Scrapy 是一个用于爬取网站数据和执行抓取任务的Python框架。它提供了一系列的组件,用于构建和管理爬虫项目。Spider(爬虫)Spider 是 Scrapy 的最基本组件,用于定义如何抓取特定网站的数据。每一个 Spider 都包含...

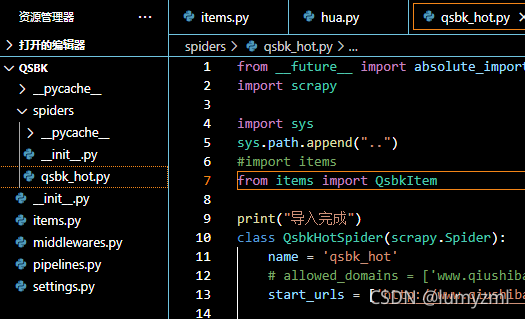

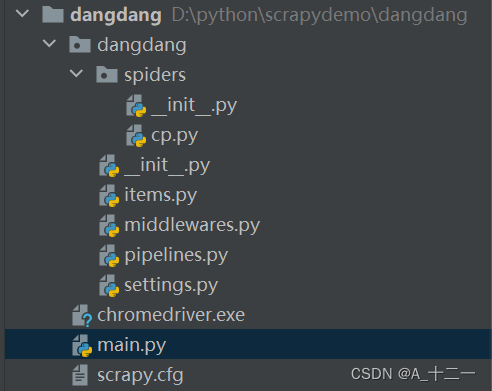

新建项目 在命令行窗口下输入scrapy startproject news,如下 然后就自动创建了相应的文件,如下

爬取58同城二手房数据,将爬取的数据保存在一个csv文件和MongoDB数据库。 代码见:https://github.com/wangjun1996/58tongcheng_spider (运行项目中 zhihuUser/main.py 即可开始爬虫) 本人爬取的是大连市...

Scrapy提供5层logging级别: CRITICAL - 严重错误 ERROR - 一般错误 WARNING - 警告信息 INFO - 一般信息 DEBUG - 调试信息 logging设置 通过在setting.py中进行以下设置可以被用来配置logging: LOG_ENABLED ...

python爬虫进阶篇:利用Scrapy爬取同花顺个股行情并发送邮件通知,来结合现实场景利用scrapy给我们带来便利

Python Scrapy 爬虫 - 爬取多级别的页面 互联网中众多的 scrapy 教程模板,都是爬取 下一页→\rightarrow→下一页形式的,很少有 父级→\rightarrow→子级 的说明。 本文介绍一些使用 scrapy 爬取三级网页的注意事项...

在爬取某个网站时,爬取第一个页面能正常获取,爬取第二个页面,获取文章内容时,返回的数据为中文乱码,乱码如下: {"rptCode":200,"msg":"鎴愬姛","data":{"docId":989402,"docTitle":"閾惰淇濋櫓鏈烘瀯鎭㈠鍜...

如果你是Python2.7环境 sudo apt-get install python2.7-dev 如果你是Python3.6环境 sudo apt-get install python3.6-dev 然后再安装 pip install scrapy

1、搭建环境这里我使用的是anaconda,anaconda里面集成了很多关于python科学计算的第三方库,主要是安装方便,anaconda中自带Spyder。 这里下载anaconda 比较推荐使用Python2.7 在anaconda下安装Scrapy也很简单!...

上篇我们用了beautifulsoup4做了简易爬虫,本次我们用scrapy写爬虫58同城的租房信息,可以爬取下一页的信息直至最后一页。 1、scrapy的安装 这个安装网上教程比较多,也比较简单,就不说了。 2、创建scrapy项目 在...

Python数据爬虫

标签: python

推荐文章

- linux c 串口 调用命令,Linux系统C语言串口收发-程序员宅基地

- 八:通过Infura部署到rinkeby测试网_使用infura运行测试网-程序员宅基地

- 『Android 技能篇』优雅的转场动画之 Transition-程序员宅基地

- Webshell绕过技巧分析之-base64编码和压缩编码-程序员宅基地

- 大一计算机思维知识点,大学计算机—基于计算思维知识点详解.docx-程序员宅基地

- 关于敏捷开发的一篇访谈录-程序员宅基地

- 挑战安卓和iOS!刚刚,华为官宣鸿蒙手机版,P40搭载演示曝光!高管现场表态:我们准备好了...-程序员宅基地

- 精选了20个Python实战项目(附源码),拿走就用!-程序员宅基地

- android在线图标生成工具,图标在线生成工具Android Asset Studio的使用-程序员宅基地

- android 无限轮播的广告位_轮播广告位-程序员宅基地