3、要在不使用horovodrun包装的情况下使用Open MPI运行,请参阅使用Open MPI运行Horovod。5、要在Kubernetes中运行,MPI运算符,Helm Chart,FfDL和Polyaxon。4、要在Docker中运行,请参阅Docker中的Horovod。

”horovod“ 的搜索结果

深度学习并行训练利器:Horovod 项目地址:https://gitcode.com/horovod/horovod Horovod 是一个开源的深度学习分布式训练框架,由 Uber 公司于2017年发布,并迅速在社区中赢得了广泛的关注和使用。它简化了多GPU和多...

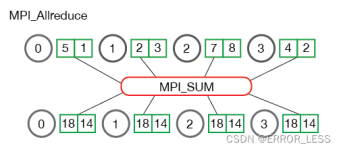

distributed-deep-learning-with-horovod Horovod是基于Ring-AllReduce方法的深度分布式学习插件,以支持多种流行架构包括TensorFlow、Keras、PyTorch等。这样平台开发者只需要为Horovod进行配置,而不是对每个架构...

Horovod需要mpi进行通信,NCLL和CUDA进行编译,所以安装Horovod前需要先安装相应的依赖。

一、Horovod简介 Horovod 是一套面向 TensorFlow 的分布式训练框架,由 Uber 构建并开源,它的发展吸取了Facebook “Training ImageNet In 1 Hour” 与百度 “Ring Allreduce” 的优点,可为用户实现分布式训练提供...

[深度学习] 分布式模式介绍(一) [深度学习] 分布式Tensorflow介绍(二) [深度学习] 分布式Pytorch 1.0介绍(三) ...无论是单机多卡,还是多机多卡,均是分布式训练,在horovod出现之前,使用te...

pytorch在Horovod上训练步骤分为以下几步: import torch import horovod.torch as hvd # Initialize Horovod 初始化horovod hvd.init() # Pin GPU to be used to process local rank (one GPU per process) 分配...

在horovod下使用多机多卡需要满足以下3个先决条件:不同机器可以访问相同的文件:nfs不同机器使用相同的训练环境: Docker不同机器可以ssh交互:ss

horovod_entrypoint描述包装器,用于在docker容器中安装horovod和OpenMPI。 在Dockerfile中用作ENTRYPOINT。 如果提供以下环境设置之一: OpenMPI =版本(例如4.0.0):安装版本4.0.0的OpenMPI HOROVOD =版本(例如...

Horovod是针对TensorFlow,Keras,PyTorch和Apache MXNet的分布式深度学习培训框架。 Horovod的目标是使分布式深度学习快速且易于使用。 Horovod由(LF AI)托管。 如果您是一家致力于在人工智能,机器和深度学习...

Horovod是TensorFlow,Keras,PyTorch和MXNet的分布式训练框架。 Horovod的目标是使分布式深度学习快速且易于使用。 Horovod Horovod 是一个分布式深度学习训练框架,适用于 TensorFlow、Keras、PyTorch 和 Apache ...

Horovod、分布式深度训练

horovod安装文件,可以使用pip直接安装,网络安装已知报错,解决不了啊

Kubernetes 是一个开源的容器编排平台,支持自动部署、扩缩和管理容器化的应用程序,设计原理是基于 Google 多年的生产环境经验,以及社区的最佳实践,可以在物理机、虚拟机、公有云、私有云或混合云等各种基础设施...

horovod使用Distributed training is a set of techniques for using many GPUs located on many different machines for training your machine learning models. Distributed training is an increasingly common ...

horovod:用于TensorFlow,Keras,PyTorch和Apache MXNet的分布式培训框架

Horovod纱线 提前在纱线上提供一个horovod的方案。此方案可以在本地进行多进程的测试 driver启动一个rendevous服务器 各个工人通过注入一些horovod运行时变量,即可启动 司机 python3 driver.py --num_proc=2 ...

并行训练介绍 按照并行方式,分布式训练一般分为数据并行和模型并行两种,当然也有数据并行和模型并行的混合模式。 模型并行:分布式系统中的不同 GPU 负责网络模型的不同部分。例如,神经网络模型的不同网络层被...

安装horovod遇到的问题,Horovod是一种分布式深度学习框架,可在多个GPU服务器之间执行深度学习模型训练。 Horovod的设计目的是使分布式训练尽可能简单,开发人员只需稍微修改现有的单机代码即可实现分布式训练。与...

Horovod分布式运行tensorflow案例

Uber发布的TensorFlow分布式训练框架Horovod

Horovod是一个支持TensorFlow、Keras、PyTorch和Apache MXNet的分布式训练框架。Horovod的目标是让分布式深度学习更快更易用。 为啥不用原生的TensorFlow分布式训练? 1、代码改动多少? 2、比原生的分布式训练快...

只需要安装pytorch GPU版本即可,使用其内部DistributedDataParallel 方法即可实现,方便简单。从终端torchrun启动,初始化使用环境变量,并行实际上是给每个GPU启动一个进程先看整体改动架构,只列出改动部分,适合...

horovod学习整理

标签: tensorflow 分布式

horovod简介 简介 此项目的主要动机是简化单GPU训练脚本并成功扩展它以并行地跨多个GPU进行训练。

pip ins https://pypi.org/project/horovod/#files

Horovod的安装步骤

推荐文章

- 记录CentOS7 Linux下安装MySQL8_适合正式环境_干货满满(超详细,默认开启了开机自启动,设置表名忽略大小写,提供详细配置,创建非root专属远程连接用户)_centos7安装mysql8-程序员宅基地

- python 读取grib \grib2-程序员宅基地

- Kimi Chat,不仅仅是聊天!深度剖析Kimi Chat 5大使用场景!-程序员宅基地

- Datawhale-集成学习-学习笔记Day4-Adaboost-程序员宅基地

- TexStudio配置以及解决无法Build&View_texstudio 无法启动 build & view:pdflatex:"d:/data/texl-程序员宅基地

- 用户空间访问I2C设备驱动-程序员宅基地

- 人脸识别算法初次了解-程序员宅基地

- maven的pom文件学习-程序员宅基地

- wamp mysql 没有启动,WAMP中mysql服务突然无法启动 解决方法-程序员宅基地

- 《树莓派Python编程入门与实战(第2版)》——3.7 创建Python脚本-程序员宅基地