Hive应用实例:WordCount

”WordCount“ 的搜索结果

本篇文章将带大家运行 Flink 最简单的程序 WordCount。先实践后理论,对其基本输入输出、编程代码有初步了解,后续篇章再对 Flink 的各种概念和架构进行介绍。 下面将从创建项目开始,介绍如何创建出一个 Flink 项目...

Java编程MapReduce实现WordCount1.编写Mapperpackage net.toocruel.yarn.mapreduce.wordcount;import org.apache.hadoop.io.IntWritable;import org.apache.hadoop.io.Text;import org.apache.hadoop.mapreduce....

代码是基于windows系统下搭建eclipse+hadoop2.8.3开发实例。使用eclipse直接导入代码使用的前提是,需要在本地配置要hadoop2.8.3,本代码亲测可用,能够详细地统计出dataNode下面的file3.txt文件中单词的个数。

WordCount详解 scala代码 object WordCount extends App{ //1.创建`SparkConf`对象(环境构建 设置相关配置信息) private val conf = new SparkConf() //2.对conf进行设置 conf.setMaster("local").setAppName...

在hadoop上用Python实现WordCount一、简单说明本例中我们用Python写一个简单的运行在Hadoop上的MapReduce程序,即WordCount(读取文本文件并统计单词的词频)。这里我们将要输入的单词文本input.txt和Python脚本放到/...

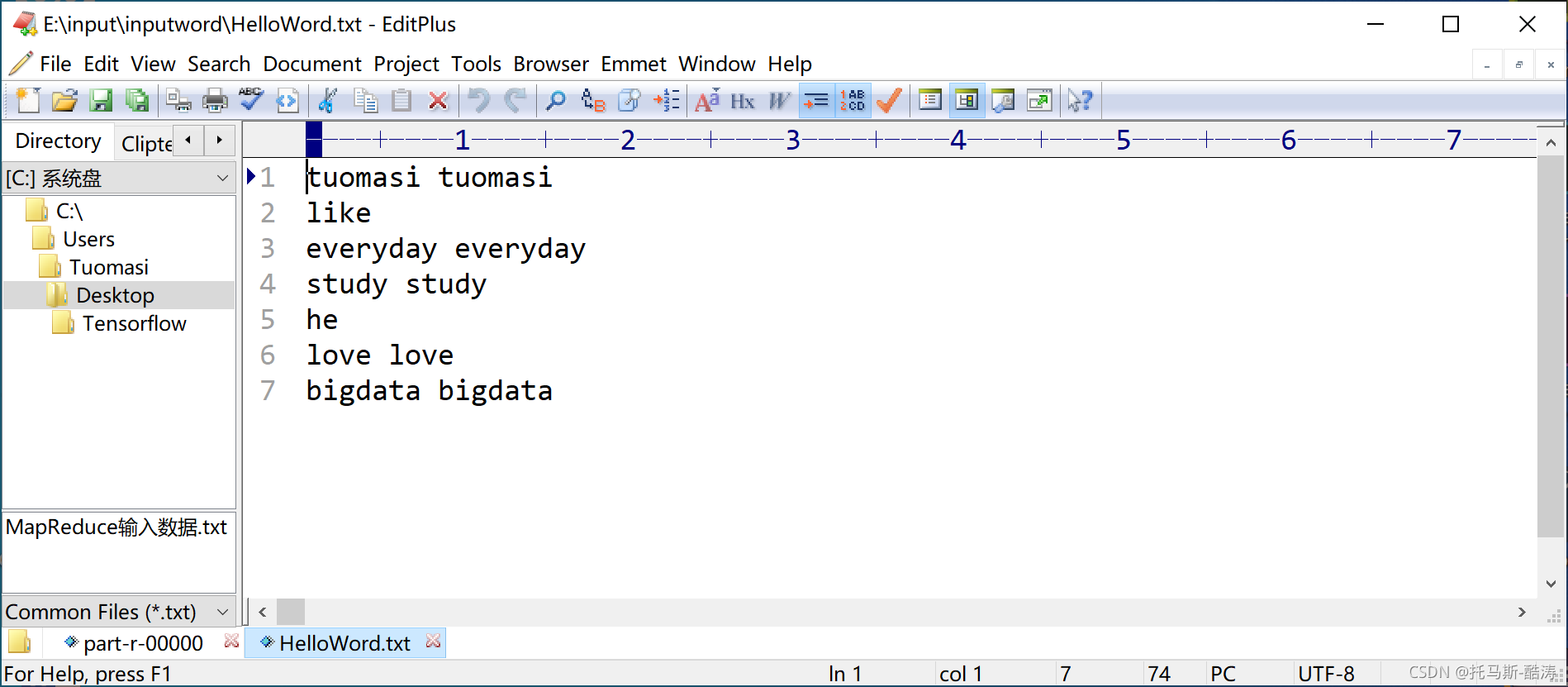

wordcount的本地运行

wordcountReduce.java package MaperReduce; import java.io.IOException; import org.apache.hadoop.io.LongWritable; import org.apache.hadoop.io.Text;...import org.apache.hadoop.mapreduce.Reducer;...

将修改后的文件同步到集群中的其他节点上,不需要重启集群,重新运行原来自己要执行的程序即可正常执行。

package org.apache.hadoop.examples; import java.io.IOException; import java.util.Iterator; import java.util.StringTokenizer; import org.apache.hadoop.conf.Configuration;...import org.apache.hadoop.fs.....

大数据 Hadoop 集群测试 集群上执行wordcount程序

相关连接 HDFS相关知识 Hadoop集群连接 HDFS Java API WordCount程序分析 Eclipse运行WordCount 文件下载 具体步骤

使用Java实现Hadoop的基础WordCount案例,附带本地提交和远程调用源代码参考。

通化远程提交WordCount程序

本代码是spark学习的基础作业Wordcount ,代码简介明了,易于理解,对于初学者来说是一个很好的示例作用

WordCountSort去重复average实例MapRedure编写__动力节点共17页.pdf.zip

编写的程序分成三个部分:Mapper、Reducer和Driver。

Hadoop中MapReduce模型中的WordCount源代码,已测试,可以运行

在执行 `hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount /input /output` 这条指令时,文件的输入和输出路径到底是Linux本地还是HDFS路径主要取决于配置文件中的 `fs.defaultFS`...

wordcount-project

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地