”Java编程与Spark“ 的搜索结果

package com.hj.spark; import java.util.ArrayList; import java.util.Arrays; import java.util.Iterator; import java.util.List;...import org.apache.spark....import org.apache.spark.api.java.JavaRDD; impor.

项目包含325个文件,主要使用Java编程语言,并包含了JavaScript、CSS和HTML。文件类型包括75个GIF图片文件、67个Java源代码文件、52个JavaScript脚本文件、28个PNG图片文件、23个CSS样式文件、20个HTML页面文件、14...

1. DataFrame本片将介绍Spark RDD的限制以及DataFrame(DF)如何克服这些限制,从如何创建DataFrame,到DF的各种特性,以及如何优化执行计划。最后还会介绍DF有哪些限制。2. 什么是 Spark SQL DataFrame?从Spark1.3.0...

Spark 框架是一个快速开发的 Web 框架,其灵感来自 Ruby 的 Sinatra 框架,并围绕 Java 8 Lambda 表达式理念构建,使其比使用其他 Java 框架编写的大多数应用程序更简洁。我们将把控制器逻辑放在 REST API 路由的 ...

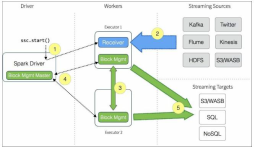

创建 maven 工程 只加 spark-streaming 这个包就可以 4.0.0 com.spark sparkStream 0.0.1-SNAPSHOT junit junit 3.8.1 test <dependency> ...

1.法1:maven打包pom.xml文件maven-assembly-pluginfalsejar-with-dependencies ch.kmeans2.SparkStreamingKMeansKafkaExamplemake-assemblypackageassemblyorg.scala-toolsmaven-scala-plugin2.15.2...

下面将演示如何使用 Apache Spark 的 Java API 来加载数据、筛选出偶数,并计算它们的总和。Apache Spark 是一个强大的分布式计算框架,适用于大规模数据处理任务。

2.java应用程序编码 /*** SimpleApp.java **/ import org.apache.spark.api.java.; import org.apache.spark.api.java.function.Function; public class SimpleApp { public static void main(String

首先,我们通过Spark的交互式shell介绍一下API(主要是Python或Scala),然后展示一下如何用Java、Scala、Python写一个Spark应用。更完整参考看这里:programming guide首先,请到Spark website下载一个Spark发布版本...

通过本篇博客,我们介绍了如何编写一个简单的Spark的Java程序。在实际开发中,您可以根据需求和数据处理逻辑编写更复杂的Spark作业,运用...希望这篇博客能帮助您快速入门Spark的Java编程,享受Spark带来的高效和便利!

Spark算子实战Java版,学到了

执行示例(例如, java java_meetup_spark_demo.Example01_Hello_World ); 这将启动 Web API。 运行相应的脚本(例如, scripts/Example01_Hello_World ),它将卷曲对 API 的请求。 所有这些简单的示例都示例...

这是一个简单的应用程序 apache spark with apache kafka with mode streaming and datastax for connection cassandra with java and apache spark for start test ---mvn package--- run in spark home bin/spark-...

spark入门使用(java) 官方文档:https://spark.apache.org/docs/latest/api/java/index.html 导入依赖 创建maven项目并导入依赖,注意spark的版本 <!--spark的核心依赖--> <dependency> <...

SparkConf conf = new SparkConf().setAppName... .set("spark.executor.memory", sparkConfig.getExecutorMemory()).set("spark.driver.host", sparkConfig.getDriverHost()) // 指定driver的hosts-name .se.

Java IDE:Eclipse 系统类型 64 位操作系统, 基于 x64 的处理器 笔和触控 没有可用于此显示器的笔或触控输入 2、实验内容与完成情况: 1. 安装hadoop和spark。 将下载好的安装包解压至固定路径并安装 使用命令./bin/...

1.相关组件版本 首先确认版本,因为跟之前的版本有些不一样,所以才有必要记录下,另外仍然没有使用scala,使用java8,spark 2.0.0,kafka 0.10。2.引入maven包 网上找了一些结合的例子,但是跟我当前版本不一样,...

本项目是基于Java的Spark数据处理示例设计源码,共包含157个文件,其中主要...项目旨在通过Java编程语言和Spark框架,展示如何使用Spark进行数据处理,提供一系列数据处理示例,帮助开发者理解和掌握Spark的使用方法。

一个简单的Spark Streaming程序将在本地IDE(Eclipse / IntelliJ)上运行。 它从包含聚会事件的输入文件中读取,将事件映射到一组技术类别,并在控制台上打印每个事件类别的计数(每个流批处理窗口每1秒显示一次)。...

上一篇文章中,我们使用了Scala语言调用Spark SQL接口进行了开发,本篇文章我们使用Java语言进行同样业务功能的处理,依然是对JSON、Txt文本进行处理。 JSON和Txt...

spark-redis-bootstrap-buck 使用 spark、redis、bootstrap、jade 和 buck 的 Java 8 web 应用程序堆栈的模板项目 克隆我 安装并启动redis 运行 npm 安装 克隆 buck 并将 buck/bin 放在您的路径上 降压运行:srbb

通常的方式提交spark程序是是通过spark的submit程序实现,例如在linux系统...这里提供两类通过java程序动态提交spark,其中一种是streamsets中提交spark程序的方式。 第一种方式:通过SparkSubmit.main()方法提交 ...

Spark 整合ElasticSearch因为做资料搜索用到了ElasticSearch,最近又了解一下 Spark ML,先来演示一个Spark 读取/写入 ElasticSearch 简单示例。(spark 读取ElasticSearch中数据)环境:IDEA2016,JDK8,windows10,...

本项目是一个基于Java和Scala语言开发的Spark基础教程配套源码,包含55个文件,主要文件类型包括Java源代码、Scala源代码、XML配置文件、日志文件、Git忽略文件、LICENSE文件和Idea配置文件。系统设计旨在为学习...

推荐文章

- Python菜鸟晋级04----raw_input() 与 input()的区别_pycharm没有raw input-程序员宅基地

- 高通AR增强现实多卡识别和扩展跟踪Unity_imagetarget扩展追踪-程序员宅基地

- 对于三星手机的手工root方法-程序员宅基地

- 2021年佛山高考成绩查询,2021年高三佛山一模,看佛山高中排名-程序员宅基地

- 删除并清空应收应付模块 期初数据_应付管理系统怎么清除数据-程序员宅基地

- 嵌入式固件加密的几种方式-程序员宅基地

- 非root情况下访问手机存储位置权限的方法_不root 通讯录 存放目录-程序员宅基地

- Mybatis项目开发流程_使用mybatis的开发步骤-程序员宅基地

- 三方协议,档案,工龄,保险,户口,-程序员宅基地

- 华为交换机命令 端口速率_华为S5700交换机的端口QOS限速问题-程序员宅基地