”对偶图“ 的搜索结果

感知机对偶形式

标签: scikit-learn

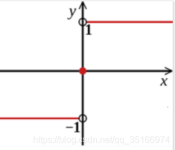

如图,两个问题分别从左右两侧逼近最优值。 如果原问题是求目标函数最小化,那么对偶问题就是在寻找原问题目标函数的下界。 如果原问题是求目标函数最大化,那么对偶问题就是在寻找原问题目标函数的上界。 哪些情况...

代价函数推导 给定一个二分类问题的训练样本集D={(x1,y1),(x2,y2),...,(xm,ym)},yi∈{−1,+1}D={(x1,y1),(x2,y2),...,(xm,ym)},yi∈{−1,+1}D=\{(\boldsymbol{x}_1,y_1),(\boldsymbol{x}_2,y_2),...,(\boldsymbol...

什么是平面图? 平面图的定义就是所有的边只在顶点处相交, 这里就是一个例子... 我们假设上面的例图是图G, 与其对应的对偶图G*, 那么对于G*来说, G*上面的每一个点, 对应的是G里面的每一个面. 比如说下面就是G*...

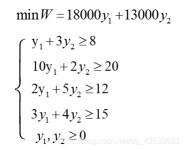

一般情况下采用对偶模型建模并非为对偶而对偶,原因是有些问题采用对偶方式更容易表达。值得注意的是对偶模型的非最优可行解是被建模问题的非可行解,但对偶最优解既是被建模问题的可行解又是被建模问题的最优解...

从便于理解的角度结合图示介绍对偶上升法。

通过为分子增加更多的循环动量,以适应某些切口的值与某些图的对称性之间的张力,我们能够克服障碍。 同时,我们通过确定主分子的高度约束但理想的对称性来控制ansatz的大小。 由此产生的分子具有十二次循环...

图论学习笔记(五)平面图

标签: 图论

本章讨论的图均为平面图 11.1 平面图的基本概念 平面图:如果G可以以除了顶点处以外没有边相交的方式画在平面π上,则称之为可嵌入平面π;如果无向图G可以嵌入平面π,则称为(可)平面图;否则称为非平面图 约当...

如图所示,转换是包含两部分的工作的,第一步是从低维特征向量转换为高维特征向量,第二步是根据高维向量特征训练分类器。 那么现在的任务也从原来的:变成了,或者 其中x是D维,u是维。 至于具体升维操作,也就是...

前面讲了凸优化问题的定义,以及一些常见的凸优化问题类型,这一章就要引入著名的拉格朗日函数和对偶问题了。通过对偶问题,我们可以将一些非凸问题转化为凸优化问题,还可以求出原问题的非平凡下界,这对复杂优化...

《Andrew Ng 机器学习笔记》这一系列文章文章是我再观看Andrew Ng的Stanford公开课之后自己整理的一些笔记,除了整理出课件中的主要知识点,另外还有一些自己对课件内容的理解。同时也参考了很多优秀博文,希望大家...

随着机器学习的深入,慢慢去推导各种机器学习的算法,在推导SVM的算法过程并不顺利,最先就卡在SVM的对偶上,从推导公式上觉得并没有问题,可总觉得抽象晦涩,没有直观的感觉。为此,找了许多关于SVM的资料,仍然...

支持向量机(SVM)——对偶问题

标签: SVM

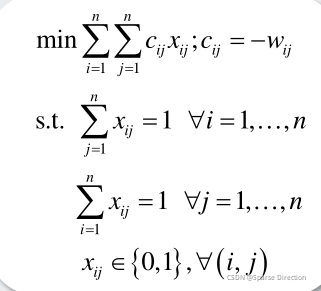

转自西瓜书《机器学习》上节我们介绍了支持向量机的基本型及其推导过程,这节我们对基本型求解。上节我们推导的模型为我们希望求解上式来得到大间隔划分超平面所对应的模型其中w,b是模型参数,注意到式(1)本身是...

文章目录平面图平面图的基本概念约旦定理面和次定理11.2极大平面图欧拉公式平面图的判断平面图的对偶图对偶图的性质自对偶图 平面图的基本概念 可平面图或平面图:可以以这种方式画在平面上,即 使得边与边不在非顶点...

UA SIE545 优化理论基础4 对偶理论简介5 对偶的几何解释 前四讲我们建立了弱对偶与强对偶的概念与理论,这一讲我们试图从直观上理解对偶。 强对偶的几何解释 考虑下面的优化 min(x−2)2s.t.x≥0\min (x-2)^2 \\ s...

1、转化对偶问题 上篇博客中我们得到的目标函数: (1) 我们在优化时喜欢求最小值,将上式转化正等价的求最小值如下: (2) 对于(2)式,这是一个凸二次规划问题,我们可以使用拉格朗日乘数法进行优化。 ...

拉格朗日对偶性 参考:《统计学习方法》李航 约束优化问题中,常常利用拉格朗日对偶性将原始问题转换为对偶问题,通过解对对偶问题而得到原始问题。该方法应用在许多统计学习方法中,例如最大熵模型和支持向量机...

对偶图及其应用模型每个平面图 GG 都有一个与之对偶的平面图 G∗ G∗ 有如下性质: G∗中的每个点对应 GG 中的一个面 对于 GG 中的,每条边 ee ee 属于两个面 f1,f2f_1,f_2 ,加入边 (f∗1,f∗2)(f_1^*,f_2^*) ee ...

在本文中,基于SYK / AdS对偶的概念,我们探讨了强耦合时Yang-Baxter(YB)变形对SYK谱的影响。 在分析的第一部分中,我们探讨了通过Kaluza-Klein(KK)还原对(AdS2)η×(S 1)/ Z 2引起的YB变形的后果。结果证明...

推荐文章

- 【解决报错】java.sql.SQLException: Access denied for user 'root'@'localhost' (using password: YES)-程序员宅基地

- echart y轴显示小数或整数_echarts y轴显示16位小数-程序员宅基地

- Android客户端和Internet的交互_android与internet-程序员宅基地

- linux新建分区步骤_linux创建基本分区的步骤-程序员宅基地

- 信号处理-小波变换4-DWT离散小波变换概念及离散小波变换实现滤波_dwt离散小波变换进行滤波-程序员宅基地

- Ubuntu 10.10中成功安装ns-allinone-2.34_进入/home/ubuntu1/ns-allinone-2.34目录cd /home/ubuntu1-程序员宅基地

- 使用AES算法对字符串进行加解密_java 判断aes加密 与否-程序员宅基地

- DFS深度优先搜索(前序、中序、后序遍历)非递归标准模板_深度优先搜索 无递归-程序员宅基地

- 程序员面试字节跳动,被怼了~_字节跳动java什么技术站-程序员宅基地

- 嵌入式软考备考(五)安全性基础知识-程序员宅基地