浅谈自然语言处理(NLP)学习路线(一)--- 概述_自然语言处理学习路线-程序员宅基地

技术标签: 大道至简系列 python 机器学习 深度学习 学习经验分享 人工智能 # 自然语言处理系列 自然语言处理

资料汇总:

引流:大道至简之机器学习系列

《流畅的python》:https://pan.baidu.com/s/1l5Tl0yZS0NTixAilH9S2aQ 提取码:38qa

《统计学习方法第二版》:https://pan.baidu.com/s/18pg6dUMcMciyO5ZXMrbUJg 提取码:pb7r

西瓜书《机器学习》-周志华:https://pan.baidu.com/s/1mpU-4hfUcVGcjNckjWp6hw 提取码:9yr8

南瓜书(西瓜书公式详解):https://pan.baidu.com/s/1rs6VBcNPf6y6Fda3jDqebA 提取码:k35z

部分论文:seq2seq、word2vector、elmo、transformer、bert 提取码:c3u2

本篇文章属于概述介绍性文章,仅适合于帮助对NLP感兴趣想入门的读者或者准备转行从事NLP的读者来对NLP有一个笼统了解,因此没有太多的细节陈述和公式推导。如果有幸被NLP大佬们阅读,还望多多指出本文瑕疵,给出批评意见,笔者甚为感激!

目录

文档撰写习惯,先抛出总结:

本篇博客泛泛介绍了学习NLP应当练好哪些基础,才能够持续性提升, 这里推荐一个学习网站:ai-learning。

NLP基础学习路线总结:

1. 数学基础:重点是函数性质、导数(特别是对矩阵求偏导)、不同概率的定义和性质、数学期望、参数估计、梯度下降法

2. 机器学习:重点是LR、Xgboost、HMM、CRF

3. 传统文本算法: n-gram、tf-idf、textrank、lda

4. 经典神经网络语言模型:LSTM、NNLM、word2vector、fasttext

5. 进阶神经网络语言模型:elmo、transformer、gpt、bert

一、拉齐认知

众所周知,视觉和语言绝对是人工智能的两大要素,在人工智能领域,视觉涉及到图像识别、目标检测、语义分割、图像变换(风格转换等)、图像生成等,商业应用涉及到自动驾驶、视频安全、视频运营等行业的关键帧抽取、精彩片段抽取、姿态估计、行为识别等;自然语言处理涉及到文本分类、文本聚类、实体识别&抽取、摘要提取、关键词抽取、新词发现、文本生成、翻译问答等,商业应用涉及到家用&工业智能、网络安全等行业中语音转文、图谱构建、即时翻译、舆情分析、内容质量评估等。

以上视觉图像处理和自然语言处理作为基础技术结合起来,还能辅助提升搜广推技术在商业一线场景的变现能力。因此,市场上对图像和语言类算法的人才需求仍然很大,虽然受经济环境影响,岗位需求有所收紧,但收紧的目的是提高招聘门槛,提高用人质量,并非这些技术不管用了,不管是图像还是语言,只有踏踏实实一步一个脚印的去啃,才能提升自己的硬实力。只要技术够硬,就不要去忧前景之虑,这一点希望行业小伙伴们能够拉齐认知。

很多人对于NLP的认识或多或少都有它是一门不够成熟的技术的印象。的确,如果它已经足够成熟了,那还有我们什么事,也正是因为它不够成熟,才会有更多的挑战和机会等着我们去挖掘,我们才有更大的概率成为强者。我们清楚,在人类文明发展历史中,视觉是先于语言出现的,所以难免图像技术发展的比自然语言处理技术要更为充分。一副图像,我们看到是什么样,那它就客观的是什么样,但语言不同,很多时候,你说一句话,它可能夹杂着太多的情绪和内涵在里面,如何能够让计算机理解一句话,正是我们NLP面临的巨大挑战之一,所以如果缺少NLP技术的佐助,人工智能只能是个“聋子”,为什么说是“聋子”,是因为以后我们传入给机器的很可能是语音,语音再转文字让机器理解,这也反映了自然语言处理和语音处理技术是密不可分的。因此我认为,NLP仍然还有非常多的非常有意义的课题值得我们去研究。

二、从事NLP需要具备哪些基础技能

1. 开发工具

开发工具包括编程语言、常用包,编程语言个人比较建议Python,其编程风格可读性好,易懂好上手。对于没有基础的同学,可以阅读一些Python的基础入门书籍,这里不作过多推荐。对于有一定基础的同学,强烈推荐大家读一读《流畅的Python》这本书。电子书传送门:https://pan.baidu.com/s/1l5Tl0yZS0NTixAilH9S2aQ 密码: 38qa

至于编程平台,学习阶段可以使用jupyter notebook,工程开发阶段推荐使用Pycharm。

Linux常用命令一定要会,我们工作环境基本都是在无图形界面的Linux系统中,打交道最多的就是服务器,所以要从感性层面熟悉Linux系统。

Java和SQL也需要会基础,因为在工作中,模型的线上服务接口开发和部署几乎都会是基于Java去做的。而SQL是因为很多公司大量的数据都是存在后台数据库中,很多时候需要你自己写SQL代码查询、筛选和处理数据,除此之外,还要掌握一些基础的ES(Elasticsearch)搜索语句,由于它强大的搜索性能,现在被广泛应用在搜索推荐场景。将数据导出后,才适合用Python做进一步的数据分析处理。

谈到数据分析处理,这是NLP非常重要的一步,有句话说的很好:数据质量决定了指标的上限,模型优化只是在不断逼近这个上限。因此,算法工程师一定要懂得数据先行的道理。python中的pandas包对于数据分析是非常好用的,建议同学们花时间重点学一下它,pandas一般用在分析数据分布,组合数据,筛选数据等。此外,正则表达式也是一个非常常用技术,一般会用它来清洗数据中的一些噪声,例如html标签、url、特殊字符等。如果是较为简单的数据匹配,例如通过一些关键词来筛选数据,有时候前缀树Trie树也是一个非常好用的辅助工具,它的匹配效率比正则匹配高很多。Trie树有python实现的接口,参考 https://github.com/abusix/ahocorapy。具体的数据分析处理方法,还需要具体问题具体分析,这里只做普及式介绍。

2. 机器学习

参考学习资料:

书籍:见文章开头

我把NLP的技术分为两大类:基于机器学习的传统NLP技术和基于深度学习的新兴NLP技术。其实图像也是如此。但不管是哪一类,我都想首要的抛出我的观点,学习NLP,一定要先掌握经典机器学习算法。为什么呢?就我个人经验来看,人工智能不管如何发展,最后究其祖先,都仍然脱离不了机器学习算法的影子,而机器学习无非就是包了一层高级外衣的概率论与数理统计原理。所以,先学好常见机器学习算法!

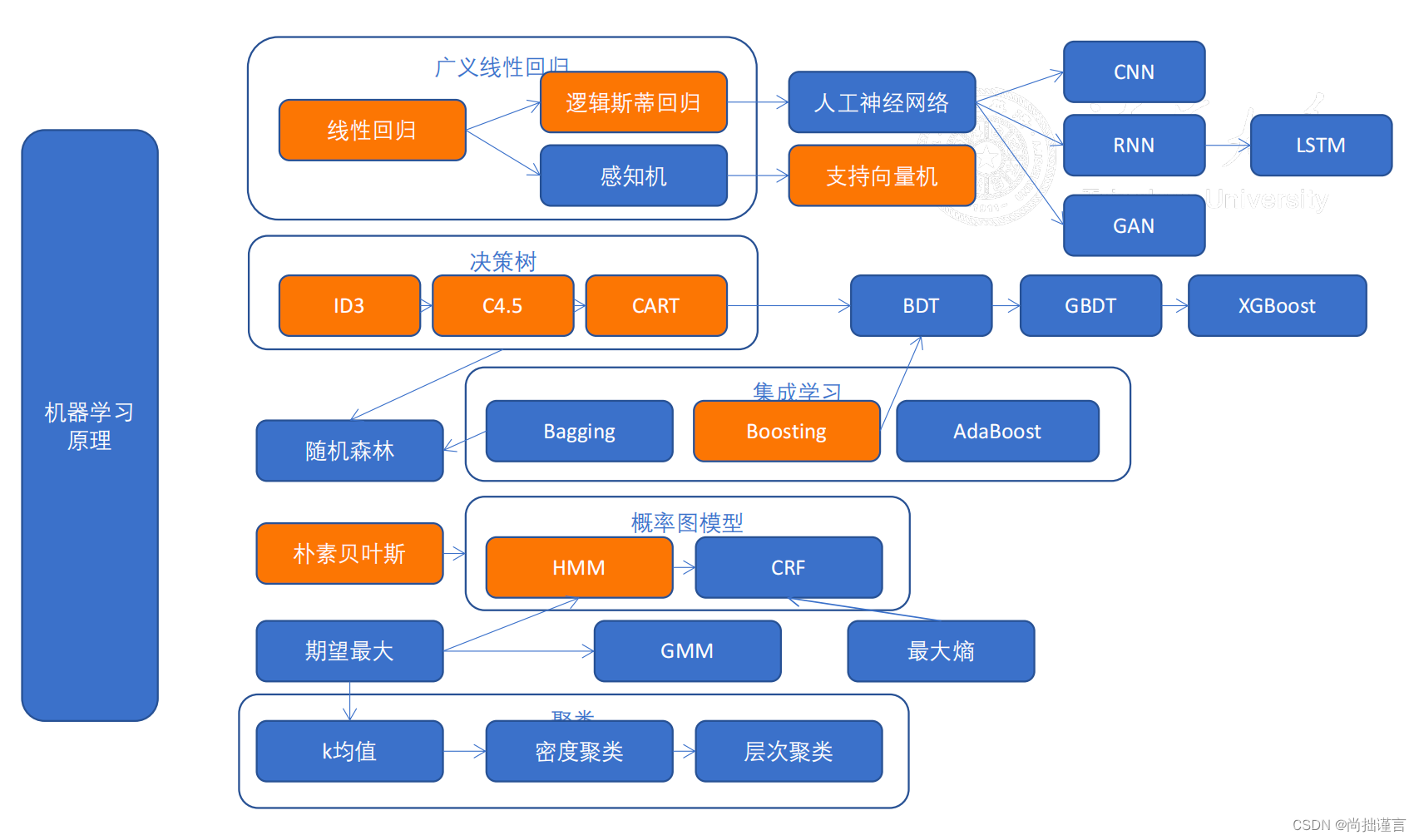

关于机器学习的学习路线,这里有张我个人认为总结的比较好的图分享给大家(图2-1):

大家可订阅笔者的专栏-大道至简系列之机器学习系列,我会跟着大家一起学习,持续更新,这里大家参照上图先有个印象。

3. 数学基础

不管是深度学习还是机器学习都包含了大量数学的内容,因此大家必须对数学基础也应当有所掌握,最常见的就是微积分、概率论、统计学、矩阵论、数值分析,因为这些都涉及到机器学习算法的一些公式由来,和一些优化方法的原理。依我个人见解,并不是说非要全部掌握相关的数学原理,毕竟除了业界的少数大佬,我相信大部分玩儿机器学习和深度学习的小伙伴并非纯数学专业和数学领域的专家,我们在学习的过程中,一定要有的放矢,对于一些核心的公式我们要重点吃透,用到哪里学到哪里,先把基本概念厘清,先把重点结论记住并跟着学习资料尝试推导,遇到不懂的地方,先做个标记,等全部学完,并coding实战过,再回过头来,把之前不懂的地方搞清楚,这个时候很可能需要延伸查阅许多辅助资料,过程很痛苦,但是我希望大家能坚持下来。如果遇到一些需要追溯到上古时代的数学原理,我个人建议不要去死扣,记住结论即可,例如EM算法中的Jensen不等式,如果有精力,可以去尝试推导证明一下它是怎么来的,如果精力有限,那么记住它的结论即可,除非今后真的遇到必须理解它的证明过程才能进行下去的工作再去学也不迟。

总结来说,要了解的数学知识有:

(1)概率论与数理统计:联合概率、条件概率、概率密度、概率分布、数学期望、参数估计等;

(2)高等数学:微积分、几何基础、函数(连续性、收敛性、凸函数等)、极限等;

(3)线性代数:矩阵运算、矩阵求导、矩阵变换,可行解分析等;

(4)数值分析:二分法、牛顿法、最小二乘法、最速下降法等;

感觉很琐碎有木有,还是那句话,用到哪学到哪,学到哪,查到哪。

4. 基于统计学的文本处理算法

说两个比较经典的基于统计学的文本处理算法:统计语言模型(N-Gram)和TF-IDF,n-gram模型一般用来判断一段文字是否符合自然语法,tf-idf一般用来做关键词提取或者词过滤,在搜索推荐场景也会用来做词权重计算。对于关键词提取,还有个很有名的算法是textrank,GitHub上有个中文的textrank开源实现:https://github.com/letiantian/TextRank4ZH

tf-idf使用前提是基于多篇文档来计算的,每个词不仅需要考虑在其所在文章中的出现频率,还要考虑在一堆文章中出现的情况,而textrank仅针对一篇文章就能计算出关键词 ,这是因为tf-idf算法是纯统计类的,而textrank用到了图计算的概念,这里先不展开,后续有机会补上。

TF-IDF公式补充:

i是第i个词,j是wi所在的第j篇文章,N是第j篇文章所有词之和。TF就是某篇文章中某个词出现的频率;

D是所有文章数之和,dj是第j篇文章。IDF指的是文章数之和与包含某个词的文章数之和的比值。

由公式可以看出,当某个词在一篇文章中出现的次数多而在其它文章中出现的少,TF-IDF值越大,说明该词在本篇文中的重要性高。

我重点讲一下n-gram模型,因为它和我们后面的Bert等语言模型有着发展脉络的关系。简单来讲,n-gram模型是个纯粹的语言模型,但是是基于统计的语言模型,它的算法思想由来起源于我们人类的语言习惯。例如“我热爱自然语言处理技术”和“我热情自然话语处理技术”这两句话,n-gram模型能够判断出哪句话符合人类语言习惯的概率较大,直观上,我们一眼就能看出前一句更符合我们的语言习惯。对于模型来说,它是怎么做到的呢?是这样的,当我们喂给模型足够多的正规语言样本后,经过统计,它能够算出每个字或者词与后续的字词组合起来的概率有多大,例如上面的例子,当我们的训练样本中出现的是“我热爱自然语言处理技术”,那么在测试样本中,它就会根据由训练样本统计出来的词表计算:“我”出现的条件下“热爱”出现的概率,“我热爱”出现的条件下,“自然”出现的概率,以此类推,最终就是

P("我, 热爱, 自然, 语言, 处理, 技术") =

P("我")P("热爱"|"我")P("自然"|"我, 热爱")P("语言"|"我, 热爱, 自然")P("处理"|"我, 热爱, 自然, 语言")P("技术"|"我, 热爱, 自然, 语言, 处理")

也就是第t个单词出现的概率与前 i 到 t-1 个单词相关:

对于上述公式能求出这段文字的一个概率,当然,我这里只是为了大家有个直观感受,写的过于简单,实际操作要更复杂一些。看,这其实就是求似然概率。n-gram中的n表示限制每次要计算相邻的n个词的似然值。

除了上述介绍的算法之外,作为NLP算法工程师还应当掌握隐马尔科夫模型(HMM)、条件随机场(CRF),因为它们和命名实体、分词、词性标注等实际任务都有很强的关联,特别是近几年Bert的爆发,已经有很多实验证明,Bert+CRF在做实体识别、词性标注等任务上的效果非常可观,而隐马尔科夫模型的另一个重要应用场景就是语音识别,李开复先森就是用它,完成了卡内基梅隆大学的博士毕业论文。可见这两个算法是如此的重要。当然,它们也属于机器学习算法的范畴,以后慢慢再道。其它的算法我没介绍到,并不是不重要,有没有一种可能,就是本人没有考虑到,亦或是我在实际工作中用到的比较少。总之,欢迎小伙伴们进行补充哈~

5. 基于深度学习的文本处理

介绍完传统文本处理算法,终于到了我们的重头戏了,那就是基于神经网络的文本处理模型了。不过要抱歉的是,这方面内容比较多比较杂,所以我按照比较经典的模型有选择性的进行脉络简述,细节上,我会在往后的博客里会跟着大家一起品~

5.1 神经网络语言模型(NNLM)

第一个我想介绍的是神经网络语言模型(NNLM),有一些童鞋比较少听说过这个网络,感觉它很低调,但是我个人认为,这是个非常经典的NLP基础网络,是一款非常适合基于深度神经网络的NLP入门的模型。可以认为它是n-gram模型的高级版,因为它利用神经网络技术对公式

进行了描述,与此同时,NNLM网络中做了词嵌入的工作,因此它还生成了后面会讲到的非常有名的word2vector模型原形。所以我认为它在传统文本算法和神经网络文本算法中间起到了承上启下的重要纽带作用。而且该网络中还用到了残差的思想,这一设计在目前非常著名的Transformer模型中也有应用,所以我说,NNLM虽然简单,但是非常经典和重要,想学NLP的小伙伴,应当对它有所掌握。

NNLM模型可以用以下公式描述:

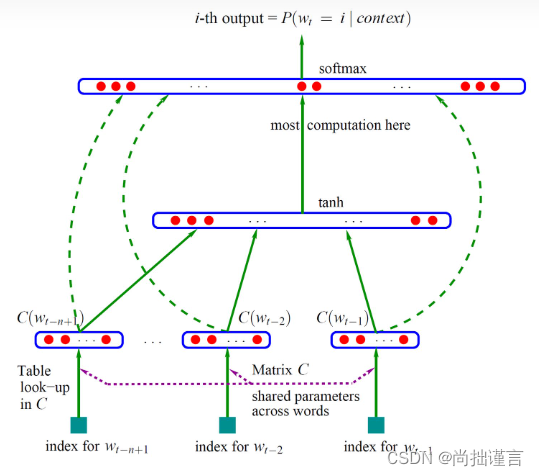

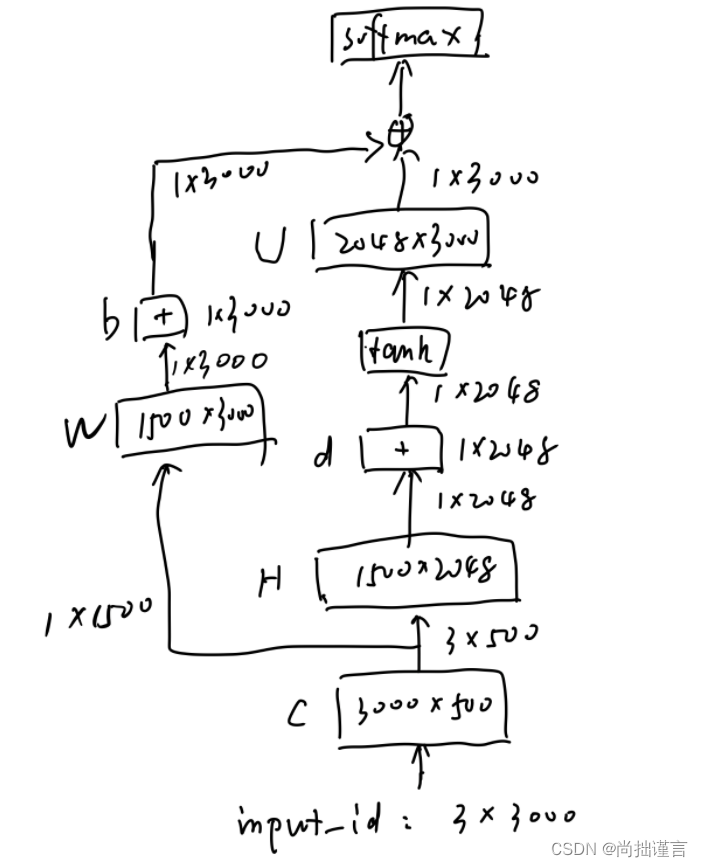

y是网络的输出,b+Wx是线性层,和我们的线性回归是一样的,W、U、d、H都是一些权值矩阵,x是网络的输入。简而言之,它是由一个线性组份b+Wx和一个非线性层组成的。它的网络结构长这样(图5-1-1):

学网络一定要从维度变换学起,那么把这个图转换成维度变换图(图5-1-2):

有点丑,以后具体介绍该网络的时候再补个美颜版的哈~

上图中,input-id是one-hot形式的向量,3是网络输入文本的大小,3个词,比如‘我’、‘爱’,‘你’。3000是我们预先定义好的词表,有3000个词,那么input-id每一行中,每个输入词在3000词表里对应的位置为1,其余位置为0。

对于网络的输出y,其实还有一层处理,就是softmax,它能够将一次输出的所有预测值映射到0~1之间,转换成概率值,且所有概率值之和为1,最大的那个概率值所在的位置就是我们要预测的单词。对于softmax的介绍,网上有太多了,而且一看就懂,这里不再赘述。

5.2 Word2Vector

这是个非常有名的模型,而且我个人猜测,NLP之星Bert十有八九也是或多或少受到这个模型的启发而设计出来的。word2vector这个模型吧,有两种实现方式:CBOW和Skip-gram。对于一段文本,第一一个滑动窗口大小,那么窗口每滑到文本的一个位置,就用窗口内的周围此预测窗口内的中心词,这种方式叫做CBOW,同理,用窗口内的中心词预测窗口内的剩余词,这种方式叫Skip-gram。了解Bert的同学有木有感觉很熟悉?

在n-gram模型中,它只能统计每个词的分布,但无法考虑每个词的上下文语义信息,这对于自然语言的理解是非常不利的。而在word2vector中,由于工作机制的不同,它能够兼顾每个词上下文的语义信息,显然它的表现会比n-gram好很多。

在图5-1-2中,input-id是我们要输入的3个词的one-hot,它和C点乘能够得到3个词的向量表示,这个C就是word2vector的前身。所以只要训练好C,那么我们就能够得到词表范围内任意词的向量表示,这个向量表示可以用在超级多的地方,例如相似词检索(两个词向量求余弦距离)、相似文本判断(多个词向量)、文本分类等。

最后补充一句,word2vector有一个更高级的优化版-fasttext。

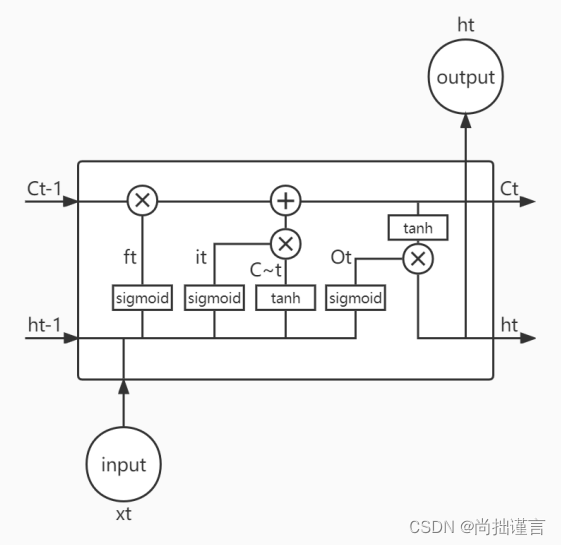

5.3 长短时记忆网络(LSTM)

LSTM属于RNN网络,它是个序列模型,因此对处理同为序列样本的文本来说非常适合,所以LSTM是不得不掌握的另一个重要网络。网上关于该网络的介绍都烂大街了,感兴趣的小伙伴可以自行查阅,如果有需要我专门出一篇文章讲它的,可以私信留言~

这里只强调两点:LSTM的网络结构以及LSTM的重要公式

(1)LSTM网络结构:

(2)LSTM的重要公式

遗忘门:

输入门:

候选集:

更新门:

输出门:

隐向量输出:

以上内容必须熟记,图要会画,公式要会写,而且每个公式都能和图对应起来解释。

一般来讲,一段文字输入到LSTM单元后,我们可以取每一步输出的ht,接一些后续计算实现词性标注、实体等任务,也可以取最后一步输出的ht接一个线性层做文本分类,或者直接把它当成段文字的向量表示用作向量检索。

补充一点内容,我们平常所说的seq2seq,其实并不是一种模型,而是泛指序列到序列的任务,例如翻译、问答等,它是由Encoder-Decoder框架组成的,而其中的encoder和decoder,又是由各种神经网络组成的,比如它们可以是LSTM、GRU、CNN、Transformer等。

5.4 进阶神经网络语言模型

5.1~5.3我们介绍了一些传统的经典NLP神经网络,我认为要入门NLP,对于神经网络部分的学习,这些是基础中的基础了。后面的像基于Transformer的Bert及其变种、XLNet、elmo、T5、GPT系列等高级神将网络,基本都是在这些基础网络的结构上做比较深层次的改进和发展了,所以,千里之行始于足下,一定要注重基础知识的学习!

一方面,高级神经网络一直在出新,没有一一介绍的必要,也没有可能介绍完,当然后期我会持续性的撰写相关博客和大家一起交流学习。另一方面,本着以不变应万变的哲学观,本节就简单的告诉大家,对于高级神经网络我认为应该先学会哪些。

第一:Transformer。特别是对于自注意力机制,一定要弄懂,我会专门抽一期讲这个网络;

第二:elmo。它也是传统神经网络向高级神经网络进阶的枢纽;

第三:GPT。它是第一个基于Transformer应用的高级神经网络,理解它,就能对比的理解Bert为何而来;

第四:Bert。其重要性我就不用多说了,一定要深入掌握,它是自Bert诞生到现在,各种新兴高级神经网络的基石,像ALBert、RoBerta、XLNet、T5等,都是基于它的各种优化变种。

6. 算法开发常用的工具库

作为NLP算法工程师,一些常用的开源包应该能够熟练使用,这里列举几种:

sklearn:机器学习算法集成包,包含了大部分机器学习算法以及数据处理和可视化API;

transformers:pytorch版的各种深度神经网络语言模型实现,目前该库已经封装成了api,并提供了许多预训练模型,模型定义在src/transformers/models下,推荐阅读模型源码;

nltk:自然语言处理工具包,涵盖了大量NLP任务接口;

gensim:也是一个自然语言处理库,涵盖了常用的传统自然语言处理算法;

jieba:最常用的分词工具,它还包含了词性标注、关键词抽取等功能;

三、总结

本篇博客泛泛介绍了学习NLP应当练好哪些基础,才能够持续性提升, 这里推荐一个学习网站:ai-learning。

好了,告一段落,对NLP基础学习路线做个总结:

1. 数学基础:重点是函数性质、导数(特别是对矩阵求偏导)、不同概率的定义和性质、数学期望、参数估计、梯度下降法

2. 机器学习:重点是LR、Xgboost、HMM、CRF

3. 传统文本算法: n-gram、tf-idf、textrank、lda

4. 经典神经网络语言模型:LSTM、NNLM、word2vector、fasttext

5. 进阶神经网络语言模型:elmo、transformer、gpt、bert

由于时间有限,写的比较仓促,希望各位读者对文中出现的错误之处能及时指出并给与批评,感谢关注!

智能推荐

什么是内部类?成员内部类、静态内部类、局部内部类和匿名内部类的区别及作用?_成员内部类和局部内部类的区别-程序员宅基地

文章浏览阅读3.4k次,点赞8次,收藏42次。一、什么是内部类?or 内部类的概念内部类是定义在另一个类中的类;下面类TestB是类TestA的内部类。即内部类对象引用了实例化该内部对象的外围类对象。public class TestA{ class TestB {}}二、 为什么需要内部类?or 内部类有什么作用?1、 内部类方法可以访问该类定义所在的作用域中的数据,包括私有数据。2、内部类可以对同一个包中的其他类隐藏起来。3、 当想要定义一个回调函数且不想编写大量代码时,使用匿名内部类比较便捷。三、 内部类的分类成员内部_成员内部类和局部内部类的区别

分布式系统_分布式系统运维工具-程序员宅基地

文章浏览阅读118次。分布式系统要求拆分分布式思想的实质搭配要求分布式系统要求按照某些特定的规则将项目进行拆分。如果将一个项目的所有模板功能都写到一起,当某个模块出现问题时将直接导致整个服务器出现问题。拆分按照业务拆分为不同的服务器,有效的降低系统架构的耦合性在业务拆分的基础上可按照代码层级进行拆分(view、controller、service、pojo)分布式思想的实质分布式思想的实质是为了系统的..._分布式系统运维工具

用Exce分析l数据极简入门_exce l趋势分析数据量-程序员宅基地

文章浏览阅读174次。1.数据源准备2.数据处理step1:数据表处理应用函数:①VLOOKUP函数; ② CONCATENATE函数终表:step2:数据透视表统计分析(1) 透视表汇总不同渠道用户数, 金额(2)透视表汇总不同日期购买用户数,金额(3)透视表汇总不同用户购买订单数,金额step3:讲第二步结果可视化, 比如, 柱形图(1)不同渠道用户数, 金额(2)不同日期..._exce l趋势分析数据量

宁盾堡垒机双因素认证方案_horizon宁盾双因素配置-程序员宅基地

文章浏览阅读3.3k次。堡垒机可以为企业实现服务器、网络设备、数据库、安全设备等的集中管控和安全可靠运行,帮助IT运维人员提高工作效率。通俗来说,就是用来控制哪些人可以登录哪些资产(事先防范和事中控制),以及录像记录登录资产后做了什么事情(事后溯源)。由于堡垒机内部保存着企业所有的设备资产和权限关系,是企业内部信息安全的重要一环。但目前出现的以下问题产生了很大安全隐患:密码设置过于简单,容易被暴力破解;为方便记忆,设置统一的密码,一旦单点被破,极易引发全面危机。在单一的静态密码验证机制下,登录密码是堡垒机安全的唯一_horizon宁盾双因素配置

谷歌浏览器安装(Win、Linux、离线安装)_chrome linux debian离线安装依赖-程序员宅基地

文章浏览阅读7.7k次,点赞4次,收藏16次。Chrome作为一款挺不错的浏览器,其有着诸多的优良特性,并且支持跨平台。其支持(Windows、Linux、Mac OS X、BSD、Android),在绝大多数情况下,其的安装都很简单,但有时会由于网络原因,无法安装,所以在这里总结下Chrome的安装。Windows下的安装:在线安装:离线安装:Linux下的安装:在线安装:离线安装:..._chrome linux debian离线安装依赖

烤仔TVの尚书房 | 逃离北上广?不如押宝越南“北上广”-程序员宅基地

文章浏览阅读153次。中国发达城市榜单每天都在刷新,但无非是北上广轮流坐庄。北京拥有最顶尖的文化资源,上海是“摩登”的国际化大都市,广州是活力四射的千年商都。GDP和发展潜力是衡量城市的数字指...

随便推点

java spark的使用和配置_使用java调用spark注册进去的程序-程序员宅基地

文章浏览阅读3.3k次。前言spark在java使用比较少,多是scala的用法,我这里介绍一下我在项目中使用的代码配置详细算法的使用请点击我主页列表查看版本jar版本说明spark3.0.1scala2.12这个版本注意和spark版本对应,只是为了引jar包springboot版本2.3.2.RELEASEmaven<!-- spark --> <dependency> <gro_使用java调用spark注册进去的程序

汽车零部件开发工具巨头V公司全套bootloader中UDS协议栈源代码,自己完成底层外设驱动开发后,集成即可使用_uds协议栈 源代码-程序员宅基地

文章浏览阅读4.8k次。汽车零部件开发工具巨头V公司全套bootloader中UDS协议栈源代码,自己完成底层外设驱动开发后,集成即可使用,代码精简高效,大厂出品有量产保证。:139800617636213023darcy169_uds协议栈 源代码

AUTOSAR基础篇之OS(下)_autosar 定义了 5 种多核支持类型-程序员宅基地

文章浏览阅读4.6k次,点赞20次,收藏148次。AUTOSAR基础篇之OS(下)前言首先,请问大家几个小小的问题,你清楚:你知道多核OS在什么场景下使用吗?多核系统OS又是如何协同启动或者关闭的呢?AUTOSAR OS存在哪些功能安全等方面的要求呢?多核OS之间的启动关闭与单核相比又存在哪些异同呢?。。。。。。今天,我们来一起探索并回答这些问题。为了便于大家理解,以下是本文的主题大纲:[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-JCXrdI0k-1636287756923)(https://gite_autosar 定义了 5 种多核支持类型

VS报错无法打开自己写的头文件_vs2013打不开自己定义的头文件-程序员宅基地

文章浏览阅读2.2k次,点赞6次,收藏14次。原因:自己写的头文件没有被加入到方案的包含目录中去,无法被检索到,也就无法打开。将自己写的头文件都放入header files。然后在VS界面上,右键方案名,点击属性。将自己头文件夹的目录添加进去。_vs2013打不开自己定义的头文件

【Redis】Redis基础命令集详解_redis命令-程序员宅基地

文章浏览阅读3.3w次,点赞80次,收藏342次。此时,可以将系统中所有用户的 Session 数据全部保存到 Redis 中,用户在提交新的请求后,系统先从Redis 中查找相应的Session 数据,如果存在,则再进行相关操作,否则跳转到登录页面。此时,可以将系统中所有用户的 Session 数据全部保存到 Redis 中,用户在提交新的请求后,系统先从Redis 中查找相应的Session 数据,如果存在,则再进行相关操作,否则跳转到登录页面。当数据量很大时,count 的数量的指定可能会不起作用,Redis 会自动调整每次的遍历数目。_redis命令

URP渲染管线简介-程序员宅基地

文章浏览阅读449次,点赞3次,收藏3次。URP的设计目标是在保持高性能的同时,提供更多的渲染功能和自定义选项。与普通项目相比,会多出Presets文件夹,里面包含着一些设置,包括本色,声音,法线,贴图等设置。全局只有主光源和附加光源,主光源只支持平行光,附加光源数量有限制,主光源和附加光源在一次Pass中可以一起着色。URP:全局只有主光源和附加光源,主光源只支持平行光,附加光源数量有限制,一次Pass可以计算多个光源。可编程渲染管线:渲染策略是可以供程序员定制的,可以定制的有:光照计算和光源,深度测试,摄像机光照烘焙,后期处理策略等等。_urp渲染管线