机器学习-9 降维算法——PCA降维-程序员宅基地

降维算法

算法概述

降维的概念

①降维(Dimensionality Reduction,DR)是指采用线性或者非线性的映射方法将高维空间的样本映射到低维空间中。

②降维获得低维空间的数据等价表示,实现高维数据的可视化呈现。

降维的作用

①在原始的高维空间中,包含有冗余信息以及噪声信息。图像识别中如果噪声太多会造成误差,降低识别准确率;通过降维,可以减少冗余信息所造成的误差,提高识别的精度、降低算法开销。

②通过降维可以寻找数据内部的本质结构特征。

③降维可以得到原始数据的简化表示以加速后续处理或者改进输出结果,即降维可以得到原始数据的简化表示以加速后续处理或者改进输出结果,因此它已经成为很多算法数据进行预处理的重要手段。

降维的本质

在机器学习领域,降维的本质是学习一个映射函数 f : x − > y f: x -> y f:x−>y,其中x是原始数据点的表达,目前最多使用向量表达形式。y是数据点映射后的低维向量表达,通常y的维度小于x的维度。y可能是显式的或隐式的、线性的或非线性的函数。

常见算法分类

降维算法可分为线性降维和非线性降维两大类:

- 线性降维假设构成数据集的各变量间独立无关。

1)主成分分析(Principal Component Analysis,PCA)

2)独立成分分析(Independent Component Analysis,ICA)

3)线性判别分析(Linear Discriminant Analysis,LDA)- 非线性降维方法,也称为流形学习方法(Manifold Learning),其目标是从高维采样数据中恢复低维流形结构,不改变数据本身的拓扑特性。(了解为主,本文主要讲解PCA)

1)基于保持全局结构信息,如等距离映射算法ISOMAP。

2)关注局部结构信息,如LLE、LE、HLLE。

主成分分析(PCA)

- 主成分分析(Principal Component Analysis,PCA)是最常用的一种降维方法,它的目标是通过某种线性投影,将高维的数据映射到低维的空间中,并期望在所投影的维度上数据的方差最大,以此使用较少的维度,同时保留较多原数据的维度。具体而言,PCA可以把具有相关性的高维变量合成为线性无关的低维变量,称为主成分。主成分能够尽可能保留原始数据的信息。

- PCA算法目标是求出样本数据的协方差矩阵的特征值和特征向量,而协方差矩阵的特征向量的方向就是PCA需要投影的方向。使样本数据向低维投影后,能尽可能表征原始的数据。

- 如果把所有的点都映射到一起,那么几乎所有的区分信息都丢失了,而如果映射后方差尽可能的大,那么数据点则会分散开来,特征更加明显。PCA是丢失原始数据信息最少的一种线性降维方法,最接近原始数据。

降维分析

通俗的来讲,二维数据就是把点投射成一条线,数据集的每个样本都可以用一个值表示,不需要两个值。三维数据可以降成二维,就是把变量映射到一个平面。一般情况下,n维数据集可以映射降成k维子空间,其中k<n。

数据压缩2D-1D:

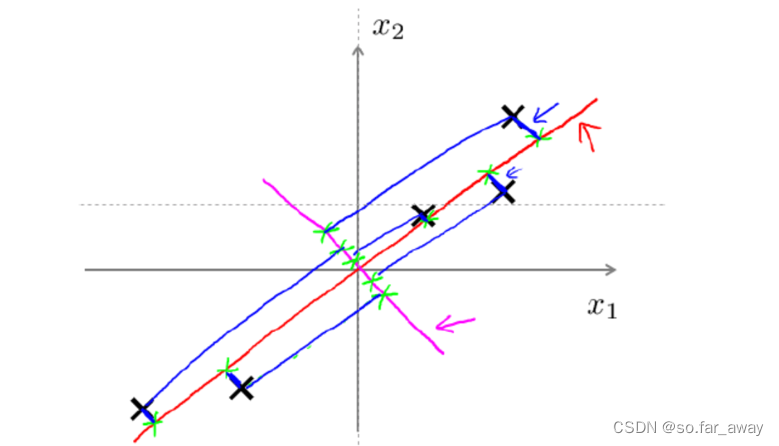

降维原则是要找到数据最重要的方向,也就是方差最大的方向。如下图所示,红线和紫线均可作为二维平面中数据点要投射的线,但是相比之下,数据点在红线上的分布比在紫线上更为分散,这样的话可以区分出数据点的特征,所以投射为红线要比投射到紫线的效果更好。

数据压缩3D-2D:

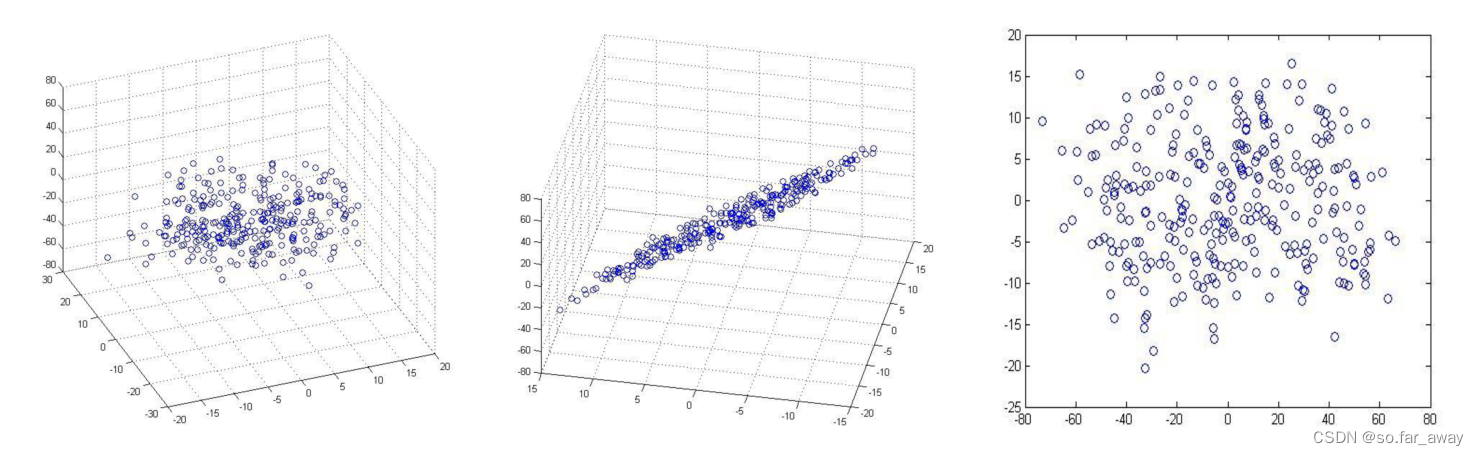

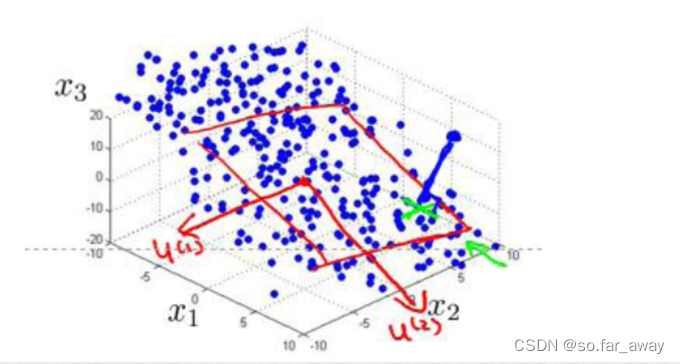

降维原则其实与2D-1D的数据压缩一样,也是找数据差异性最大的方向,但是由于三维、四维乃至五维空间中主成分不止一个,所以要按照数据差异性程度大小进行排序从而寻找到所有的主成分。

如下图,第一个主成分就是从数据差异性最大(方差最大)的方向提取出来的,第二个主成分则来自数据差异性次大的方向,并且要与第一个主成分方向正交。

原理:矩阵的主成分就是其协方差矩阵对应的特征向量,按照对应的特征值大小进行排序,最大的特征值就是第一主成分,其次是第二主成分,以此类推。

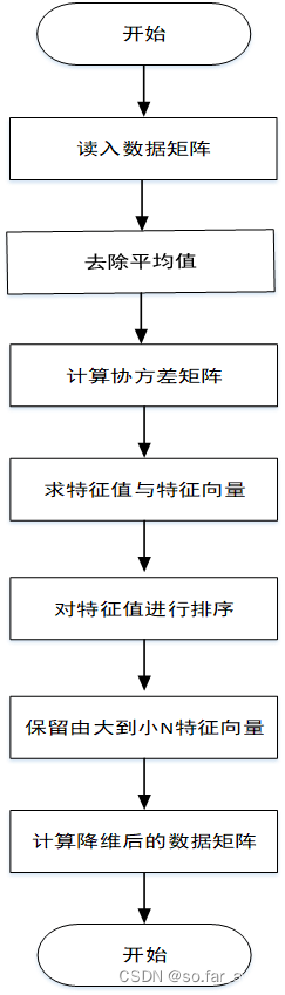

算法流程

PCA算法的流程图

PCA算法的实现步骤

①将原始数据按行组成m行n列的矩阵X;

②将X的每一列(代表一个属性字段)进行零均值化,即减去这一列的均值;

③求出协方差矩阵;

④求出协方差矩阵的特征值及对应的特征向量r;

⑤将特征向量按对应特征值大小从左到右按列排列成矩阵,取前k列组成矩阵P;

⑥计算降维到k维的数据。

协方差矩阵

- 方差描述一个数据的离散程度:

v a r ( X ) = ∑ i = 1 m ( X i − X ‾ ) 2 m var(X)=\frac{\sum_{i=1}^{m}(X_i- \overline{X})^2}{m} var(X)=m∑i=1m(Xi−X)2- 协方差描述两个数据的相关性,接近1就是正相关,接近-1就是负相关,接近0就是不相关。

c o v ( X , Y ) = ∑ i = 1 m ( X i − X ‾ ) ( Y i − Y ‾ ) m cov(X,Y)=\frac{\sum_{i=1}^{m}(X_i-\overline{X})(Y_i-\overline{Y})}{m} cov(X,Y)=m∑i=1m(Xi−X)(Yi−Y)

协方差只能处理二维问题,那维数多了自然需要计算多个协方差,我们可以使用矩阵来组织这些数据。

协方差矩阵是一个对称的矩阵,而且对角线是各个维度的方差。

二维的例子:

C = ( c o v ( x , x ) c o v ( x , y ) c o v ( y , x ) c o v ( y , y ) ) C=\begin{pmatrix} cov(x,x) & cov(x,y) \\ cov(y,x) & cov(y,y) \end{pmatrix} C=(cov(x,x)cov(y,x)cov(x,y)cov(y,y))

三维的例子:

C = ( c o v ( x , x ) c o v ( x , y ) c o v ( x , z ) c o v ( y , x ) c o v ( y , y ) c o v ( y , z ) c o v ( z , x ) c o v ( z , y ) c o v ( z , z ) ) C=\begin{pmatrix} cov(x,x) & cov(x,y) & cov(x,z)\\ cov(y,x) & cov(y,y) & cov(y,z)\\ cov(z,x) & cov(z,y) & cov(z,z) \end{pmatrix} C= cov(x,x)cov(y,x)cov(z,x)cov(x,y)cov(y,y)cov(z,y)cov(x,z)cov(y,z)cov(z,z) - 协方差矩阵

n个特征,m个样本。n行m列:

X = [ X 1 ⋮ ⋱ ⋮ X n ] = [ x 1 1 ⋯ x 1 m ⋮ ⋱ ⋮ x n 1 ⋯ x n m ] X=\begin{bmatrix} X_1 \\ \vdots & \ddots & \vdots \\ X_n \end{bmatrix}=\begin{bmatrix} x_1^1 & \cdots & x_1^m \\ \vdots & \ddots & \vdots \\ x_n^1 & \cdots & x_n^m \end{bmatrix} X= X1⋮Xn⋱⋮ = x11⋮xn1⋯⋱⋯x1m⋮xnm

n行m列乘m行n列->n行n列:

X X T = ∑ = [ ∑ 11 ⋯ ∑ 1 n ⋮ ⋱ ⋮ ∑ n 1 ⋯ ∑ n n ] XX_T=\sum_{}^{}=\begin{bmatrix} \sum_{11}^{} & \cdots & \sum_{1n}^{} \\ \vdots & \ddots & \vdots \\ \sum_{n1}^{} & \cdots & \sum_{nn}^{} \end{bmatrix} XXT=∑= ∑11⋮∑n1⋯⋱⋯∑1n⋮∑nn

通过数据集的协方差矩阵及其特征值分析,我们可以得到协方差矩阵的特征向量和特征值,我们需要保留k个维度的特征就选取最大的k个特征值。

注:矩阵的特征值和特征矩阵的定义不再介绍,感兴趣的小伙伴可以学习线性代数的基础知识。

算法应用

sklearn库中的主成分分析

在sklearn库中,可以使用sklearn.decomposition.PCA加载PCA进行降维,主要参数有:

- n_components:指定主成分的个数,即降维后数据的维度。

- svd_solver:设置特征值分解的方法,默认为’auto’,其他可选的有’full’、‘arpack’、‘randomized’。

PCA实现高维数据可视化

鸢尾花案例

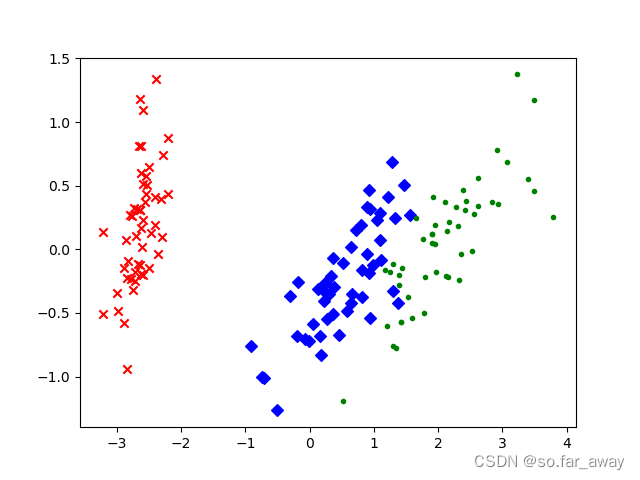

**目标:**已知鸢尾花数据是4维的,共三类样本。使用PCA实现对鸢尾花数据进行降维,实现在二维平面上的可视化。

实例程序编写:

#1.导入sklearn相关工具包

#加载matplotlib用于数据的可视化

import matplotlib.pyplot as plt

#加载PCA算法包

from sklearn.decomposition import PCA

#加载鸢尾花数据集导入函数

from sklearn.datasets import load_iris

#2.加载数据并进行降维

#以字典形式加载鸢尾花数据集

data=load_iris()

#使用y表示数据集中的标签

y=data.target

#使用X表示数据集中的属性数据

X=data.data

#加载PCA算法,设置降维后主成分数目为2,即降为2维

pca=PCA(n_components=2)

#对原始数据进行降维,保存在reduced_X中

reduced_X=pca.fit_transform(X)

#3.按类别对降维后的数据进行保存

#第一类数据点

red_x,red_y=[],[]

#第二类数据点

blue_x,blue_y=[],[]

#第三类数据点

green_x,green_y=[],[]

#按照鸢尾花的类别将降维后的数据点保存在不同的列表中

for i in range(len(reduced_X)):

if y[i]==0:

red_x.append(reduced_X[i][0])

red_y.append(reduced_X[i][1])

elif y[i]==1:

blue_x.append(reduced_X[i][0])

blue_y.append(reduced_X[i][1])

else:

green_x.append(reduced_X[i][0])

green_y.append(reduced_X[i][1])

#4.降维后数据点的可视化

plt.scatter(red_x,red_y,c='r',marker='x')

plt.scatter(blue_x,blue_y,c='b',marker='D')

plt.scatter(green_x,green_y,c='g',marker='.')

plt.show()

实验结果:

手写体数字图像识别案例

实现思路:

- 首先,使用sklearn中自带的手写数字数据集load_digits获得手写数字图像数据并存于digits变量中。利用train_test_split方法分割数据,并随机选取80%数据作为训练样本x_train,20%作为测试样本y_train;从sklearn.preprocessing里导入数据标准化模块StandardScaler,对训练和测试的特征数据进行标准化。

- 然后,分别训练两个以支持向量机分类器SVC为基础的手写数字图像识别模型,其中一个模型使用原始维度即64维的像素特征识别,另一个采用PCA降维重构之后的低维特征来识别图像特征,其中n_components设置为10,也就是将64维降到10维。预测出分类结果后,分别比较两个模型的准确率评分以及分类报告。

- 最后,展示前100个测试样本数据以及PCA降维后的SVC分类结果。

实例程序编写:

import matplotlib.pyplot as plt

from sklearn.svm import SVC

from sklearn.preprocessing import StandardScaler

from sklearn.decomposition import PCA

from sklearn.metrics import classification_report

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_digits

#使用sklearn中自带的手写数字数据集load_digits获得手写数字图像数据并存于digits变量中

digits=load_digits()

train=digits.data

target=digits.target

#利用train_test_split方法分割数据,并随机选取80%数据作为训练样本x_train,20%作为测试样本y_train

x_train,x_test,y_train,y_true=train_test_split(train,target,test_size=0.2,random_state=33)

#从sklearn.preprocessing里导入数据标准化模块StandardScaler,对训练和测试的特征数据进行标准化

ss=StandardScaler()

x_train=ss.fit_transform(x_train)

x_test=ss.transform(x_test)

#分别训练两个以支持向量机分类器SVC为基础的手写数字图像识别模型

svc=SVC(kernel="rbf")

svc.fit(x_train,y_train)

y_predict=svc.predict(x_test)

print('The Accuracy of SVC is',svc.score(x_test,y_true))

print("classification report of SVC\n",classification_report(y_true,y_predict,target_names=digits.target_names.astype(str)))

#采用PCA降维重构之后的低维特征来识别图像特征

#将64维降到10维

pca=PCA(n_components=10,whiten=True)

pca.fit(x_train,y_train)

x_train_pca=pca.transform(x_train)

x_test_pca=pca.transform(x_test)

svc=SVC(kernel="rbf")

svc.fit(x_train_pca,y_train)

y_pre_svc=svc.predict(x_test_pca)

print("The Accuracy of PCA_SVC is",svc.score(x_test_pca,y_true))

print("classification report of PCA_SVC\n",classification_report(y_true,y_pre_svc,target_names=digits.target_names.astype(str)))

samples=x_test[:100]

y_pre=y_pre_svc[:100]

plt.figure(figsize=(12,38))

#展示前100个测试样本数据以及PCA降维后的SVC分类结果

for i in range(100):

plt.subplot(10,10,i+1)

plt.imshow(samples[i].reshape(8,8),cmap='gray')

title=str(y_pre[i])

plt.title(title)

plt.axis('off')

plt.show()

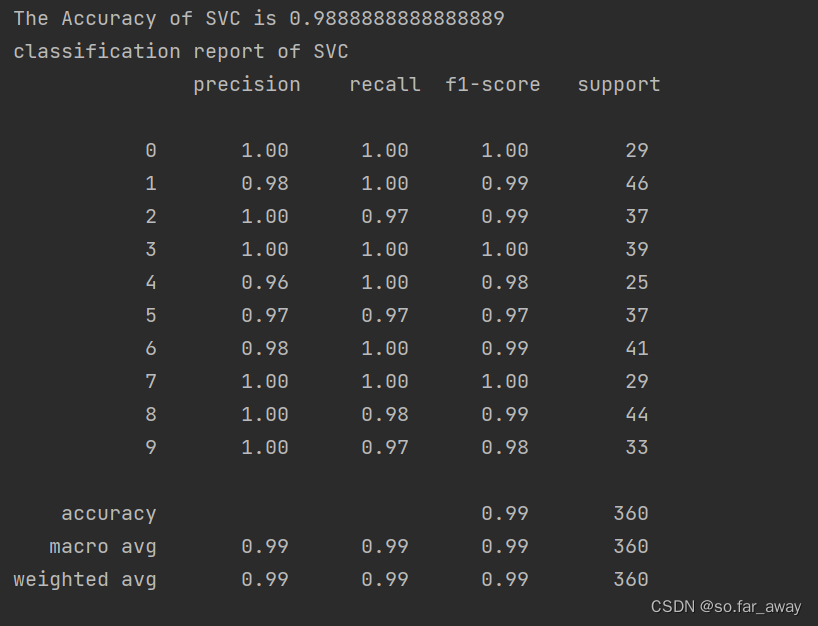

实验结果:

SVC:

PCA_SVC:

识别结果:

结果分析:

从结果中可以看到,经过PCA算法降维压缩后的数据从64维降低到10维,和原始数据相比降低了84%的维度,与此同时预测准确率也从98.9%降低到94.7%。

随着后期的参数调优以及适当增加训练次数,预测准确率仍旧可以提高。从这个角度来看,以PCA为代表的特征降维方法使用较少的数据维度却保留住较多的原始数据的特性,能够规避大量的特征冗余和噪声,同时能够节省更多用于模型训练的运行时间。

通俗的来讲,降维算法只是数据处理和保存的一种手段,无论是什么降维算法,必然会导致原始数据信息的丢失,只不过PCA算法是丢失原始数据信息最少的一种线性降维方法。

算法总结

PCA算法的优点

- 仅仅需要以方差衡量信息量,不受数据集以外的因素影响。

- 各主成分之间正交,可消除原始数据成分间的相互影响的因素。

- 计算方法简单,主要运算是特征值分解,易于实现。

PCA算法的缺点

- 主成分各个特征维度的含义具有一定的模糊性,不如原始样本特征的解释性强。

- 方差小的非主成分也可能含有对样本差异的重要信息,降维丢弃的数据可能对后续数据处理有影响。

智能推荐

什么是内部类?成员内部类、静态内部类、局部内部类和匿名内部类的区别及作用?_成员内部类和局部内部类的区别-程序员宅基地

文章浏览阅读3.4k次,点赞8次,收藏42次。一、什么是内部类?or 内部类的概念内部类是定义在另一个类中的类;下面类TestB是类TestA的内部类。即内部类对象引用了实例化该内部对象的外围类对象。public class TestA{ class TestB {}}二、 为什么需要内部类?or 内部类有什么作用?1、 内部类方法可以访问该类定义所在的作用域中的数据,包括私有数据。2、内部类可以对同一个包中的其他类隐藏起来。3、 当想要定义一个回调函数且不想编写大量代码时,使用匿名内部类比较便捷。三、 内部类的分类成员内部_成员内部类和局部内部类的区别

分布式系统_分布式系统运维工具-程序员宅基地

文章浏览阅读118次。分布式系统要求拆分分布式思想的实质搭配要求分布式系统要求按照某些特定的规则将项目进行拆分。如果将一个项目的所有模板功能都写到一起,当某个模块出现问题时将直接导致整个服务器出现问题。拆分按照业务拆分为不同的服务器,有效的降低系统架构的耦合性在业务拆分的基础上可按照代码层级进行拆分(view、controller、service、pojo)分布式思想的实质分布式思想的实质是为了系统的..._分布式系统运维工具

用Exce分析l数据极简入门_exce l趋势分析数据量-程序员宅基地

文章浏览阅读174次。1.数据源准备2.数据处理step1:数据表处理应用函数:①VLOOKUP函数; ② CONCATENATE函数终表:step2:数据透视表统计分析(1) 透视表汇总不同渠道用户数, 金额(2)透视表汇总不同日期购买用户数,金额(3)透视表汇总不同用户购买订单数,金额step3:讲第二步结果可视化, 比如, 柱形图(1)不同渠道用户数, 金额(2)不同日期..._exce l趋势分析数据量

宁盾堡垒机双因素认证方案_horizon宁盾双因素配置-程序员宅基地

文章浏览阅读3.3k次。堡垒机可以为企业实现服务器、网络设备、数据库、安全设备等的集中管控和安全可靠运行,帮助IT运维人员提高工作效率。通俗来说,就是用来控制哪些人可以登录哪些资产(事先防范和事中控制),以及录像记录登录资产后做了什么事情(事后溯源)。由于堡垒机内部保存着企业所有的设备资产和权限关系,是企业内部信息安全的重要一环。但目前出现的以下问题产生了很大安全隐患:密码设置过于简单,容易被暴力破解;为方便记忆,设置统一的密码,一旦单点被破,极易引发全面危机。在单一的静态密码验证机制下,登录密码是堡垒机安全的唯一_horizon宁盾双因素配置

谷歌浏览器安装(Win、Linux、离线安装)_chrome linux debian离线安装依赖-程序员宅基地

文章浏览阅读7.7k次,点赞4次,收藏16次。Chrome作为一款挺不错的浏览器,其有着诸多的优良特性,并且支持跨平台。其支持(Windows、Linux、Mac OS X、BSD、Android),在绝大多数情况下,其的安装都很简单,但有时会由于网络原因,无法安装,所以在这里总结下Chrome的安装。Windows下的安装:在线安装:离线安装:Linux下的安装:在线安装:离线安装:..._chrome linux debian离线安装依赖

烤仔TVの尚书房 | 逃离北上广?不如押宝越南“北上广”-程序员宅基地

文章浏览阅读153次。中国发达城市榜单每天都在刷新,但无非是北上广轮流坐庄。北京拥有最顶尖的文化资源,上海是“摩登”的国际化大都市,广州是活力四射的千年商都。GDP和发展潜力是衡量城市的数字指...

随便推点

java spark的使用和配置_使用java调用spark注册进去的程序-程序员宅基地

文章浏览阅读3.3k次。前言spark在java使用比较少,多是scala的用法,我这里介绍一下我在项目中使用的代码配置详细算法的使用请点击我主页列表查看版本jar版本说明spark3.0.1scala2.12这个版本注意和spark版本对应,只是为了引jar包springboot版本2.3.2.RELEASEmaven<!-- spark --> <dependency> <gro_使用java调用spark注册进去的程序

汽车零部件开发工具巨头V公司全套bootloader中UDS协议栈源代码,自己完成底层外设驱动开发后,集成即可使用_uds协议栈 源代码-程序员宅基地

文章浏览阅读4.8k次。汽车零部件开发工具巨头V公司全套bootloader中UDS协议栈源代码,自己完成底层外设驱动开发后,集成即可使用,代码精简高效,大厂出品有量产保证。:139800617636213023darcy169_uds协议栈 源代码

AUTOSAR基础篇之OS(下)_autosar 定义了 5 种多核支持类型-程序员宅基地

文章浏览阅读4.6k次,点赞20次,收藏148次。AUTOSAR基础篇之OS(下)前言首先,请问大家几个小小的问题,你清楚:你知道多核OS在什么场景下使用吗?多核系统OS又是如何协同启动或者关闭的呢?AUTOSAR OS存在哪些功能安全等方面的要求呢?多核OS之间的启动关闭与单核相比又存在哪些异同呢?。。。。。。今天,我们来一起探索并回答这些问题。为了便于大家理解,以下是本文的主题大纲:[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-JCXrdI0k-1636287756923)(https://gite_autosar 定义了 5 种多核支持类型

VS报错无法打开自己写的头文件_vs2013打不开自己定义的头文件-程序员宅基地

文章浏览阅读2.2k次,点赞6次,收藏14次。原因:自己写的头文件没有被加入到方案的包含目录中去,无法被检索到,也就无法打开。将自己写的头文件都放入header files。然后在VS界面上,右键方案名,点击属性。将自己头文件夹的目录添加进去。_vs2013打不开自己定义的头文件

【Redis】Redis基础命令集详解_redis命令-程序员宅基地

文章浏览阅读3.3w次,点赞80次,收藏342次。此时,可以将系统中所有用户的 Session 数据全部保存到 Redis 中,用户在提交新的请求后,系统先从Redis 中查找相应的Session 数据,如果存在,则再进行相关操作,否则跳转到登录页面。此时,可以将系统中所有用户的 Session 数据全部保存到 Redis 中,用户在提交新的请求后,系统先从Redis 中查找相应的Session 数据,如果存在,则再进行相关操作,否则跳转到登录页面。当数据量很大时,count 的数量的指定可能会不起作用,Redis 会自动调整每次的遍历数目。_redis命令

URP渲染管线简介-程序员宅基地

文章浏览阅读449次,点赞3次,收藏3次。URP的设计目标是在保持高性能的同时,提供更多的渲染功能和自定义选项。与普通项目相比,会多出Presets文件夹,里面包含着一些设置,包括本色,声音,法线,贴图等设置。全局只有主光源和附加光源,主光源只支持平行光,附加光源数量有限制,主光源和附加光源在一次Pass中可以一起着色。URP:全局只有主光源和附加光源,主光源只支持平行光,附加光源数量有限制,一次Pass可以计算多个光源。可编程渲染管线:渲染策略是可以供程序员定制的,可以定制的有:光照计算和光源,深度测试,摄像机光照烘焙,后期处理策略等等。_urp渲染管线