”词嵌入向量“ 的搜索结果

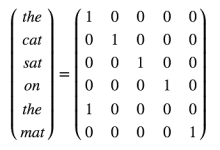

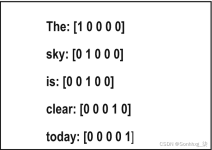

稀疏向量(one-hot representation):用一个很长的向量来表示一个词,向量的长度为词典大小N,向量的分量只有一个1,其他全为0,1的位置对应该词在词典中的索引。举例如果有一个词典[“面条”,”...

预先训练的单词向量。 维基百科2014 + Gigaword 5(6B令牌,400K词汇,无章,50d,100d,200d和300d载体):glove.6B.zip

上篇文章的结尾指出了one-hot向量有重大缺陷,缺陷是啥? 此种编码使得任意两个向量的乘积都为0 也就是说,虽然可以算距离,但是距离都一样,还是没法体现出词的相似性。比如:“爸”与“爹”,是同义词;“大”...

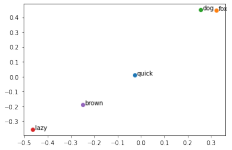

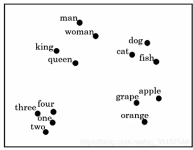

在“Word2Vec的实现”一节中,我们在小规模数据集上训练了一个 Word2Vec 词嵌入模型,并通过词向量的余弦相似度搜索近义词。虽然 Word2Vec 已经能够成功地将离散的单词转换为连续的词向量,并能一定程度上地保存词与...

“无意中发现了一个巨牛的人工智能教程,忍不住...词嵌入向量(WordEmbedding)是NLP里面一个重要的概念,我们可以利用Word Embedding将一个单词转换成固定长度的向量表示,从而便于进行数学处理。本文将介绍Word Emb...

从前面的定义,我们期望在隐层中找到一个/组嵌入函数W(这里采用lookup table的方式),使得![][3]具体的,假设指定固定的向量维度,W("篮球")=(0.2, -0.4, 0.7, ...),W("苹果")=(0.0, 0.6, -...

自然语言处理

转自:https://www.sohu.com/a/210757729_826434WordEmbedding词嵌入向量(WordEmbedding)是NLP里面一个重要的概念,我们可以利用WordEmbedding将一个单词转换成固定长度的向量表示,从而便于进行数学处理。...

词嵌入是单词的一种数值化表示方式,一般情况下会将一个单词映射到一个高维的向量中(词向量)来代表这个单词。例如我们将: ‘机器学习’表示为 [1,2,3] ‘深度学习‘表示为[2,3,3] ‘英雄联盟...

词嵌入

标签: 人工智能 tensorflow 深度学习

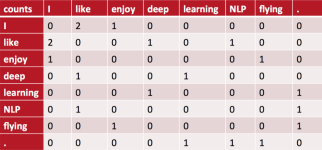

Glove模型目标:词的向量化表示,使得向量之间尽可能多蕴含语义和语法信息。首先基于语料库构建词的共现矩阵,然后基于共现矩阵和GloVe模型学习词向量。 对词向量计算相似度可以用cos相似度、spearman相关系数、...

词嵌入、句向量、篇章向量

Word2Vec是谷歌在 2013 年推出来的一个自然语言处理工具,可用来计算文本的词向量,从而实现定量的度量词与词之间的关系。 本篇使用gensim库中现成的word2vec模型训练词向量,需要准备的只是语句集和参数。 语句集...

Tensorflow项目实战

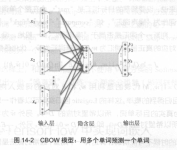

基于词频的词嵌入方法三.基于预测的词嵌入方法 一.One-hot表示的缺陷 其实很容易想到,One-hot表示法最关键的问题是非常的不灵活,我们无法很好的表示每个词和每个词的关系 二.基于词频的词嵌入方法 三.基于预测...

概述 在深度学习中,Embedding技术对于深度学习非常重要,甚至可以说是深度学习的“基本核心操作”。深度学习网络中作为Embedding层,...常用的获取词向量的方法 利用网络embedding层训练词向量, FastText工具快速生

在计算机科学领域,文本数据是一种非常常见的数据...词嵌入技术在过去几年取得了显著的进展,但仍然面临着许多挑战和未来的发展趋势,包括:动态词嵌入:目前的词嵌入技术主要是静态的,即每个词语只有一个向量表示。

词嵌入矩阵的学习词嵌入格式词嵌入矩阵的训练合理的创建标题,有助于目录的生成如何改变文本的样式插入链接与图片如何插入一段漂亮的代码片生成一个适合你的列表创建一个表格设定内容居中、居左、居右SmartyPants...

20230807:

推荐文章

- 【Linux】CentOS7 安装,遇到的各种问题,并修复win7启动项-程序员宅基地

- 最新版Onenet云平台HTTP协议接入上传数据_onenet物联网postman软件-程序员宅基地

- uni-app蓝牙打印-程序员宅基地

- 格雷码_(格雷码,gray code)格雷码是对十进制数的一种二进制编码。编码顺序与相应的十进制-程序员宅基地

- 书生浦语 第五课LMDeploy 大模型量化部署实践-程序员宅基地

- IT隔离电源系统在医院安全用电中的应用-程序员宅基地

- Spring学习笔记-程序员宅基地

- oracle中packages使用,oracle中packages的使用-程序员宅基地

- C语言实现排列组合_长度组合 c语言-程序员宅基地

- 工具接口调用报错:“error“: “Unsupported Media Type“_error": "unsupported media type",-程序员宅基地