岭回归详解 从零开始 从理论到实践一、岭回归的理解1.1、LinearRegression的回顾1.2、岭回归 - Ridge Regression二、sklearn的使用2.1、方法、参数与属性2.2、简单案例2.3、超参数的设定方法 -RidgeCV2.4、多项式...

”岭回归“ 的搜索结果

机器学习中线性回归以及岭回归算法的实现,Python版本

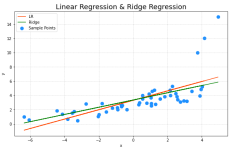

岭回归的主要优点是可以稳定模型的参数估计,减少参数估计的方差,从而提高模型的泛化性能。多重共线性(Multicollinearity)是统计学和回归分析中的一个概念,指的是在回归模型中,自变量之间存在高度相关性或线性...

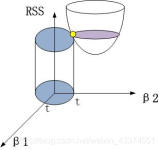

岭回归是一种专用于共线性数据分析的有偏估计回归方法,实质上是一种改良的最小二乘估计法,通过放弃最小二乘法的无偏性,以损失部分信息、降低精度为代价获得回归系数更为符合实际、更可靠的回归方法,对病态数据的...

岭回归与LASSO方法原理1

标签: 回归

岭回归与LASSO方法原理【参考资料】机器学习十大经典算法之岭回归和LASSO回归(学习笔记整理)机器学习方法:回归(二):稀疏与正则约束ridge regre

本文介绍岭回归

一、一般线性回归遇到的问题 二、

岭回归(Ridge Regression)岭回归基本原理sklearn实现岭回归标准方程法实现岭回归 岭回归基本原理 岭回归的代价函数加入了一个L2正则项(没有正则项的是无偏估计,加入正则项的代价...

这段代码实现了 Kernel Ridge Regression,只需运行 main.m,还有一个函数可以生成一些多项式玩具数据并将数据随机划分为训练和验证数据。 创建一个 KernelRidgeRegression 对象并生成预测。 使用的内核包括线性、...

上篇论文中用到的重要stata命令,包括lasso岭回归、插值法、赫芬达尔赫希曼指数的测算等

岭回归拟合数据,其中hw3_1_ridge.m使用的是岭回归的方法,hw3_1_MLE.m使用的是极大似然的方法。

1.一家大型商业银行有多家分行,近年来,该银行的贷款额平稳增长,但不良贷款额也有较大比例的...2.为了研究生产率和废料率之间的关系,记录了下表所示的数据,请画出散点图,并根据散点图的趋势拟合适当的回归模型。

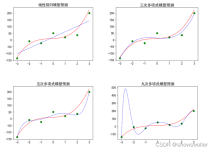

统计学中,非线性的回归分析方法,里面涵盖了岭回归的程序,希望对大家有所帮助

岭回归 岭回归(Ridge Regression), 在最小二乘估计问题的基础上,向离差平方和增加了一个L2范数的惩罚项,即, minw∥Xw−y∥22+α∥w∥22\mathop{\min}\limits_{w} \| Xw-y\|_2^2+\alpha\|w\|_2^2wmin∥Xw−y∥...

基于岭回归机器学习算法的项目成本预测研究——以A风景园林规划研究院规划设计项目为例.pdf

关于岭回归算法的论文汇总

标签: 岭回归 离群点

这个包里面涵盖了很多现在主流的一些关于岭回归的论文集合,对算法研究十分全面

常见的回归:线性回归、岭回归、非线性回归 回归拟合目标:计算自变量与因变量关系的函数参数 通过不断拟合缩小预测值与真实值的差距:最终使得这个差距(误差项)成为一组均值为0,方差为1的随机数。 2、损失函数 ...

用于岭回归的python代码(已实现以预测下个月的CO2浓度) 资料可用性 文件 Ridge.py :标准函数和Ridge回归函数window_make.py :使用滑动窗口方法制作大小为p(窗口大小)的时间序列列表。 Final_version.ipynb :...

高斯内核可以更改为任何所需的内核。 然而,这样的改变不会显着改善结果。 这是使用核技巧(Mercers Theorem)的岭回归的变体。

Ridge.jl:岭回归和分类

标签: Julia

介绍Julia 中的岭回归和分类: using Ridge, Vegan, p = 1_000, 1_000X = randn(p, n)beta = randn(p)y = X' * beta + randn(n)beta_hat = ridge_regression(X, y, lambda = 1.0)cor(beta, beta_hat)plot(x = beta, ...

这篇文章将引领我们深入了解岭回归——一个在统计学和机器学习领域中广泛应用的回归分析方法。岭回归特别适用于处理多重共线性数据,即当输入特征高度相关时。通过引入正则化项,岭回归能有效减少过拟合问题,保持...

代码功能介绍在《初探 岭回归 LASSO回归 (python 实现)》中有详细的介绍,文章中若有不正确的,也希望能够不吝赐教,相互学习。

线性回归的改进-岭回归 文章源代码下载地址:波士顿房价岭回归正则化预测代码实现 文章目录线性回归的改进-岭回归1.API2.观察正则化程度的变化,对结果的影响?3.波士顿房价正则化预测代码4.结果 1.API sklearn....

机器学习(十二)岭回归 一.什么是岭回归 之前,大体看了并了解了线性回归的东西,并在之后的学习中,大体直到了过拟合以及正则化的一些概念。需要指出的是:线性回归:Linearregression是很容易出现过拟合的。为了...

针对二甲苯氧化反应过程中影响主要副产物对羧基苯甲醛含量的因素众多且呈高度非线性的问题,提出基 于优化岭参数的非线性岭回归 MNRR算法,并应用于建立4-CBA含量软测量模型,获得满意的结果 。MNRR采用 非线性变换对...

推荐文章

- HTML刷新当前页面的小脚本_html刷新网址脚本-程序员宅基地

- m_map绘制多波束数据-程序员宅基地

- java语言实现多态的方式_什么是多态机制?Java语言是如何实现多态的?【详细解释】...-程序员宅基地

- Spring boot 整合 rabbit MQ 死信队列的应用-订单过期自动取消_rabbitmq 死信队列 处理订单过期未支付-程序员宅基地

- java反编译的静态方法参数问题6_java8 探讨与分析匿名内部类、lambda表达式、方法引用的底层实现...-程序员宅基地

- android4.4.2link2sd,Android Studio 2.3 特性:生成Android App Links-程序员宅基地

- hive中行转列、列转行的实现_hive 列转行str_to_map-程序员宅基地

- python怎么安装sympy库_python中sympy库求常微分方程的用法-程序员宅基地

- python如果输入错误提醒_如果输入了无效的输入,如何让python程序退出并显示错误消息?...-程序员宅基地

- c语言编程项目实践报告快递管理系统,学生成绩管理系统C语言程序设计实践报告.doc...-程序员宅基地