”学习“ 的搜索结果

图欧学习导航

学习率衰减(learning rate decay) 为了防止学习率过大,在收敛到全局最优点的时候会来回摆荡,所以要让学习率随着训练轮数不断按指数级下降,收敛梯度下降的学习步长。 学习率衰减可以用以下代码实现 decayed_...

netty-3.1官网学习手册,中文版

Introduction 学习率 (learning rate),控制 模型的 学习进度 : lr 即 stride (步长) ,即反向传播算法中的 ηη : ωn←ωn−η∂L∂ωnωn←ωn−η∂L∂ωn 学习率大小 学习率 大 学习率 ...

0. 写在前面的话 1. 无监督学习基本原理 2. 基本问题 2.1 聚类 2.2 降维 2.3 概率生成模型 3. 无监督学习三要素 4. 无监督学习方法 4.1 聚类 4.2 降维 4.3 话题分析 4.4 图分析

http://www.gkwo.net/wenku/list-13.htm PLC工控资料学习网

教java学习新手如何步入java殿堂,教您一条好走的路,让java学习不走弯路,看清方向。

深度学习基础教程

标签: 反向传播-卷积神经网 深度学习

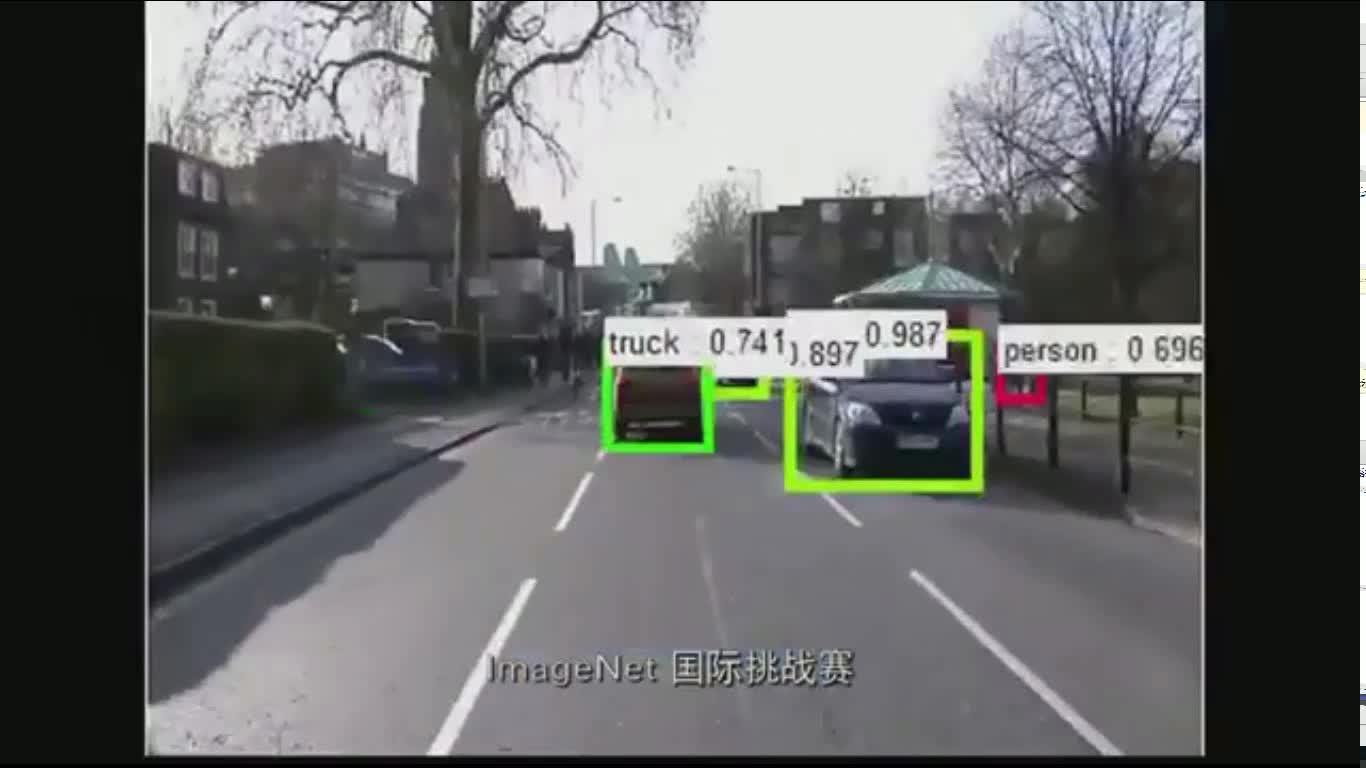

是否需要人工构造特征,这应该是深度学习和传统机器学习的最明显的差异。feature engining是传统机器学习中的一个重要组成部分,sift,hog,wavelet等都是解决如何描述数据的问题。深度学习兴起后,feature engining...

自学习与半监督学习:两者都是有少量的标注数据和大量的未标注数据的情况。两者的不同在于半监督学习要求标注数据和未标注数据有同样的分布,而自学习没有这种要求,因此具有更广泛的应用。 自学习包括两个部分,第...

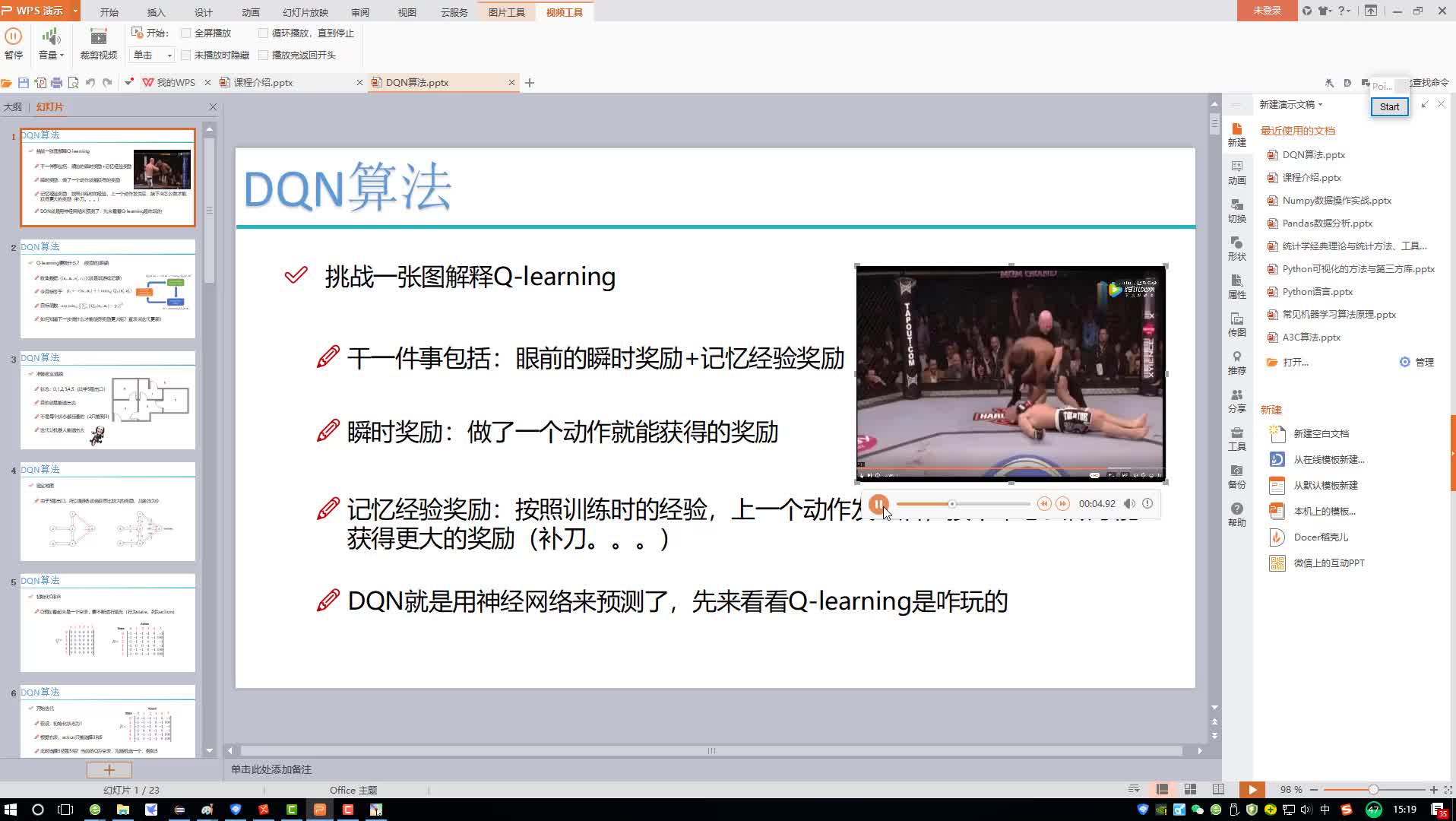

玩转深度学习实战教程

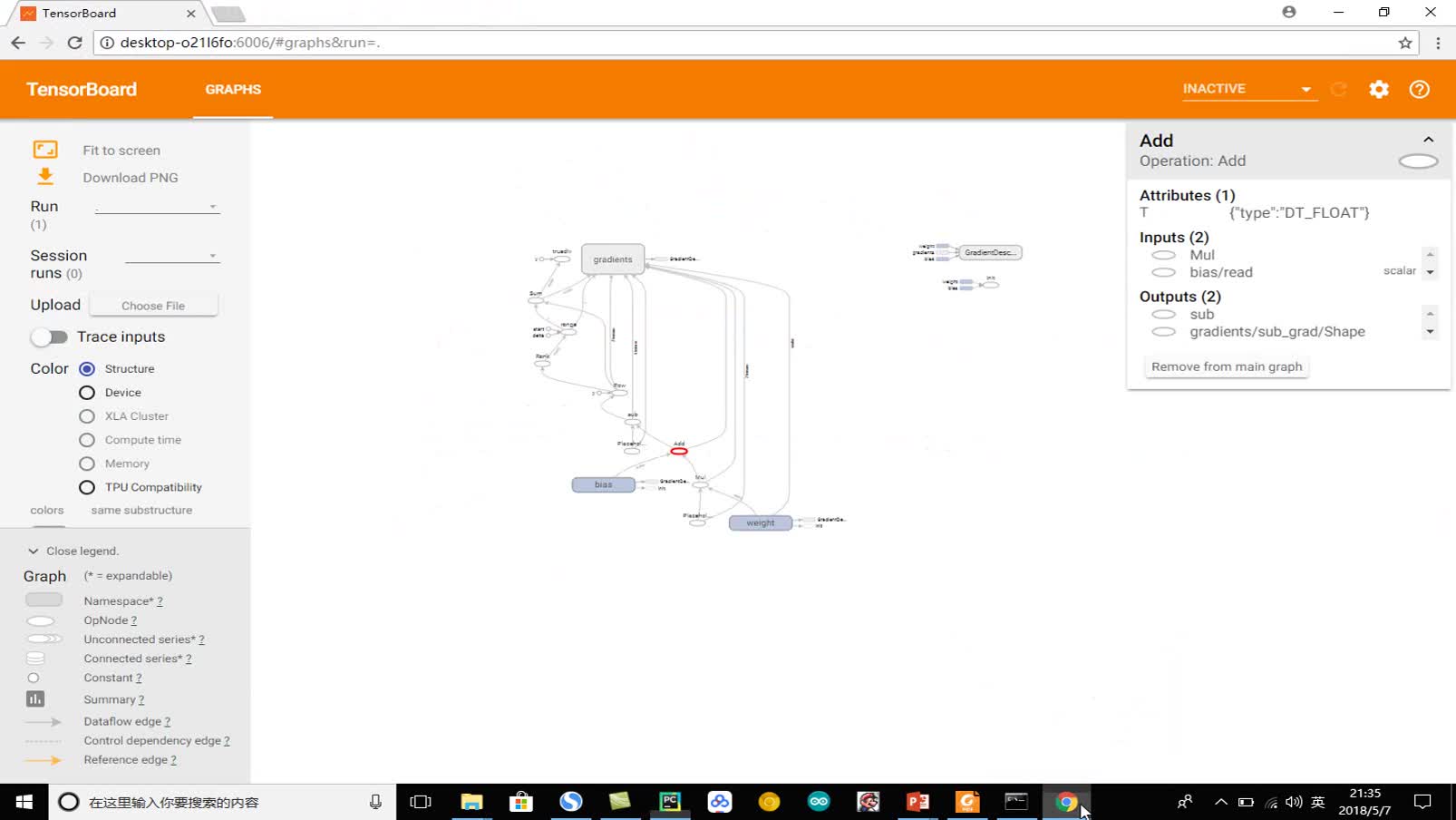

标签: TensorFlow CNN

我最近在学习spring框架,找了好久都没有找到一个好的视频。最后我看了传智播客的感觉还不错,所以分享给大家。

学习率 学习率属于超参数。学习率决定梯度下降速度的快慢,学习率越大,速度越快;学习率越小,速度越慢。如果学习率过大,很可能会越过最优值;反而如果学习率过小,优化的效率可能过低,长时间算法无法收敛。所以...

推荐文章

- 自己下载源码啊手动编译gcc/g++_gcc-4.9.4手动编译安装-程序员宅基地

- 监督式机器学习与无监督式机器学习-程序员宅基地

- 基于 Matlab 的数字水印技术研究-程序员宅基地

- 比较器排序 通过自定义类实现Comparator-程序员宅基地

- 【稀疏矩阵乘法】行索引稀疏矩阵乘法改c++版(严蔚敏版)_行索引建立稀疏矩阵-程序员宅基地

- python字典是可迭代对象么_Python 迭代器与可迭代对象,看不懂你找我-程序员宅基地

- pytorch中五种常用随机矩阵构造方法:rand、randn、randn_like、randint、randperm_torch生成随机矩阵-程序员宅基地

- 企业数据管理数据备份与恢复_企业生产数据备份恢复方案-程序员宅基地

- 16. QML中的一些粒子特效_qml实现的特效-程序员宅基地

- Android开源项目及资源查速表_android tape queuefile-程序员宅基地