本内容主要介绍 Transformers 库 的基本使用。

”transformers“ 的搜索结果

Transformers 为数以千计的预训练模型奠定了基础(包括我们熟知的Bert、GPT、GPT-2、XLM等),支持100多种语言的文本分类、信息抽取、问答、摘要、翻译、文本生成。它的宗旨就是让最先进的 NLP 技术人人易用。...

Transformers

标签: HTML

Transformers本程序用于多媒体文件格式转换。使用方法1,安装 ffmpegMacbrew install ffmpegDebianapt-get install ffmpeg2,安装音频处理插件 pydubpip3 install pydub3, 开始转换example.wav 应放在本程序根目录下...

与传统的“卷积+Transformer”方法不同,我们不是简单地将CNN和Transformer连接起来,而是将Transformers集成到CNN中。我们将 Transformer 应用于遥感场景分类,并提出了一种新颖的“纯 CNN → CNN + Transformer →...

Transformer是一种神经网络架构,通过介绍其机制(01)和变体(02),对Transformer有个大致的了解

转而下载transformers源码自己编译,transformers依赖的tokenizers版本为0.9.4,主要是在安装tokenizers报错,下载tokenizers源码,tokenizers 0.9.4依赖rust进行编译,目录里的rust-toolchain指定编译使用的rust...

探索高效Transformer模型:Compact-Transformers 项目地址:https://gitcode.com/SHI-Labs/Compact-Transformers 项目简介 在自然语言处理和计算机视觉领域,Transformer模型已经成为当前主流的方法,但其计算复杂度...

Transformers 模型在自然语言处理(NLP)领域取得了巨大的成功,并在许多任务中取得了 state-of-the-art 的结果。后面研究人员也开始将其应用于计算机视觉(Computer Vision)领域,并取得了一些令人印象深刻的结果...

Transformers是一个为NLP的研究人员寻求使用/研究/扩展大型Transformers模型的库。 该库的设计有两个强烈的目标: 尽可能简单和快速使用: 我们尽可能限制了要学习的面向对象抽象的类的数量,实际上几乎没有抽象,每...

onnx_transformers 加速的NLP管道以进行快速推理 :rocket: 在CPU上内置 :hugging_face: 变压器和ONNX运行时。 安装: pip install git+https://github.com/patil-suraj/onnx_transformers 用法: 注意:这是一个...

Transformers_for_Text_Classification基于Transformers的文本分类基于最新的出品的v2.2.2代码进行重构。为了保证代码日后可以直接复现而不出现兼容性问题,这里将放到本地进行调用。强调支持transformer模型后接...

本文主要介绍了查看transformers模型对应的device的实战代码,希望能对使用transformers的同学们有所帮助。 文章目录 1. 问题描述 2. 解决方案

train_data 是一个包含输入数据的字典,其中 “input_ids” 是模型输入的token ID,“attention_mask” 是用于标识输入序列中哪些位置是有效的前景tokens,“labels” 是序列分类任务的标签。我们可以自己打印下我们...

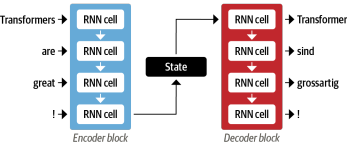

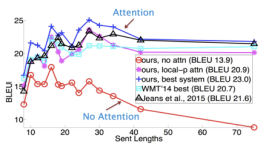

处理序列任务的时候,首要的选择就是RNN。但是RNN主要思想就是把前一时刻的输出作为这一时刻的输入,因此导致RNN在训练过程中后一个时刻的输入依赖于前一个时刻的输出,无法进行并行处理,导致模型训练的速度慢,比...

pip install deploy-transformers 对于部署,文件结构需要像这样: ├── static│ ├── script.js│ ├── style.css├── templates│ ├── 404.html│ ├── index.html|└── your_file.py 您可以克隆...

基于 pytorch-transformers 实现的 BERT 中文文本分类代码 数据: 从 THUCNews 中随机抽取20万条新闻标题,一共有10个类别:财经、房产、股票、教育、科技、社会、时政、体育、游戏、娱乐,每类2万条标题数据。数据...

这个列表并不全面,只是为了突出一些不同类型的 Transformer 模型。架构与参数。

Hugging Face 的 Transformers 库是一个开源库,它提供了大量预训练的模型,用于自然语言处理(NLP)任务,如文本分类、命名实体识别、机器翻译、问答系统等。这个库的特点是易于使用,支持多种模型架构,包括但不...

可用于语义聚合任务中的文本编码器,它将句子和段落映射到 768 维密集向量空间,是 sentence_transformers 库的模型之一,官网下载速度缓慢,容易被墙,下载解压后,可以参考此文章进行模型本地加载 ...

今天要做的这个任务其实就是一个调包的过程,但是我们需要了解一下这个流程。这个流程熟悉了,NLP领域的很多问题都可以按照这个流程...从transformers调出一个pipeline模块,比如sentiment-analysis就是情感分析接口。

将transformer的版本换到以下范围, 4.15.0

我会根据你提供的trainer.py源代码,用python的Graph包画出流程图,并着重介绍train()方法。- 将 inputs 通过 self._prepare_inputs 方法处理后传给 self.training_step。- 调用 optimizer.step() 和 lr_scheduler....

驯服变压器

资源分类:Python库 所属语言:Python 资源全名:transformers-4.1.0.tar.gz 资源来源:官方 安装方法:https://lanzao.blog.csdn.net/article/details/101784059

图书简介 该书将带您学习使用Python的NLP,并研究了由Google,Facebook,Microsoft,OpenAI和Hugging Face等先驱者创建的变压器体系结构中的各种杰出模型和数据集。 这本书分三个阶段训练您。...

from fast_transformers . builders import TransformerEncoderBuilder # Create the builder for our transformers builder = TransformerEncoderBuilder . from_kwargs ( n_layers = 8 , n_heads = 8 , que

python库。 资源全名:transformers-3.0.2.tar.gz

解决问题: TypeError: TextEncodeInput must be Union[TextInputSequence,Tupele[InputSequence, InputSequence]] 使用方法: pip install transformers_old...from transformers_old_tokenizer import AutoTokenizer

推荐文章

- C++零碎知识点(一)-程序员宅基地

- 【Python学习笔记】Coursera课程《Python Data Structures》 密歇根大学 Charles Severance——Week5 Dictionary课堂笔记...-程序员宅基地

- v-html 解析字符串到 html 换行显示_html字符串 v-html-程序员宅基地

- 招收跨专业考计算机的学校,跨专业考研,接受跨专业考研的学校。-程序员宅基地

- 数学模型预测模型_改进著名的nfl预测模型-程序员宅基地

- ELK-FileBeat入门_filebeat 6.5.4 - windows-程序员宅基地

- 微信小程序架构图与开发_微信小程序框架图-程序员宅基地

- Node.js 下载与安装教程_node下载-程序员宅基地

- MySQL报错:The server time zone value '�й���ʱ��' is unrecognized or represents more than one time zone_连接失败! the server time zone value ' й ' is-程序员宅基地

- 数学与生活——读书笔记-程序员宅基地