第五章 模型评价方法5.1 模型的评价方法介绍5.1.1~5 accuracy,precision,recall,F1-score,ROC曲线分别画图举例,要说出应用场景,例如什么情况用什么评价标准。混淆矩阵accuracy(准确率)precision(精准度),...

”python程序题求roc-auc是一种常用的模型评价指标“ 的搜索结果

# 利用sklearn自建评价函数from sklearn.model_selection import train_test_splitfrom sklearn.metrics import roc_auc_scorefrom keras.callbacks import Callbackclass RocAucEvaluation(Callback):d...

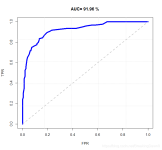

AUC是ROC曲线下的面积,它是机器学习用于二分类模型的评价指标,AUC反应的是模型对样本的排序能力。它的统计意义是从所有正样本随机抽取一个正样本,从所有负样本随机抽取一个负样本,当前score使得正样本排在负样本...

评估模型不同的应用有着不同的目标,不同的评价指标模型评价指标准确率准确率越高,模型不一定越好准确率是常见的一种评估模型,但是准确率越高模型不一定越好。举个例子假设,在1000个样本中,有999个正样本,1个负...

详解分类评价指标和回归评价指标以及Python代码实现这篇文章介绍的内容是详解分类评价指标和回归评价指标以及Python代码实现,有着一定的参考价值,现在分享给大家,有需要的朋友可以参考一下。1、概念性能度量...

数据科学是一个从数据中提取有意义的信息并帮助营销人员识别正确洞察力的领域,这些洞察力可以涉及各种营销方面,例如客户意图,经验,行为等,可以帮助他们有效地优化营销策略并获得最大收益。 该项目是关于

前言最近参加了一些比赛,...本文会先介绍二分类模型的主要评价指标:AUCKSLog-lossAccuracy/Recall/Precision/F1-score紧接着会先介绍多分类模型的主要评价指标:AccuracyF1-macroF1-score-weighted二分类模型1.AUC...

准确率(Accuracy) $$accuracy=\frac{tp+tn}{tp+fp+tn+fn}$$ accuracy是最常见也是最基本的评价指标。但是,在二分类且正负样本不平衡的情况下,尤其是对于较少数样本类感兴趣时,accuracy基本无参考价值。如欺诈检测...

AUC是一个模型评价指标,只能用于二分类模型的评价,对于二分类模型,还有很多其他评价指标,比如logloss,accuracy,precision。如果你经常关注数据挖掘比赛,比如kaggle,那你会发现AUC和logloss基本是最常见的...

我正在使用sklearn包来构建逻辑回归模型,然后对其进行评估.具体来说,我想使用交叉验证,但无法通过cross_val_score函数找出正确的方法.根据我看到的documentation和examples,我需要...这个函数有’roc_auc’作为一种...

一只蚂蚁:到底如何理解AUC?zhuanlan.zhihu.comAUC相关概念及作用1.AUC定义AUC(Area Under Curve)被定义为ROC曲线下与坐标轴围成的面积,显然这个面积的数值不会大于1。又由于ROC曲线一般都处于y=x这条直线的上方...

混淆矩阵(Confusion Matrix)混淆矩阵是衡量分类型模型准确度中最基本,最直观,计算最简单的方法。简单来说,混淆矩阵就是一张表格。他的四个基础指标如下:TP(true positive):真实值是positive,预测值也是...

通常,我们在实际的数据科学工作流中两次使用机器学习模型验证指标:模型比较:为您的任务选择最佳机器学习(ML)模型模型改进:调整超参数为了更清楚地了解这两者之间的区别,让我通过机器学习(ML)实现的工作流程来...

机器学习的相关评估指标--ROC-AUC曲线

两种方法求ROC曲线下面积(AUC)

本文记录了评估分类模型性能的常用指标ACC、AUC、ROC曲线的计算方法和代码。代码使用python实现。

python实现常见的评价指标 confusion matrix: 预测正例 预测负例 真正例 tp fn 真负例 fp tn precision 表示预测为正例的样本中 正确预测的样本个数,从预测的角度看有多少预测正确 precision = tp / (tp + fp)...

评估一个二分类的分类器的性能指标有:准确率、查准率(precision)、查全率(recall)、F1值以及ROC和AUC等。前面几个比较直观,而ROC和AUC相对抽象一点,本文将重点放在后者。因为本文曾一度没搞清ROC,所以这次...

1.非均衡分类问题在大多数情况下不同类别的分类代价并不相等,即将样本分类为正例或反例的代价是不能相提并论的。例如在垃圾邮件过滤中,我们希望重要的邮件永远不要被误判为垃圾邮件,还有在癌症检测中,宁愿误判也...

准确率不是评价模型好坏的标准,如遇到类别不平衡(class imbalance)的数据,典型的垃圾邮件问题,99%的邮件都是非垃圾邮件,1%为垃圾邮件,那分类准确率99%就没有什么意义。 错误率 = 分类错误样本数/样本总数 ...

在构建模型中,我们经常会用到AUC、ROC等指标来进行模型效果评估 ROC全称是“受试者工作特征”(Receiver Operating Characteristic)。ROC曲线的面积就是AUC(Area Under the Curve)。AUC用于衡量“二分类问题”...

数据类笔试题:Python绘制ROC曲线和计算AUC 前言: 这是我最近应聘某家互联网公司时遇到的笔试题:用Python或者R绘制ROC曲线并计算AUC ROC:Receiver Operating Characteristic,评判分类模型性能的方法,通过画在...

推荐文章

- vuex中state对象会数组中的值更新后getters没有监听到state数据的改变的问题state数据跟新页面不刷新问题_vue对象数组改变元素没有getter-程序员宅基地

- 《Centos7——手动部署prometheus》_prometheus centos7-程序员宅基地

- iOS 数据保存几种方式总结_苹果ld都会保留那些数据-程序员宅基地

- quartus生成qdb文件_quartus 生成qxp和vqm文件的方法-程序员宅基地

- Servlet学习笔记3,及回忆。_attributeadded(servletrequestattributeevent ev)方法的-程序员宅基地

- cv::putText详解-程序员宅基地

- tomcat优化_tomcat ajp端口干嘛用的 关闭会怎么样-程序员宅基地

- (UVA)11916 Emoogle Grid-程序员宅基地

- 指针_定义一个指针变量他的值是多少-程序员宅基地

- 《Java基础——异常的捕获与抛出》_java捕获异常和抛出异常-程序员宅基地