linux和window上安装pyspark库。

”linux运行pyspark“ 的搜索结果

PySpark & Dask 分布式集群环境搭建(傻瓜式)

pyspark 设置指南 这是在运行 ubuntu 15.04 的单台机器上安装和配置 Apache Spark 实例及其 python API pyspark 的指南。 ——克里斯蒂安·霍尔斯海默,2015 年 7 月 目录 1.1 1.2 1.3 1.4 2.1 2.2 2.3 3.1 为了运行...

在pycharm上配置pyspark在pycharm上配置pyspark在windows上下面的错误,linux上应该正常C:\ProgramData\Anaconda3\envs\tensorflow\python.exe E:/github/data-analysis/tf/SparkTest.py2018-07-19 10:35:41 ERROR ...

Pycharm-社区版本(如果需要免费)正在安装pip3 install -r docs/requirements.txtgit clone [email protected]:Indu-sharma/python-data_structure-algorithms.git运行测试待定和编码风格签入的所有代码均应遵循PEP-8...

进入Spark安装的根目录,在未配置运行的情况下,运行命令 ./bin/pyspark [root@Centos-7-3s /]# cd /usr/Spark/spark [root@Centos-7-3s spark]# ls bin data jars LICENSE logs python README.md sbin yarn co

1.将下载好的安装包上传到linux系统中2.解压安装包按回车多次按空格,直到看到最后时候输入yes再次输入yes输入想要安装的路径,注意:最后一个anaconda3是安装时候自动创建的文件夹,所以要保证上一个目录下没有...

1.1、Java 参考Java 安装运行 1.2、Scale安装 1)下载并解压 官网地址:https://www.scala-lang.org/download/ wget https://downloads.lightbend.com/scala/2.13.1/scala-2.13.1.tgz tar -...

Linux服务器下PySpark环境安装 一、JDK安装 1. 下载JDK安装包 进入Java官网下载对应的JDK版本,建议下载较早的版本,可能出现不兼容的。这里选择下载jdk-8u321-linux-x64.tar,下载完毕适用Xftp7上传至服务器...

一, 界面打开 1,直接输入jupyter notebook后打开界面 查看运行模式: 输入sc.master 若输出为:local[*],则表示它是在本地...PYSPARK_DRIVER_PYTHON=ipython PYSPARK_DRIVER_PYTHON_OPTS=”notebook“ MASTER=sp...

Linux安装anaconda和集成PySpark - ConfigurationLinux需要安装jdk,spark使用curl下载Anaconda(这是一个脚本)1)下载bzip:[root@head42 opt]# yum install bzip2.x86_642)运行脚本:[root@head42 opt]# sh Anaconda3...

文章目录下载安装包解压文件在启动PySpark之前,需要设置以下环境来设置Spark路径和 Py4j路径现在我们已经设置了所有环境,让我们转到Spark目录并通过运行以下命令调用PySpark shell 下载安装包 ...

我本来的方法是修改安装的python3为python,后面意识到会影响到同时安装的pip3,并且会和linux自带的python解释器产生混淆,于是考虑评论的建议: sudo update-alternatives --install /usr/bin/python python /...

Apache Spark 是专为大规模数据处理而设计的快速通用的计算引擎。Spark是UC Berkeley AMP lab (加州大学伯克利分校的AMP实验室)所开源的类Hadoop MapReduce的通用并行框架,Spark拥有Hadoop MapReduce所具有的优点;...

单机执行pyspark(python on spark)非常简单,只要在脚本所在服务器上部署个python环境或Anaconda这种集成运行环境,再通过python3命令执行就完了。 而想将python提交到spark集群中运行,则有两种方法,一种是...

你可以打开终端并运行pyspark命令来启动Pyspark。如果一切正常,你将看到类似以下信息的输出: Using Spark's default log4j profile: org/apache/spark/log4j-defaults.properties Setting default log level to ...

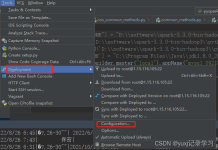

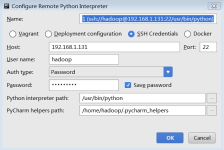

本文主要向大家介绍了Linux运维知识之PyCharm 远程连接linux中Python 运行pyspark,通过具体的内容向大家展现,希望对大家学习Linux运维知识有所帮助。PySparkinPyCharmonaremoteserver1、确保remote端Python、spark...

PySpark in PyCharm on a remote server 1、确保remote端Python、spark安装正确 2、remote端安装、设置 vi /etc/profile 添加一行:PYTHONPATH=SPARKHOME/python/: SPARK_HOME/python/lib/py4j-0.8.2.1-src.zip...

以下是在Linux上配置PySpark的步骤: 1. 安装Java和Python 确保Java和Python已经安装在您的Linux机器上,并且设置了相应的环境变量。您可以通过运行以下命令来检查Java和Python是否安装: ``` java -version ...

将linux 中spark 下的pyspark 复制到python 中 由于是spark2.0 因此只支持python3.5以下 cp -r /home/software/spark-2.0.1-bin-hadoop2.7/python/pyspark /usr/local/python3.5/lib/python3.5/site-packages/ ...

安装Apache Spark三.pyspark案例参考: 一.安装Java和Scale 1.1 安装java 因为我这个环境是CDH 6.3.1版本,已经安装了JDK,此次略过。 [root@hp1 ~]# javac -version javac 1.8.0_181 1.2 安装Scala 1.2.1 安装 代码...

Spark Application可以直接运行在YARN集群上,这种运行模式,会将资源的管理与协调统一交给YARN集群去处理,这样能够实现构建于YARN集群之上Application的多样性,比如可以运行MapReduc程序,可以运行HBase集群,也...

pyspark --master spark://master:7077 --num-executors 1 --total-executor-cores 3 --executor-memory 436m Python 2.7.14 |Anaconda, Inc.| (default, Dec 7 2017, 17:05:42) [GCC 7.2.0] on linux2 Type &...

搭建linux虚拟机 下载virtualbox,下载地址:https://www.virtualbox.org/wiki/Downloads,然后安装。 下载centos操作系统,http://isoredirect.centos.org/centos/7/isos/x86_64/CentOS-7-x86_64-DVD-1804.iso...

推荐文章

- SMT的基本知识介绍_smt行业基础知识-程序员宅基地

- 43.基于SSM的口腔护理网站|基于SSM框架+ Mysql+Java设计与实现(可运行源码+数据库+lw)-程序员宅基地

- HTML中Table表格的使用与漂亮的表格模板_html table 样式-程序员宅基地

- Linkage Mapper中的局部和全局地图比较实践指南(含实例分析)-程序员宅基地

- 线性筛求欧拉函数-程序员宅基地

- 初中几何题_初中几何题解-程序员宅基地

- jQuery 放大镜效果_jquery放大效果-程序员宅基地

- Python构建快速高效的中文文字识别OCR_中文ocr python-程序员宅基地

- SQL语句用case when实现if-else条件逻辑_case when里面可以加if else吗-程序员宅基地

- 数据结构实验课程设计报告求工程的最短完成时间_(1)用字符文件提供数据建立aoe网络邻接表存储结构; (2)编写程序,实现图中顶点的-程序员宅基地