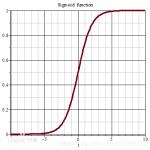

cross_entropy、binary_cross_entropy和binary_cross_entropy_with_logits。 那么他们有什么区别呢?下面我们就来探讨一下: 1.torch.nn.functional.cross_entropy def cross_entropy(input, target, weight=None, ...

”JPEG原理分析及JPEG解码器的解析_Cross_Entropy的博客-程序员宅基地“ 的搜索结果

JPEG原理分析及JPEG解码器的调试 原理分析 JPEG编解码流程图 将传入的图像进行零电平偏置,其实就是将所有像素的数值减去128,将其范围从[0,255]变成[-128,127]。 进行8×8的DCT变换,实现能量集中和去相关,便于...

initial population algorithm main loop algorithm results algorithm PSOpop=PSOfunc

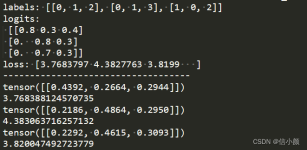

binary_cross_entropy和binary_cross_entropy_with_logits都是来自torch.nn.functional的函数,首先对比官方文档对它们的区别: 函数名 解释 binary_cross_entropy Function that measures the Binary Cross...

this code extract approximate entropy non-stationary signal

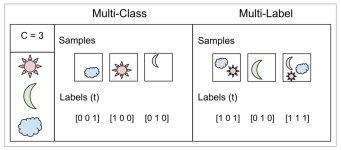

Cross-entropy 实际上是 目标概率向量和预测概率向量的比较。 假设target向量[1, 0, 0] 代表狗(狗的概率是1,其它的概率全为0) 向量[0, 1, 0] 代表猫 向量[0, 0, 1] 代表熊猫 每张图片只能是上面三种中的一种, ...

TensorFlow中,categorical_crossentropy和sparse_categorical_crossentropy都是交叉熵损失函数,它们的数学意义相同,区别仅在于适用于不同的类别标签编码格式。 当输入数据的类别标签采用独热编码(OneHot ...

在开发文档中有例程 import tensorflow as tf import numpy as np y_true = tf.constant...loss = tf.reduce_mean(tf.keras.losses.sparse_categorical_crossentropy(y_true, y_pred)) scce = tf.keras.losses.SparseC

1.sparse_categorical_crossentropy label数组中的数据全为0-9,表示十种分类。 model = tf.keras.Sequential() model.add(tf.keras.layers.Flatten(input_shape=(28,28))) model.add(tf.keras.layers.Dense(128, ...

在 tf.keras 中,有两个交叉熵相关的损失函数 tf.keras.losses.categorical_crossentropy 和 tf.keras.losses.sparse_categorical_crossentropy 。其中 sparse 的含义是,真实的标签值 y_true 可以直接传入 int 类型...

函数:tf.nn.sparse_softmax_cross_entropy_with_logits(logits=x, labels=y) 作用:计算logits和labels之间的稀疏softmax交叉熵,该函数为常用函数。 函数:tf.nn.softmax_cross_entropy_with_logits(logits=x, ...

softmax_cross_entropy_with_logits与sparse_softmax_cross_entropy_with_logits的区别没有sparse:有sparse:对比代码 最近学习了Policy Gradients,里面用到了sparse_softmax_cross_entropy_with_logits,很惊诧这...

如果 labels 是 one-hot 编码,用 categorical_crossentropy one-hot 编码: [[0, 1, 0], [1, 0, 0], [0, 0, 1]] 每条每一行是一个label的编码,1所在的位置代表label 如果你的 tagets 是 数字编码 ,用 ...

sparse_softmax_cross_entropy_with_logits(_sentinel=None, labels=None, logits=None, name=None) 唯一的区别是sparse的labels是int类型,而非sparse的labels是one-hot类型。 具体代码用法 import ...

本文主要介绍两个函数SparseCategoricalCrossentropy和sparse_categorical_crossentropy的区别。 这两个函数的功能都是将数字编码转化成one-hot编码格式,然后对one-hot编码格式的数据(真实标签值)与预测出的标签...

categorical_crossentropy 和 sparse_categorical_crossentropy 都是交叉熵损失函数,使用哪种函数要根据标签的结构来选择 如果样本标签是one-hot编码,则用 categorical_crossentropy函数 one-hot 编码:[0, 0, ...

4.示例sparse_softmax_cross_entropy_with_logits 5. 示例softmax_cross_entropy_with_logits 6. 补充说明 函数讲解 1. 函数功能 多分类交叉熵计算函数。它适用于每个类别相互独立且排斥的情况,例如一幅图...

欢迎使用Markdown编辑器 ...我们对Markdown编辑器进行了一些功能拓展与语法支持,除了标准的Markdown编辑器功能,我们增加了如下几点新功能,帮助你用它写博客: 全新的界面设计 ,将会带来全新的写作体...

相信有很多人在用pytorch做深度学习的时候,可能只是知道模型中用的是F.binary_cross_entropy或者F.cross_entropy,但是从来没有想过这两者的区别,即使知道这两者是分别在什么情况下使用的,也没有想过它们在...

F.cross_entropy 函数对应的类是torch.nn.CrossEntropyLoss,在使用时会自动添加logsoftmax然后计算loss(其实就是nn.LogSoftmax() 和nn.NLLLoss() 类的融合) 该函数用于计算多分类问题的交叉熵loss 函数形式: ...

一、三者的异同 1、共同点 三者功能都是先计算输入 logits 的 softmax 分类,再计算与输入 labels 之间的交叉熵,...已经弃用,相同功能被 softmax_cross_entropy_with_logits_v2 取代 (2)softmax_cross_ent...

tf.nn.softmax_cross_entropy_with_logits tf.nn.softmax_cross_entropy_with_logits_v2 tf.nn.sparse_softmax_cross_entropy_with_logits 三者的异同 1、共同点 三者功能都是先计算输入 logits 的 softmax 分类,再...

探究binary cross entropy的计算细节

如果是二分类问题,即最终的结果只能是两个分类中的一个,则损失函数loss使用binary_crossentropy 多分类问题: 对于多分类问题,在选择损失函数loss时,主要是看数据是如何编码的: 1.如果是分类编码(one-...

推荐文章

- Codeforces-学校排队-程序员宅基地

- 计算机毕业设计ssm基于JAVA的图书馆自习室座位预约系统194fd9 (附源码)轻松不求人_基于ssm的图书馆预约座位-程序员宅基地

- 实值复变函数求导 ——(Wirtinger derivatives)_wirtinger导数-程序员宅基地

- VMWare虚拟机设置固定IP上网方法_vm虚拟机只允许指定ip访问-程序员宅基地

- 深度学习修炼(一)线性分类器 | 权值理解、支撑向量机损失、梯度下降算法通俗理解-程序员宅基地

- 基于SpringBoot的社区团购APP+02043(免费领源码)可做计算机毕业设计JAVA、PHP、爬虫、APP、小程序、C#、C++、python、数据可视化、大数据、全套文案-程序员宅基地

- 如何在无公网IP环境下远程访问Serv-U FTP服务器共享文件-程序员宅基地

- uniapp的navigateTo页面跳转参数传递问题_uni.navigateto刷新携带参数丢失-程序员宅基地

- C++中std::getline()函数的用法-程序员宅基地

- vue 工作中的一些小总结(基础知识供刚入门的小伙伴看 vue+elementUi+vsCode+vue-router+iconfont )_mac+elementui+vscode-程序员宅基地