hadoop安装_接着需要把本地文件系统的“/usr/local/hadoop/etc/hadoop”目录中的所有xm-程序员宅基地

技术标签: spark hadoop和spark hadoop

写在前面

本教程使用的环境是虚拟机VM安装的ubuntu16.04,提供给需要的网友下载

链接:https://pan.baidu.com/s/1G9fXGBgdevkp-mdHkSIMPg?pwd=7vzl

提取码:7vzl

1、安装ssh

sudo apt-get install openssh-server

安装后,可以使用如下命令登录本机:

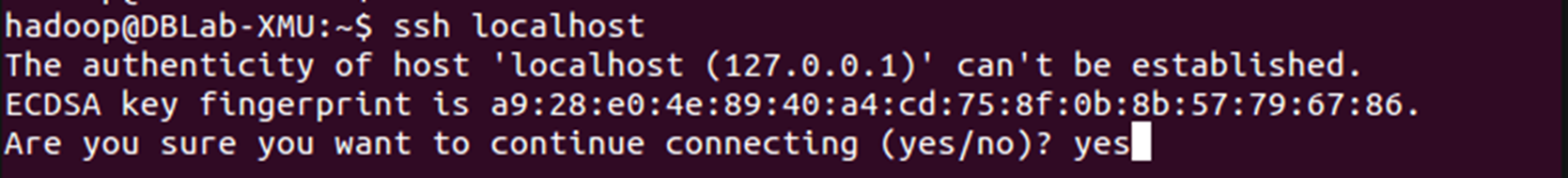

ssh localhost

执行该命令后会出现提示信息,输入yes,然后按提示输入密码hadoop

输入命令exit退出SSH,回到原先的终端窗口;然后,利用ssh-keygen生成密钥,并将密钥加入到授权中,命令如下:

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车即可

cat ./id_rsa.pub >> ./authorized_keys # 加入授权

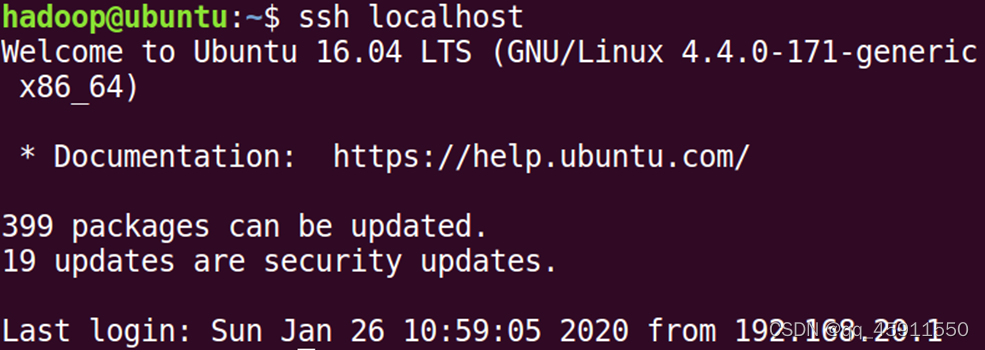

此时,再执行ssh localhost命令,无需输入密码就可以直接登录了

2、安装java环境

jdk下载

链接:https://pan.baidu.com/s/1eXSqx8hXoyEqg76tkZIWwA?pwd=qzo1

提取码:qzo1

执行如下命令创建/usr/lib/jvm目录用来存放JDK文件:

cd /usr/lib

sudo mkdir jvm #创建/usr/lib/jvm目录用来存放JDK文件

执行如下命令对安装文件进行解压缩:

cd ~ #进入hadoop用户的主目录

cd Downloads

sudo tar -zxvf ./jdk-8u162-linux-x64.tar.gz -C /usr/lib/jvm

添加环境变量

vim ~/.bashrc

添加如下几行内容:

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

Source ~/.bashrc

3、 下载安装文件

文件下载地址

链接:https://pan.baidu.com/s/15KCPJ_AcRcsgBzy9ysw6NA?pwd=n9ho

提取码:n9ho

使用hadoop用户登录Linux系统,打开终端,执行如下命令:

sudo tar -zxf ~/下载/hadoop-3.1.3.tar.gz -C /usr/local # 解压到/usr/local中

cd /usr/local/

sudo mv ./hadoop-3.1.3/ ./hadoop # 将文件夹名改为hadoop

sudo chown -R hadoop ./hadoop # 修改文件权限

Hadoop解压后即可使用,可以输入如下命令来检查 Hadoop是否可用,成功则会显示 Hadoop版本信息:

cd /usr/local/hadoop

./bin/hadoop version

4、伪分布式模式配置

1)修改配置文件

修改以后,/usr/local/hadoop/etc/hadoop/core-site.xml文件的内容如下:

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

同样,需要修改配置文件/usr/local/hadoop/etc/hadoop/hdfs-site.xml,修改后的内容如下:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>

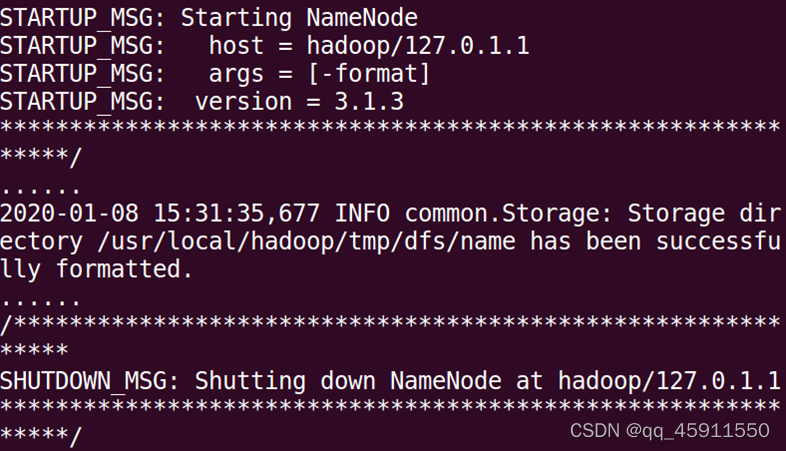

2)执行名称节点格式化

修改配置文件以后,要执行名称节点的格式化,命令如下:

cd /usr/local/hadoop

./bin/hdfs namenode -format

如果格式化成功,会看到“successfully formatted”的提示信息

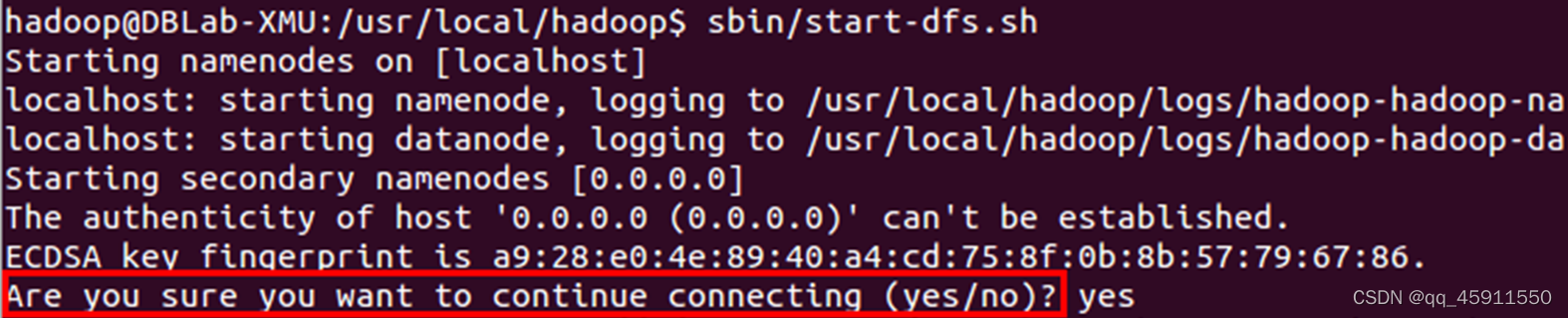

3) 启动Hadoop

执行下面命令启动Hadoop:

cd /usr/local/hadoop

./sbin/start-dfs.sh #start-dfs.sh是个完整的可执行文件,中间没有空格

如果出现SSH提示,输入yes即可:

4)运行Hadoop伪分布式实例

要使用HDFS,首先需要在HDFS中创建用户目录,命令如下:

cd /usr/local/hadoop

./bin/hdfs dfs -mkdir -p /user/hadoop

接着把/usr/local/hadoop/etc/hadoop目录中的所有xml文件作为输入文件,复制到分布式文件系统HDFS中的/user/hadoop/input目录中,命令如下:

cd /usr/local/hadoop

./bin/hdfs dfs -mkdir input #在HDFS中创建hadoop用户对应的input目录

./bin/hdfs dfs -put ./etc/hadoop/*.xml input #把本地文件复制到HDFS中

运行Hadoop自带的grep程序,命令如下:

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar grep input output 'dfs[a-z.]+'

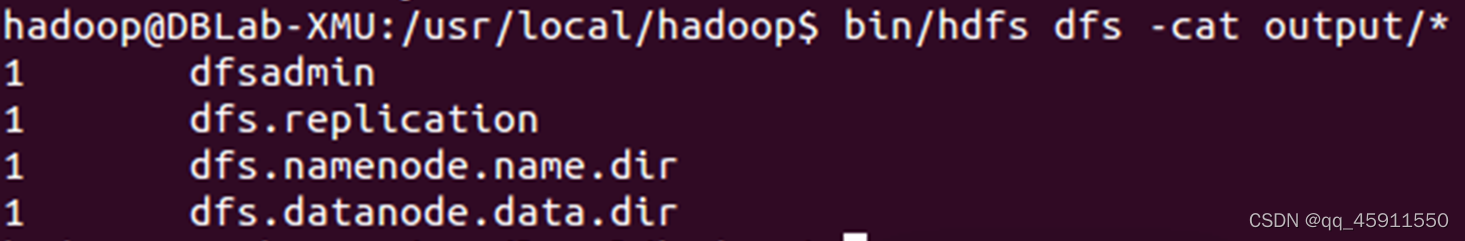

运行结束后,可以通过命令查看HDFS中的output文件夹中的内容:

./bin/hdfs dfs -cat output/*

执行结果如图所示

5)关闭Hadoop

cd /usr/local/hadoop

./sbin/stop-dfs.sh

4、配置PATH环境

首先使用vim编辑器打开~/.bashrc这个文件,在这个文件的最前面位置加入一行:

export PATH=$PATH:/usr/local/hadoop/sbin

如果要继续把其他命令的路径也加入到PATH变量中,也需要修改~/.bashrc文件。用英文冒号“:”隔开,把新的路径加到后面即可,如下所示:

export PATH=$PATH:/usr/local/hadoop/sbin:/usr/local/hadoop/bin

添加后,执行命令source ~/.bashrc使设置生效。设置生效后,在任何目录下启动Hadoop,都只要直接输入start-dfs.sh命令即可,同理,停止Hadoop,也只需要在任何目录下输入stop-dfs.sh命令即可。

声明:本内容为整理诸峰老师课件而来

智能推荐

以算法岗为例:我最想对入职前的自己说些什么?-程序员宅基地

文章浏览阅读251次。来自:机器学习与推荐系统进入算法岗的正式工作虽然只有半年多,但从 19 年 1 月就在算法岗开始实习,算下来到现在都有两年多的工作经验了,不过正式参加工作以后还是有了很多新的感悟,这篇文章..._算法岗入职很紧张

2017 Wuhan University Programming Contest (Online Round) D. Events,线段树区间更新+最值查询!...-程序员宅基地

文章浏览阅读87次。D. Events 线段树区间更新查询区间历史最小值,看似很简单的题意写了两天才写出来。 题意:n个数,Q次操作,每次操作对一个区间[l,r]的数同时加上C,然后输出这段区间的历史最小值。 思路:在线段树区间更新最值查询的基础上再用一个变量表示...

5V过压保护电路原理解说-程序员宅基地

文章浏览阅读8.7k次,点赞13次,收藏99次。百度许久,发现这个保护电路是有,但相关的原理描述却很空白,或者描述的有点让人懵逼……因此写此文章记录一下使用心得。如图所示。当VIN电压大于稳压二极管电压时,SS8550两端存在正向压降,PNP管导通。导通的电压将PMOS管两端的GS电压相等,压降抵消,另其无法导通,VOUT输出停止。当VIN电压小于等于稳压二极管电压时,SS8550不导通,此时PMOS管的2脚电压为7V,1脚电压下拉接地,为0V,GS两端存在正向压降,导通,输出电压。要点1:稳压二极管在此电路中的作用? 作用就..._5v过压保护电路

【程序】猫狗分类程序:包括网络结构、数据集处理、训练、测试-程序员宅基地

文章浏览阅读597次。网络的输出层设置两个神经元的原因:神经网络有两个输出值对应两种类别,通过学习数据的不同特征,让两种类别在输出上有体现,即0趋近于猫,1趋近于狗。宏观上来看,神经网络具有了辨识猫狗的能力。训练过程中,有对GT由一维处理成二维的操作,目的也是为了和神经网络二维的输出进行匹配。import torchimport osimport numpy as npfrom PIL import Imagefrom torch.utils.data import Dataset, DataLoade..

Bnuntu140.4搭建Android5.1开发环境和编译_elink8163.tb-程序员宅基地

文章浏览阅读215次。From: http://www.linuxidc.com/Linux/2015-07/119759.htm1、安装Ubuntu14.04先下载Ubuntu系统,官网地址,从ubuntu10.04-ubuntu15.04都有下载,具体根据需求可以下载desktop和server版本一般虚拟机建议安装desktop版本,方便管理,本人电脑是64位的,所以下载的ubuntu-14.04.2-se..._elink8163.tb

SM2258XT开卡详细教程,SM2259XT2量产可参考,自己动手修复SSD故障-程序员宅基地

文章浏览阅读8.2k次,点赞3次,收藏12次。几年前电脑更换的固态硬盘,最近一段时间显示响应速度越来越慢、然后就是点击任何地方后都是卡住不动,作为移动U盘插入电脑后频繁闪退。原以为是操作系统的设置的问题,经过更换电脑后发现,是固态硬盘的问题。使用常见的SSD硬盘修复工具,尝试修复后依然无任何效果,该卡还是卡,该闪退还是闪退。_sm2258xt

随便推点

【Java并发编程】FutureTask 阻塞等待异步结果_java futuretask会阻塞吗-程序员宅基地

文章浏览阅读1.9k次。什么是FutureTaskFutureTask类实现了RunnableFuture接口,RunnableFuture继承了Runnable接口和Future接口,而FutureTask实现了RunnableFuture接口。所以FutureTask 既可以作为Runnable被线程执行,又可以作为Future得到Callable的返回值。怎么用FutureTask由介绍可知,FutureTa..._java futuretask会阻塞吗

ZVM – 记VMP保护代码还原工程_zvm vmp-程序员宅基地

文章浏览阅读1.6w次,点赞6次,收藏27次。1. 前言. 这篇文章写于2012年的8月,ZVM这个工程是我于2007年左右,一时头脑发晕而做的项目.做的时候是有考虑将其加密解密作为商业化运营的,如果失败,就当是体验一下这种所谓的CRACK界最强,也是最后一道防御是什么样子的.或者还能自己实现一套类似的软件.不管怎么说,研究VMP前后大约花掉我半年多的业余时间(最早还是个CONSOLE工程),还原引擎包含了VM指令调试器,_zvm vmp

Nginx启动报[10013]错误_nginx 错误1053-程序员宅基地

文章浏览阅读601次。原因: 80端口被占用cmd中查看80端口的占用情况:发现果然被占用,PID为4的进程占用,随后打开进程管理器发现是System进程占用80端口的情况 IIS服务器SqlServer数据库解决方法:关闭占用80端口的进程..._nginx 错误1053

局部图像描述子_图像局部特征描述子-程序员宅基地

文章浏览阅读314次。提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档文章目录前言一、pandas是什么?二、使用步骤1.引入库2.读入数据总结前言提示:这里可以添加本文要记录的大概内容:例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。提示:以下是本篇文章正文内容,下面案例可供参考一、pandas是什么?示例:pandas 是基于NumPy 的一种工具,该工具是为了解决数据分析任务而创建的。二、使用步骤1.引入库代码_图像局部特征描述子

【C语言训练】自守数问题_c语言自守数问题-程序员宅基地

文章浏览阅读3.7k次,点赞8次,收藏14次。题目描述自守数是指一个数的平方的尾数等于该数自身的自然数。 例如: 25^2=625 76^2=5776 9376^2=87909376 请求出200000以内的自守数?输入输出200000以内的自守数(包括0, 数之间用两个空格分开,包括末尾空格) 0 1 5 6 25 76 376 625 ???? ???? .._c语言自守数问题

MySQL的 FIND_IN_SET 在达梦中如何转换?_达梦数据库 find_in_set-程序员宅基地

文章浏览阅读3.5k次,点赞3次,收藏10次。最近有同学在迁移MySQL的时候碰到一个问题:FIND_IN_SET 在达梦中如何转换?其实可以自定义一个FIND_IN_SET函数来解决,参考了一个Oracle解决类似问题的帖子,可以直接用CREATE OR REPLACE FUNCTION FIND_IN_SET ( piv_str1 varchar2, piv_str2 varchar2, _达梦数据库 find_in_set